Otimização da Taxa de Conversão de Apps: Um Guia Prático de CRO para Mobile

ÍNDICE

- Principais conclusões

- O que é otimização da taxa de conversão de apps?

- Conversões micro vs. macro: instrumente as duas

- Benefícios de fazer isso bem

- O framework de CRO mobile em 7 passos

- 14 padrões e armadilhas de CRO mobile

- Considerações de CRO específicas por indústria

- Ferramentas de CRO mobile por categoria

- 10 erros comuns de CRO mobile

- Modelo de Maturidade de CRO

- Começando: seus primeiros 30 dias

- O que eu vejo funcionando em 2026

- Leituras relacionadas

- Perguntas frequentes

A otimização da taxa de conversão de apps é a disciplina de transformar mais do seu tráfego e instalações atuais em usuários que concluem as ações das quais seu negócio depende: cadastros, assinaturas, compras, reativações. Eu revisei centenas de funis mobile nos últimos anos, e o padrão que mais vejo é o mesmo. As equipes copiam playbooks de CRO da web para uma tela de celular, se perguntam por que seus testes de lift dão em nada, e culpam usuários de "baixa intenção". O problema real quase sempre é que o CRO mobile precisa do seu próprio modelo, da sua própria instrumentação e do seu próprio loop de evidência.

Este guia mostra como eu abordo CRO quando faço auditoria de um produto, em apps móveis e na web. Como definir a conversão, como encontrar os vazamentos e como fechá-los com mudanças que se acumulam.

Principais conclusões

A otimização da taxa de conversão de apps é diferente do CRO genérico de web. Zonas do polegar, fragmentação de aparelhos, fricção de app store e caminhos de sessão opacos significam que você não pode simplesmente transplantar táticas de desktop.

Conversões macro e micro importam, ambas. Acompanhe o cadastro ou a compra, mas instrumente os 6 a 10 microeventos que a predizem para saber onde o funil está realmente quebrando.

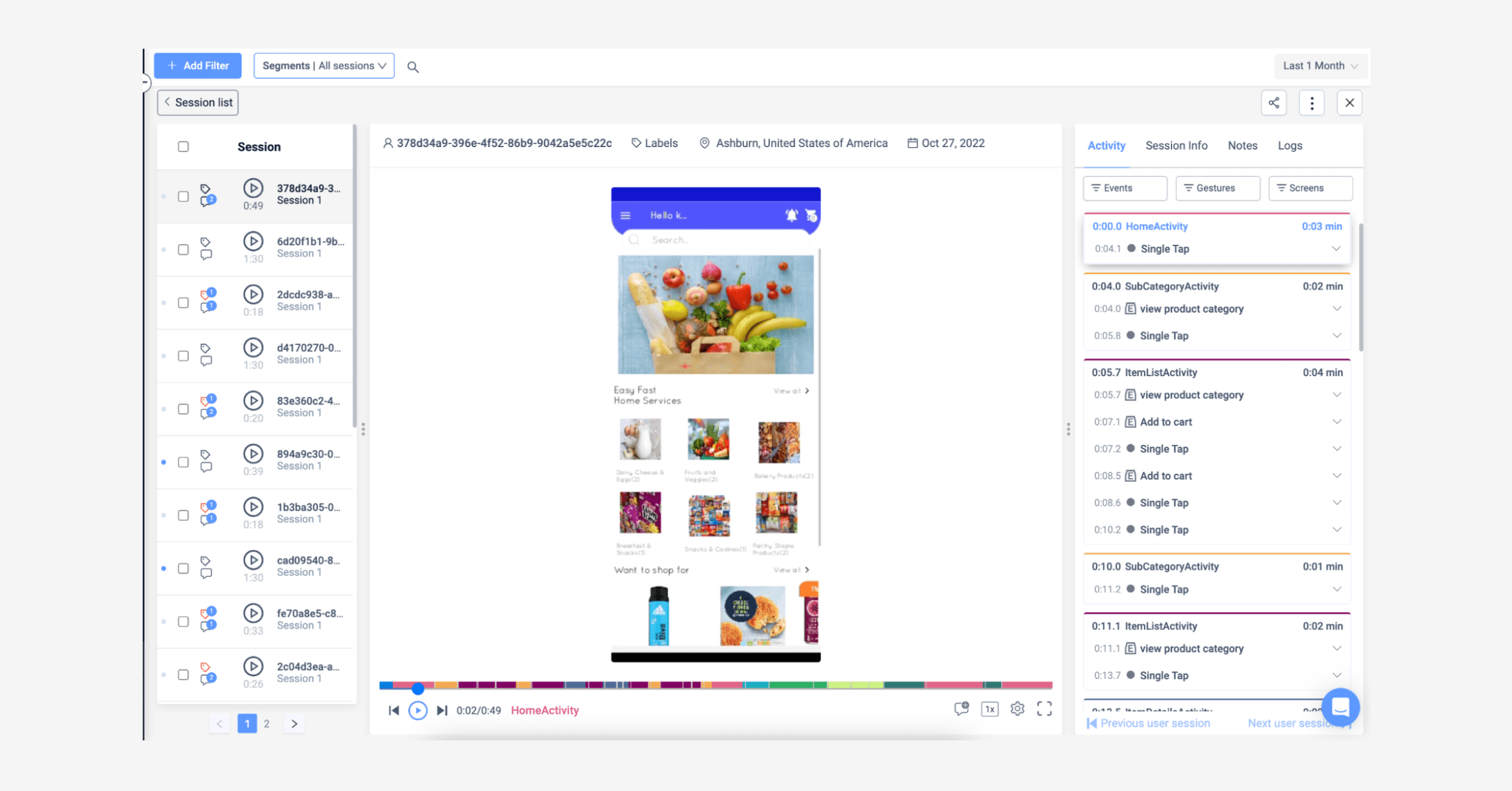

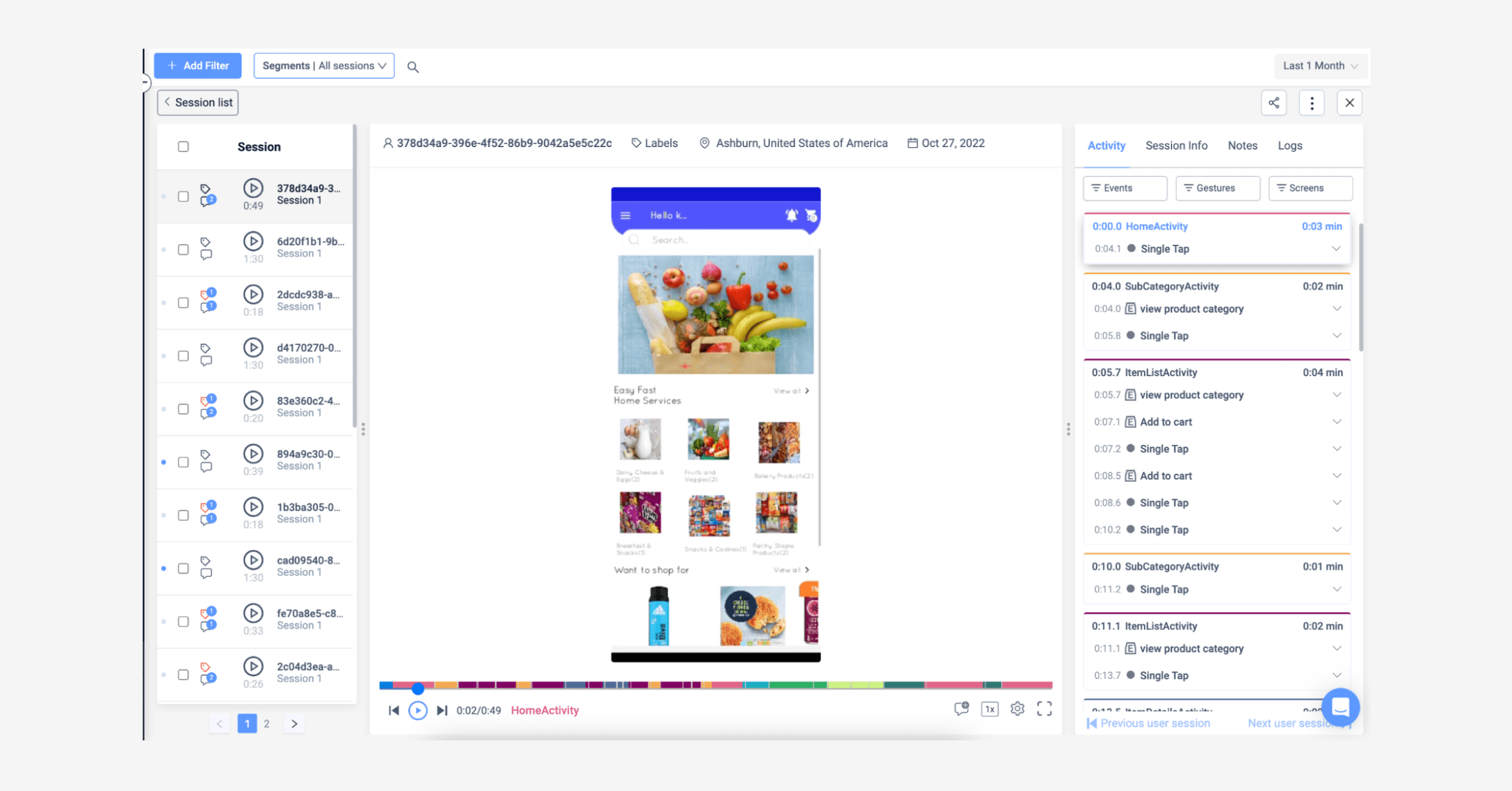

Session replay é o caminho mais rápido para uma hipótese de CRO. Assistir a 20 sessões com drop-off normalmente vence uma semana encarando dashboards.

Velocidade, tamanho de formulário e fricção de pagamento continuam sendo os três ajustes de maior retorno. Uma melhoria de um segundo no tempo de carregamento sozinha vale cerca de 27% em taxa de conversão no mobile.

A Tara AI do UXCam, session replay, heatmaps e issue analytics dão a você a camada qualitativa que a maioria das equipes não tem, a razão pela qual a Recora reduziu tickets de suporte em 142% e a Inspire Fitness elevou o tempo no app em 460%.

O que é otimização da taxa de conversão de apps?

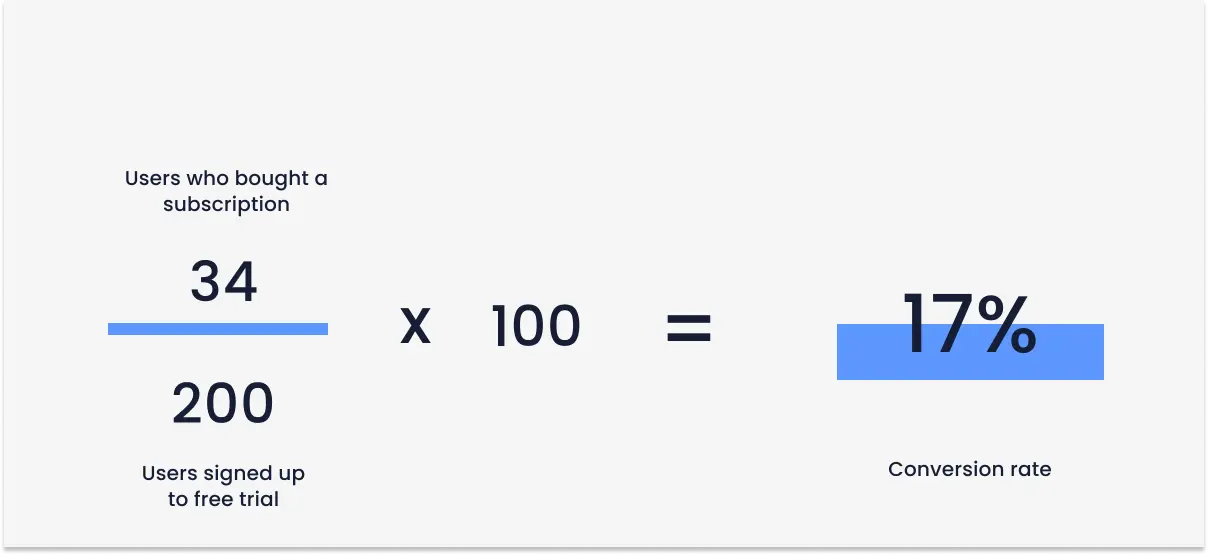

Otimização da taxa de conversão de apps (CRO mobile) é o processo contínuo de aumentar a parcela de usuários que concluem uma ação definida, ligada à receita, dentro do seu app móvel ou produto web. Essa ação pode ser ativação após cadastro, uma compra in-app, um upgrade de assinatura, uma reserva, ou atingir um limiar de engajamento específico que se correlaciona com retenção.

A matemática é simples. O trabalho não é.

O que torna o CRO mobile mais difícil que o CRO de desktop:

Sem visibilidade a nível de URL. Você não pode simplesmente plugar um script de heatmap e ler a profundidade de scroll. Você precisa de um SDK que capture telas, gestos e eventos automaticamente.

Fragmentação de aparelhos. Um botão de checkout que funciona em um Pixel 8 pode ser cortado em um Android econômico. Sem replay, você não vai saber.

A fricção da app store fica fora do seu app. Taxas de install-to-open, prompts de permissão e avaliações na loja afetam a conversão, mas vivem fora da sua stack de product analytics.

O contexto da sessão é mais curto e mais interrompido. Usuários convertem em janelas de 30 segundos entre outros apps, ligações e notificações.

É por isso que a stack de CRO que eu recomendo é construída em torno de uma product intelligence platform, não de uma ferramenta de marketing readaptada. O UXCam está instalado em mais de 37.000 produtos e foi construído para apps móveis e para web, o que é o que torna o resto deste framework possível.

Conversões micro vs. macro: instrumente as duas

A maioria das equipes que eu audito acompanha uma conversão macro e considera o trabalho feito. Depois, quando o número cai, elas não têm ideia do porquê. As microconversões dão a você a camada de diagnóstico.

Conversões macro

Conversões macro são os marcos primários atrelados à receita ou à promessa central do produto. Pense:

Instalação do app → primeira abertura

Cadastro concluído

Primeira compra ou assinatura

Upgrade para plano pago

Reserva ou pedido confirmado

Microconversões

Microconversões são os passos e sinais no caminho até a macro. Dois sabores que vale a pena separar:

Marcos de processo são os passos explícitos no funil: email verificado, perfil concluído, método de pagamento adicionado, primeiro item adicionado ao carrinho. Eles dizem onde o funil quebra.

Ações secundárias são sinais de engajamento que predizem conversões macro futuras: conteúdo compartilhado, notificação habilitada, favorito adicionado, tooltip de onboarding concluído. Eles dizem quem tem chance de converter depois.

A regra que eu dou para as equipes: para cada conversão macro, defina pelo menos seis microeventos ao longo da jornada. Essa é a instrumentação que você precisa antes de rodar um único teste A/B.

Benefícios de fazer isso bem

Você entende seus usuários de verdade

Nem todo mundo no seu app tem a mesma intenção. Alguns chegaram de um anúncio do TikTok esperando uma vitória de 10 segundos. Alguns são power users retornando. Uma prática de CRO adequada segmenta essas cortes e permite que você veja onde cada uma trava. A análise de comportamento do usuário é a base aqui, não um extra bom de ter.

Você estende o valor de tempo de vida do cliente

Aquisição fica mais cara a cada trimestre. Aumentar o valor dos usuários pelos quais você já pagou é a alavanca de crescimento mais barata disponível. A Housing.com usou essa abordagem com o UXCam para fazer a adoção de funcionalidades crescer de 20% para 40%, um aumento direto de LTV sem um único dólar a mais em ad spend.

Você reduz o custo de suporte

Quando você encontra e corrige a fricção que causa rage taps e congelamentos de UI, os tickets caem. A Recora usou o issue analytics do UXCam para detectar que os usuários estavam pressionando-e-segurando um botão que deveria ser tocado. Corrigir a affordance reduziu tickets de suporte em 142%.

O framework de CRO mobile em 7 passos

Aqui está a sequência que eu rodo com as equipes. A ordem importa. Pular os passos 1-2 é a razão pela qual a maioria dos programas de CRO estagna.

Passo 1. Instalar uma stack de analytics

Sem instrumentação honesta, o resto é adivinhação. No mínimo você precisa de:

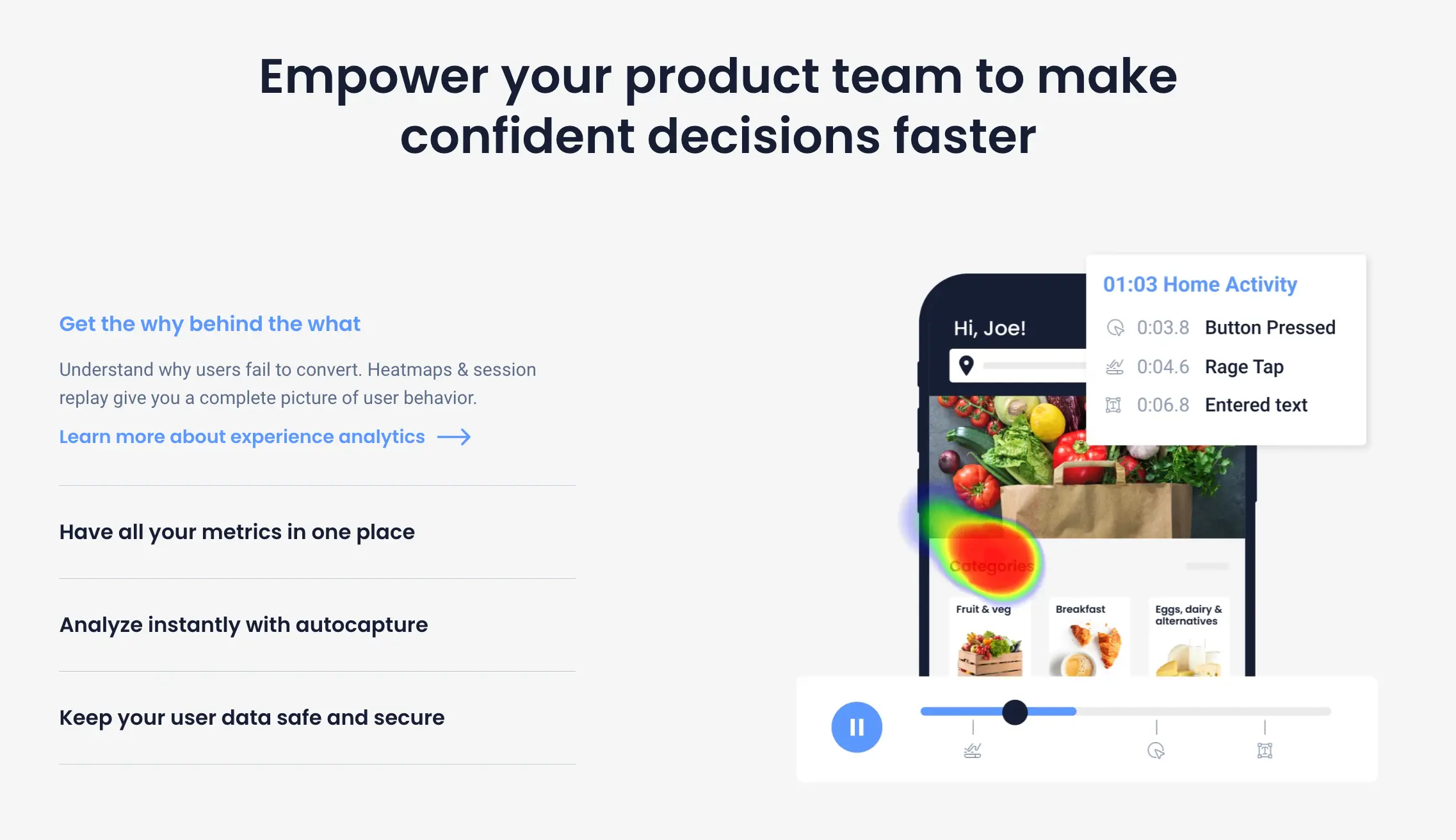

Telas e gestos capturados automaticamente para você não ter que marcar cada toque manualmente.

Session replay para assistir aos drop-offs, não só contá-los.

Heatmaps atrelados às telas, com visões de toque, scroll e dead zones.

Funis que você pode reconfigurar sem fazer novo deploy do app.

Issue analytics que trazem à tona rage taps, congelamentos de UI e crashes no contexto da sessão do usuário.

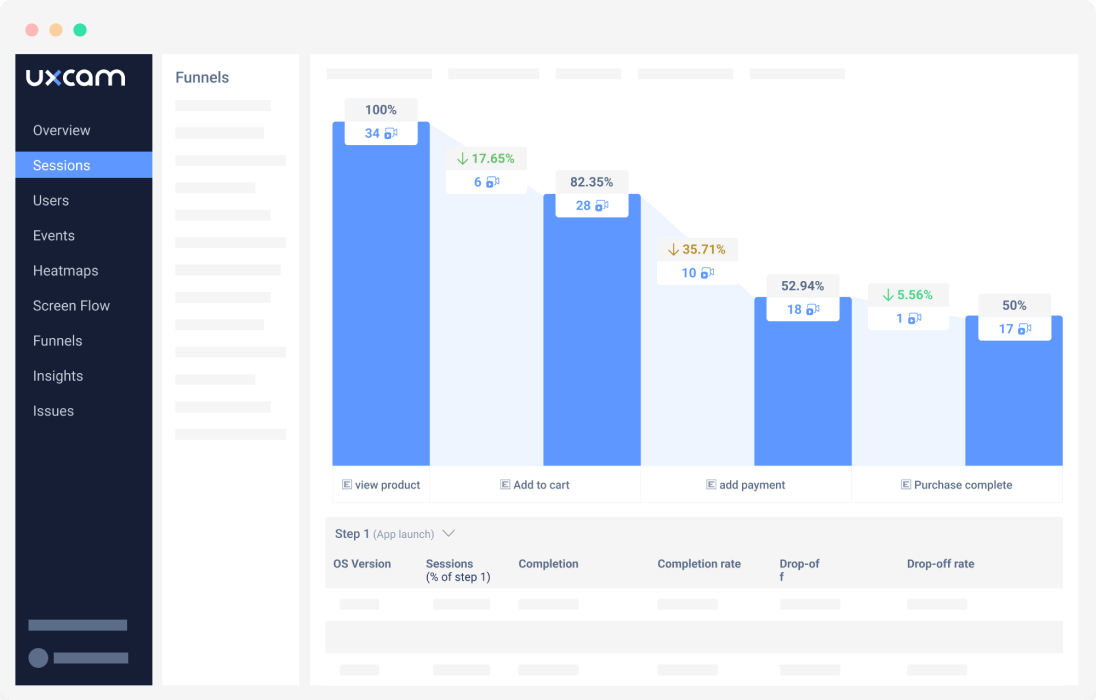

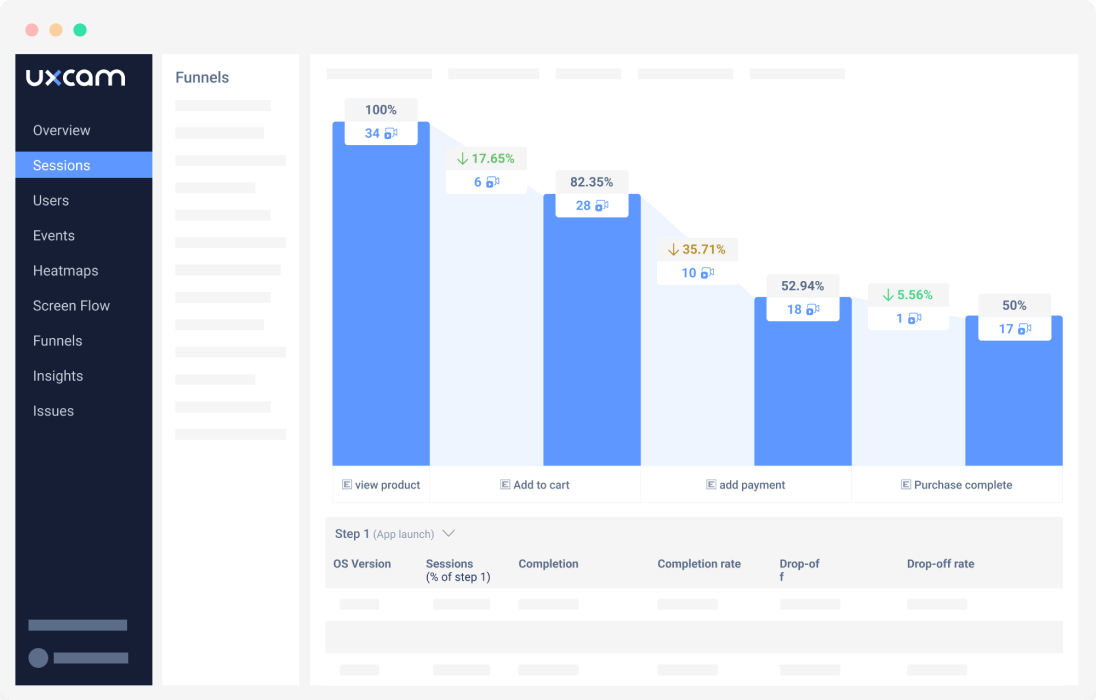

O session replay do UXCam e os heatmaps vêm como parte de um único SDK leve, e a Tara, a analista de IA, lê as sessões capturadas e recomenda onde focar. Para a maioria das equipes com as quais trabalho, essa combinação substitui três ou quatro ferramentas separadas.

O workflow de CRO com UXCam que eu uso na prática

Defina a conversão. Fixe um evento macro e de 6 a 10 microeventos ao redor dele.

Configure eventos e telas. Use Smart Events para poder adicionar eventos sem um ticket de engenharia, além de telas e gestos capturados automaticamente para tudo que você esqueceu de planejar.

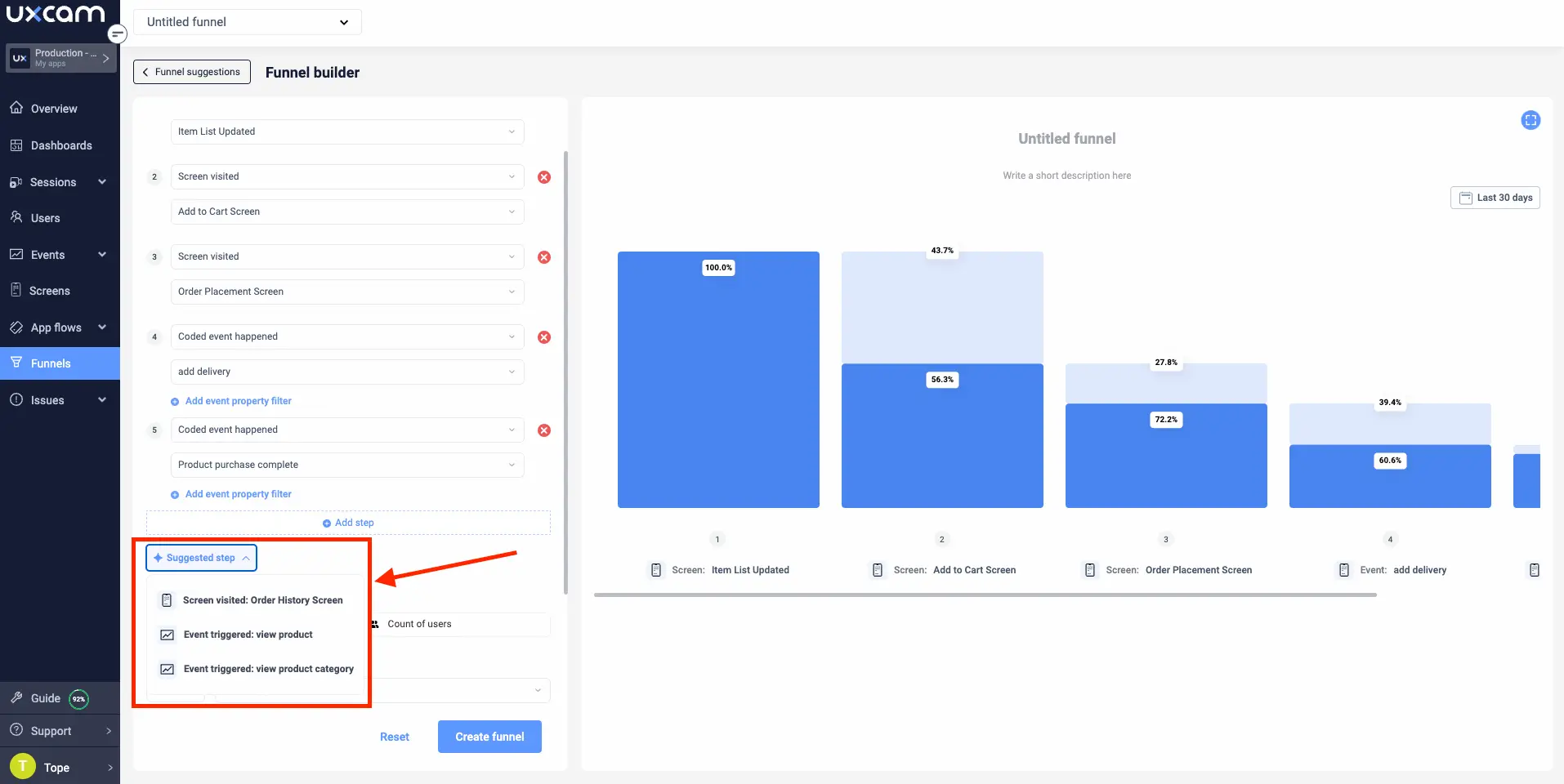

Mapeie os caminhos do usuário. Os Screen Flows mostram as rotas reais. As Funnel Suggestions trazem à tona caminhos prováveis em que você não tinha pensado.

Valide o funil. Assista a 6-7 replays em cada etapa para confirmar que os eventos disparam corretamente. Esse passo pega mais bugs de instrumentação do que qualquer processo de QA.

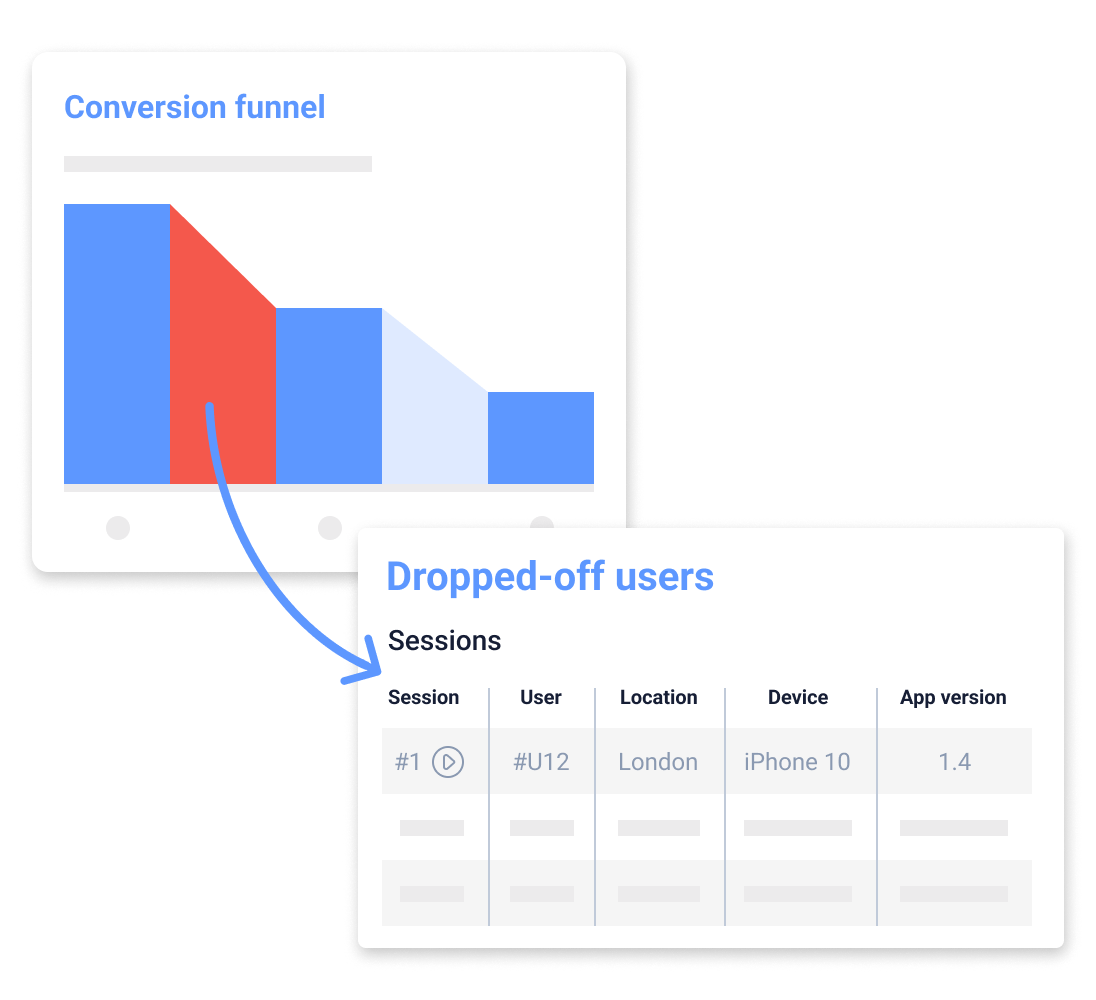

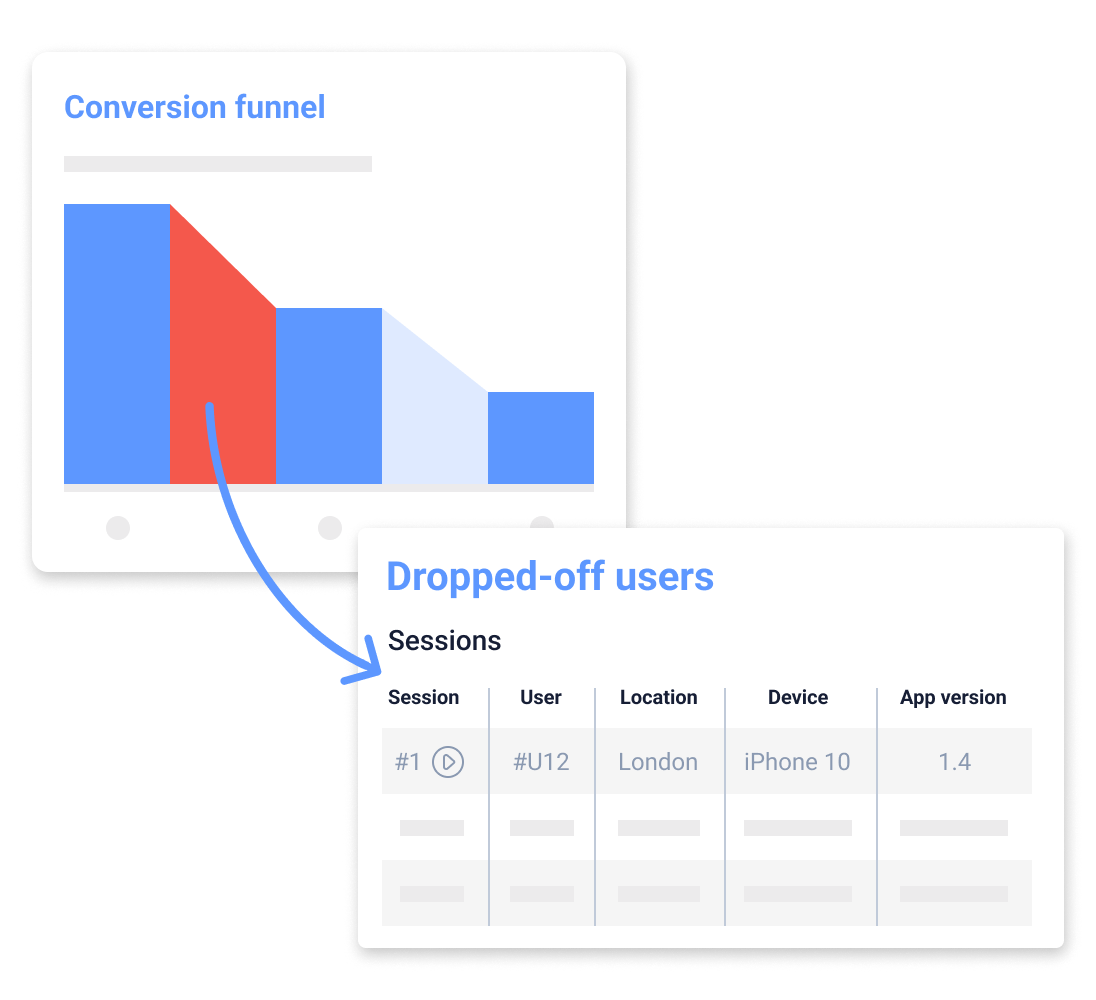

Analise os drop-offs. Use funnel analytics para ver onde o sangramento acontece.

Segmente os drop-offs. Novos vs. recorrentes, classe de aparelho, país, fonte de tráfego. O número agregado esconde a história real toda vez.

Investigue com replays. Filtre sessões por etapa de drop-off e assista. Dez minutos assistindo vencem uma hora de dashboarding.

Confirme com heatmaps e issue analytics. Rage taps, dead taps e congelamentos de UI na tela quebrada vão te dizer exatamente o que corrigir.

Monitore o impacto. Configure dashboards para o funil e observe-o se recuperar. Compartilhe com stakeholders semanalmente.

Passo 2. Fazer pesquisa específica de mobile

Muitas equipes rodam as mesmas entrevistas de usuário que rodaram para o funil web e chamam isso de pesquisa mobile. Uma passagem real de pesquisa de CRO mobile inclui:

Segmentação por classe de aparelho (flagship vs. Android econômico é uma diferença real)

Testes de condição de rede (3G, wifi instável)

Checagens de orientação e alcance (o CTA pode ser tocado com uma mão só?)

Estudos de diário em contexto, em que usuários relatam sessões que aconteceram em uma fila, no ônibus etc.

Os resultados de pesquisa devem ser segmentados por tipo de aparelho para você conseguir dizer se "o app parece lento" é universal ou isolado em uma camada de hardware.

Passo 3. Dobrar a aposta nos seus fluxos de maior conversão

Normalmente existe um caminho pelo seu app que converte três ou quatro vezes melhor que a média. Encontre-o com user journey analytics e proteja-o impiedosamente.

Movimentos práticos:

Um CTA primário por tela. O espaço mobile pune a indecisão. Dados de heatmap normalmente mostram o CTA secundário comendo toques do primário.

Coloque CTAs na zona do polegar, no terço inferior da tela, não na barra de navegação superior.

Faça A/B test do copy. "Começar teste grátis" vs. "Experimentar grátis" vs. "Começar agora" frequentemente oscila a conversão em 10-20% sem nenhum trabalho de design.

Use o onboarding para entregar valor imediato. Deixe os usuários interagirem com uma funcionalidade real antes de bater no paywall. A Inspire Fitness usou os insights de sessão do UXCam para redesenhar a fricção do fluxo de onboarding e aumentou o tempo no app em 460% enquanto cortava rage taps em 56%.

Passo 4. Corrigir performance antes de qualquer coisa

Os usuários notam atrasos tão curtos quanto 100 milissegundos. Uma melhoria de um segundo no tempo de carregamento eleva a conversão em cerca de 27% no mobile. A própria pesquisa do Core Web Vitals do Google mostra que sites que atingem os limiares de LCP, INP e CLS têm abandono materialmente menor. Performance não é uma preocupação de engenharia separada do CRO, é a alavanca de CRO de maior impacto para a maioria dos apps que eu audito.

O que verificar primeiro:

Otimização de imagens (AVIF ou WebP, dimensionamento adequado por aparelho)

Tempo de cold start

Tempo de resposta de API nas telas do caminho crítico

Jank de animação e frames perdidos em aparelhos econômicos

Congelamentos de UI, que o issue analytics do UXCam traz à tona automaticamente

Passo 5. Simplificar checkout e formulários

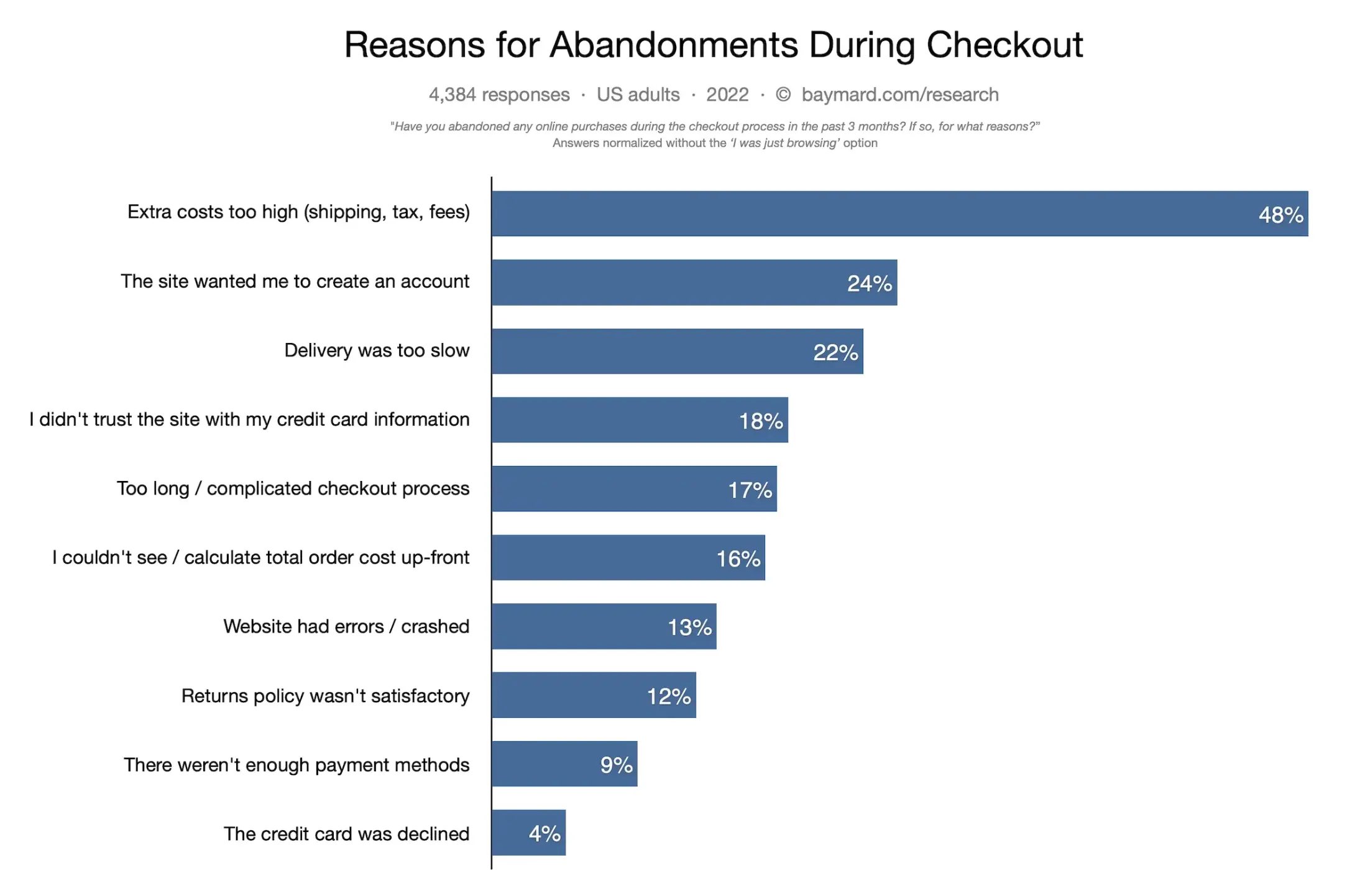

17% dos compradores abandonam carrinhos especificamente porque o checkout é longo ou complicado demais. No mobile esse número normalmente é pior, com o Baymard Institute reportando abandono médio documentado de carrinho mobile acima de 85% entre setores.

A lista curta de correções de checkout que consistentemente elevam a conversão:

Remova todo campo de que você não precise estritamente. Se você não precisa de sobrenome, não peça.

Compacte o checkout em quantos passos o processador de pagamento permitir.

Mostre uma barra de progresso. Os usuários toleram longitude quando conseguem ver o fim.

Ofereça Apple Pay, Google Pay e pelo menos uma carteira local por região.

Permita checkout como convidado. Forçar cadastro antes da compra é o assassino de conversão mais comum que eu vejo.

A Costa Coffee usou o UXCam para identificar a fricção no cadastro e redesenhou a etapa de cadastro, elevando os registros em 15%.

Passo 6. Conquistar confiança de forma visível

Os usuários convertem quando se sentem seguros. No mobile, os sinais de confiança precisam ser compactados e inequívocos:

Selos claros de SSL e segurança de pagamento perto do botão de pagar

Avaliações e depoimentos reais, idealmente com nomes e fotos

Um resumo de privacidade visível nos prompts de permissão

Preços transparentes, incluindo o que é gratuito e o que é cobrado depois de um teste

Passo 7. Comparar com benchmarks, depois comparar de novo

Você não pode otimizar o que não mede de forma consistente. Defina um ritmo semanal:

Compare a taxa de conversão macro desta semana com a da semana passada, do mês passado e com a baseline móvel de 90 dias.

Acompanhe as três principais taxas de microconversão que alimentam a macro.

Compare com benchmarks públicos da indústria quando disponíveis. Adjust e AppsFlyer publicam benchmarks mobile específicos por setor trimestralmente, e o State of Mobile do data.ai é a referência intersetorial que eu consulto uma vez por trimestre.

14 padrões e armadilhas de CRO mobile

Essas são as descobertas específicas que aparecem repetidamente quando eu faço uma passagem por um produto. Cada uma merece uma passagem de revisão dedicada.

1. O prompt de permissão no momento errado

Apps que pedem permissão de push, localização ou tracking no primeiro lançamento veem taxas de negação acima de 60%. Adie o prompt até o usuário ter visto o valor, idealmente atrelado a uma funcionalidade que precisa da permissão, seguindo as Diretrizes de Interface Humana da Apple. Para ATT especificamente, os dados de benchmark de ATT da Adjust mostram que as taxas de opt-in dobram ou triplicam quando o pre-prompt explica o valor antes do diálogo do sistema disparar.

2. O CTA secundário roubando toques do primário

Heatmaps mostram consistentemente que, quando um link "Pular" ou "Saiba mais" fica perto do CTA primário, ele suga de 15 a 30% dos toques pretendidos. Mova-o para uma zona diferente ou reduza seu peso visual. A correção mais rápida que eu vi entrar em produção foi rebaixar o link "Talvez depois" para um link cinza pequeno enfiado abaixo da dobra, o que elevou o início de testes em 11% em uma semana.

3. Dead taps em elementos não interativos

Os usuários tocam em imagens, ícones e fundos de card esperando que sejam links. A detecção de dead tap do UXCam mostra exatamente onde isso acontece. Ou torne o elemento tocável ou redesenhe-o para que não pareça interativo. A pesquisa do Nielsen Norman Group sobre tamanho de tap target é a referência que vale a pena manter aberta durante revisões de design.

4. Teclado cobrindo o campo de entrada

No Android especialmente, um campo de formulário que fica encoberto pelo teclado mata a taxa de conclusão. Teste com todas as alturas de teclado principais, incluindo Gboard com autocomplete e SwiftKey. A documentação de ajuste de teclado do Android cobre a correção.

5. Forçar criação de conta antes do valor

Deixar os usuários experimentarem o produto antes do cadastro eleva a ativação em 20-40% de forma rotineira. A famosa colocação do cadastro do Duolingo na lição três, não na lição zero, é o exemplo canônico. O trabalho sobre modelo de crescimento da Reforge descreve por que o cadastro postergado se acumula ao longo do loop de aquisição, não apenas na primeira sessão.

6. Cadastro longo sem social login

Adicionar Apple, Google e uma opção de social login regional encurta o cadastro em cerca de 40 segundos em média. Isso importa mais do que qualquer reorganização de campos. O Sign in with Apple da Apple agora é obrigatório no iOS se você oferece qualquer outra auth de terceiro, então não há razão para não adicionar.

7. Estados de erro que não recuperam o usuário

Um pagamento que falha e joga o usuário de volta em um carrinho vazio é um assassino de conversão. Preserve o carrinho, mostre a razão específica da falha e ofereça um método de pagamento alternativo inline. O guia de tratamento de erros da Stripe é uma baseline sólida para os códigos específicos que vale trazer à tona versus esconder.

8. Onboarding que ensina em vez de ativar

Tooltips que explicam cada ícone são um sinal de que a UI não é autoevidente. Substitua-os por uma única tarefa de ativação que entregue valor real em menos de 60 segundos. A pesquisa de onboarding da NN/g é a melhor referência aqui.

9. Sem indicação de progresso em fluxos de múltiplos passos

Usuários que não conseguem ver o fim de um fluxo o abandonam. Um indicador simples "Passo 2 de 4" eleva a conclusão de forma significativa. O efeito é mais forte em fluxos com mais de três passos, em que o usuário não consegue estimar mentalmente quanto trabalho resta.

10. Paywall acionado antes do aha moment

Se o seu paywall aparece antes de o usuário ter sentido o valor central, você está otimizando para bounce, não para receita. Mova o paywall para disparar depois que o usuário conclui a única ação que prediz retenção em D7. Os benchmarks de assinatura da RevenueCat mostram que apps com paywalls acionados por comportamento convertem 40-60% melhor do que os acionados por tempo.

11. Notificações push genéricas

Notificações push em batch-and-blast treinam os usuários a desabilitá-las. Pushes acionados e baseados em comportamento convertem de 3 a 5 vezes melhor, de acordo com os dados de benchmark da Airship. Comece com três gatilhos comportamentais (ação abandonada, marco alcançado, recomendação personalizada) antes de construir a matriz de mensagens completa.

12. Prompt de avaliação in-app no momento errado

Pedir uma avaliação depois de uma sequência de rage taps rende avaliações de uma estrela. Atrele o prompt a um momento confirmado de sucesso: pedido entregue, marco de streak, treino bem-sucedido. A API de avaliação do StoreKit da Apple limita os prompts a três por ano, então cada um tem que valer.

13. Áreas de toque pequenas

A Apple recomenda no mínimo 44x44 pontos. O Google recomenda 48dp. Dados de heatmap de apps que eu audito mostram rotineiramente aumento de conversão quando os alvos são ampliados para 52-56dp, especialmente para usuários acima de 45 anos. A diretriz WCAG 2.5.5 sobre tamanho de alvo dá a você a justificativa de acessibilidade caso precise rebater um designer que queira espaçamento mais apertado.

14. Sem tratamento de estado offline

Usuários em metrôs, aviões e wifi instável desistem quando uma tela mostra um spinner eterno. Faça cache do último estado bom e apresente um padrão claro de "Você está offline, eis o que ainda dá para fazer". A biblioteca de padrões offline-first tem exemplos concretos para as telas mais comuns.

Considerações de CRO específicas por indústria

O framework de 7 passos é universal. As táticas que mais importam mudam por vertical.

Fintech e bancos

Confiança e compliance são as alavancas de conversão, não velocidade sozinha. O drop-off de KYC normalmente é o maior vazamento, e a correção quase sempre é dividir a verificação de identidade em divulgação progressiva: peça o que for necessário para desbloquear o próximo passo de valor, não tudo de uma vez. A pesquisa da Plaid sobre linkagem de conta mostra consistentemente taxas de conclusão abaixo de 50% para fluxos de primeira vez, então instrumente cada handoff para o provedor de identidade e assista aos replays.

E-commerce e varejo

Abandono de carrinho é a métrica dominante. Apple Pay e Google Pay normalmente elevam a conversão mobile em 20-30% na primeira compra. Performance da página de produto em 3G e Android econômico não é negociável. Construa o CRO em torno das quatro páginas de maior impacto: categoria, detalhe do produto, carrinho e checkout, nessa ordem.

On-demand e marketplace

Tempo até a primeira transação bem-sucedida é a métrica norte. Permissão de localização, configuração de pagamento e resgate de promo do primeiro pedido são as três microconversões que predizem retenção. Session replay nas telas de mapa e busca normalmente traz à tona as maiores correções, porque são as telas com mais conteúdo dinâmico e mais formas de falhar silenciosamente.

Saúde, fitness e bem-estar

O aha moment normalmente fica de 3 a 7 sessões depois, não na primeira sessão, então as metas de CRO precisam ser ponderadas por retenção. O aumento de 460% de tempo no app da Inspire Fitness veio de reconstruir o onboarding em torno de um treino real, não de um tutorial. O timing do paywall é a única variável mais testada nessa vertical.

SaaS e B2B

Ativação, não cadastro, é a conversão macro que importa. Um primeiro projeto concluído, colega convidado ou integração conectada prediz o LTV muito melhor que a verificação de email. Instrumente a ativação como um funil de múltiplos eventos e segmente por tamanho de empresa e cargo.

Mídia e streaming

Taxa de play e retorno em segunda sessão são as métricas de conversão pareadas. Configurações de autoplay, qualidade de vídeo consciente de rede e telas iniciais personalizadas são as três principais variáveis. Fique atento a rage taps em barras de busca de tempo e em spinners de buffer, que se correlacionam fortemente com abandono de sessão.

Ferramentas de CRO mobile por categoria

Nenhuma ferramenta sozinha cobre tudo. Aqui está a stack que eu vejo funcionando em 2026.

Product intelligence e analytics: UXCam para session replay, heatmaps, funis, issue analytics e Tara AI. Mixpanel e Amplitude para análise de funil e coorte baseada em eventos.

Teste A/B e feature flags: Statsig, Optimizely, LaunchDarkly e Firebase Remote Config para experimentação e rollouts escalonados.

Atribuição e MMP: Adjust, AppsFlyer e Branch para medição de aquisição paga e deep linking.

Monitoramento de crash e performance: Firebase Crashlytics, Sentry e Instabug para detecção de crash e ANR, pareados com o issue analytics do UXCam para fricção na camada de UX.

Mensageria e engajamento com cliente: Braze, Iterable e OneSignal para ciclo de vida e push. Intercom para suporte in-app.

Pesquisa e qualitativa: UserTesting, Maze e Survicate para pesquisa moderada e não moderada.

Assinatura e receita: RevenueCat e Adapty para gestão de assinaturas, testes de paywall e analytics de receita no iOS e Android.

10 erros comuns de CRO mobile

Otimizar para cadastro em vez de ativação. Você acaba com números de vaidade e uma curva de retenção furada.

Rodar testes A/B sem tráfego suficiente para significância. Apps de baixo tráfego devem se apoiar em evidência qualitativa e publicar com base em sinal direcional, em vez de esperar meses por p<0,05.

Confiar em funis agregados. A média esconde a coorte que está quebrando. Sempre segmente por aparelho, OS, país e fonte.

Ignorar aparelhos Android de camada econômica. Se 40% dos seus usuários estão em aparelhos com 2-4GB de RAM, é aí que vive seu próximo aumento de 10% em conversão.

Testar polimento visual antes de corrigir fluxos quebrados. Cantos arredondados nunca salvaram um funil. Corrija os dead taps primeiro.

Tratar rage taps como um problema de engenharia. Eles são o sinal mais claro de conversão perdida. Coloque-os no backlog de crescimento.

Copiar concorrentes sem instrumentação. A colocação do paywall deles funcionou para a curva de retenção deles, não para a sua.

Usar ferramentas de web analytics no mobile. O tracking baseado em URL perde telas, gestos e estados in-app em que vive a maior parte da fricção.

Publicar o teste sem plano de rollback. Rollouts escalonados com feature flags impedem que uma variante ruim incinere seus números semanais.

Não fechar o ciclo. O experimento foi publicado, a métrica se mexeu e ninguém assistiu aos replays para confirmar que a experiência do usuário realmente melhorou. Você precisa de números E de evidência.

Modelo de Maturidade de CRO

Use isto como um diagnóstico. A maioria das equipes que eu audito está no nível 2 e acha que está no nível 4.

Nível 1: Às cegas

Você acompanha instalações e um evento macro. Sem segmentação, sem replay, sem funis. Próximo passo: instale um SDK de autocapture como o UXCam, defina sua conversão macro e instrumente seis microeventos em torno dela. Conte com duas semanas de setup.

Nível 2: Contando

Você tem funis e sabe onde o drop-off acontece. Você não consegue explicar o porquê. Próximo passo: adicione session replay e heatmaps. Assuma o compromisso de assistir a 20 sessões de drop-off por semana e escrever os três principais padrões de fricção.

Nível 3: Diagnosticando

Você assiste a replays, segmenta drop-offs e tem um backlog de hipóteses de fricção. A experimentação é ad hoc. Próximo passo: instale uma ferramenta de feature flag e de teste A/B, defina as guardrails do teste (tamanho de amostra, duração, métricas de guardrail) e rode um teste por vez com hipóteses documentadas.

Nível 4: Experimentando

Você publica três ou mais testes por mês, mede métricas primárias e de guardrail, e tem uma definição de vitória ponderada por retenção. Próximo passo: atrele as metas de CRO ao LTV e à retenção em D30, não ao cadastro. Traga o issue analytics para o mesmo backlog dos experimentos de crescimento.

Nível 5: Acumulando

CRO é um ritmo operacional semanal. A Tara AI sinaliza os padrões, os replays validam as hipóteses, os experimentos são publicados e as curvas de retenção sobem trimestre a trimestre. Próximo passo: faça treinamento cruzado entre produto, engenharia e marketing nos mesmos dashboards, e comece a publicar aprendizados externamente. Equipes nesse nível tendem a recrutar melhor porque falam sobre evidência em público.

Começando: seus primeiros 30 dias

Se você está saindo do Nível 1 ou 2, aqui está a cadência que te leva a uma prática de CRO funcional em um mês.

Semana 1: Instale o UXCam, combine uma conversão macro e publique um esquema de eventos rascunhado cobrindo de seis a dez microeventos. Valide os eventos assistindo a cinco replays por etapa para confirmar que eles disparam no momento certo. Anote a taxa de baseline atual para a macro e para cada micro.

Semana 2: Segmente o funil por classe de aparelho, OS, país e fonte de tráfego. Identifique o único segmento com pior performance. Assista a 20 replays de drop-off nesse segmento e agrupe o que você vê em três ou quatro padrões de fricção. Escreva cada um como uma hipótese de uma linha.

Semana 3: Escolha a hipótese de maior ICE e publique a correção mais simples possível atrás de uma feature flag. Para a maioria das equipes, isso é uma mudança de copy, um reposicionamento de CTA ou a remoção de um campo de formulário. Meça o delta de conversão e uma métrica de guardrail (normalmente retenção em D7 ou receita por usuário).

Semana 4: Revise o resultado com stakeholders, tocando um replay vencedor e um perdedor. Documente o aprendizado em um doc compartilhado independentemente do resultado. Escolha a próxima hipótese. A meta no fim do primeiro mês não é uma única grande vitória. É um loop repetível.

O que eu vejo funcionando em 2026

Três padrões de auditorias recentes que vale a pena destacar:

Triagem de sessão assistida por IA. Assistir a 50 replays costumava levar meio dia. A Tara AI lê sessões, agrupa os padrões de fricção e traz à tona os três ou quatro que importam. Isso comprime o loop de hipótese de semanas para dias.

CRO ponderado por retenção. Equipes que otimizam apenas para cadastro acabam com churn alto. As que estão ganhando estão atrelando as metas de CRO à retenção em D7 e D30, não só à primeira compra.

Issue analytics como insumo de CRO. Rage taps e congelamentos de UI frequentemente são a razão real por trás de uma queda no funil. Tratá-los como bugs de engenharia separados do backlog de CRO é um erro. É o mesmo trabalho.

Leituras relacionadas

Perguntas frequentes

Qual é uma boa taxa de conversão para um app mobile?

Depende fortemente da vertical e da definição de conversão. Para install-to-signup, uma faixa saudável é de 25-40%. Para signup-to-paying-user, apps de fintech e SaaS comumente veem 2-5%, enquanto games freemium ficam abaixo de 2%. Apps de e-commerce geralmente convertem visitantes em compradores a 1-3%. Mais útil do que o número da indústria é a sua própria tendência: você está melhorando semana a semana para as mesmas fontes de tráfego? Esse é o único benchmark que importa para decisões operacionais.

Qual a diferença entre otimização da taxa de conversão de apps e CRO web?

Três diferenças estruturais. Primeiro, o mobile não tem URLs, então você precisa de um SDK que capture telas e gestos em vez de page loads. Segundo, a fragmentação de aparelhos mobile significa que uma mudança que eleva a conversão no iPhone pode derrubá-la em um Android de baixo custo, então teste segmentado é obrigatório. Terceiro, sessões mobile são mais curtas e mais interrompidas, então alcance do polegar, uso com uma mão e tolerância a offline viram variáveis de CRO que simplesmente não existem no desktop. A disciplina por baixo é a mesma, mas o ferramental e os playbooks têm que ser reconstruídos.

Quais métricas devo acompanhar primeiro para CRO?

Comece com uma conversão macro claramente definida e de seis a dez microconversões que a precedem. Depois adicione coortes de retenção em D1, D7 e D30 para você não hiperotimizar para um balde furado. No lado qualitativo, acompanhe rage taps, congelamentos de UI e dead taps como proxies de fricção. O issue analytics e os funis do UXCam te dão todos esses em um só lugar, o que importa porque alternar entre ferramentas normalmente significa alternar entre números conflitantes.

Quanto tempo leva para ver resultados de CRO mobile?

Para instrumentação e primeiros insights, cerca de duas semanas. Para mudanças publicadas mostrarem aumento de conversão estatisticamente significativo, normalmente de quatro a oito semanas, dependendo do seu volume de tráfego. Apps de baixo tráfego devem esperar mais perto de oito semanas por teste. Apps de alto tráfego com dezenas de milhares de sessões diárias podem rodar múltiplos testes concorrentes e publicar em ciclos de duas semanas. O maior consumidor de tempo quase sempre é a instrumentação, por isso SDKs de autocapture se pagam rapidamente.

Dá para rodar testes A/B dentro do UXCam?

O UXCam é uma product intelligence platform e product analytics, então o papel primário é diagnosticar o que testar e medir o que aconteceu depois. A maioria das equipes o pareia com uma ferramenta de experimentação dedicada para o mecanismo de aleatorização e estatística. O workflow que costuma funcionar: use session replay do UXCam, heatmaps e as recomendações de IA da Tara para gerar a hipótese, rode o experimento na sua ferramenta de A/B, depois volte aos funis e replays do UXCam para validar que a variante vencedora realmente melhorou a jornada do usuário, não só uma métrica.

O CRO mobile ainda importa se a maior parte do meu tráfego vem de anúncios pagos?

Importa mais, não menos. Tráfego pago aumenta o custo de cada passo vazante no seu funil. Se você está pagando US$ 4 por instalação e perdendo 60% dos usuários no cadastro, você está pagando US$ 10 por cada usuário ativado. Uma melhoria de 10% na conclusão de cadastro reduz diretamente seu CAC efetivo na mesma proporção. As equipes que eu vejo tirando mais alavancagem do gasto pago são as que tratam CRO e aquisição como um único P&L, não como departamentos separados.

Quantas microconversões eu deveria acompanhar por macro?

Seis a dez é o ponto ideal. Menos de seis e você perde o detalhe de diagnóstico quando a macro cai. Mais de dez e o sinal fica diluído entre eventos que ninguém olha de fato. A disciplina é escolher os microeventos que predizem a macro, não os que são fáceis de instrumentar.

De que tamanho de amostra eu preciso para um teste A/B mobile?

Depende da taxa de conversão baseline e do efeito mínimo detectável que você se importa. Para uma baseline de 10% e um lift relativo de 10% com 80% de poder, planeje cerca de 15.000 usuários por variante. Ferramentas como a calculadora do Evan Miller te darão o número exato. Se seu tráfego não suportar isso em quatro a seis semanas, apoie-se em evidência qualitativa e publique com base em sinal direcional em vez de esperar meses.

Devo otimizar iOS e Android separadamente?

Normalmente sim. Taxas de conversão, capacidades de aparelho, padrões de pagamento e expectativas do usuário divergem o suficiente para que uma abordagem de otimização unificada deixe ganho em cima da mesa. Instrumente as duas plataformas de forma idêntica, mas segmente cada funil e análise de replay por OS. As equipes que mais me surpreendem são as que descobrem que seus funis de iOS e Android caem em passos completamente diferentes.

Como priorizo qual experimento de CRO rodar primeiro?

Eu uso um score ICE (impacto, confiança, facilidade) em cada hipótese, mas o critério de desempate é sempre a força da evidência. Uma hipótese apoiada por dez replays de usuários com dificuldade vence uma hipótese apoiada por um post de blog sobre a vitória de outra empresa. A confiança deve vir dos seus próprios dados, não do estudo de caso de outra pessoa.

O session replay deixa meu app mais lento?

Um SDK de replay bem construído adiciona menos de 2% de overhead de CPU e algumas centenas de kilobytes ao tamanho do app. O SDK do UXCam é construído para uso em produção em dezenas de milhares de apps e usa compressão no aparelho, então o impacto de rede é mínimo. O ROI é gigante. Dez minutos assistindo normalmente economiza uma semana de debate.

Como eu cons

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

ÍNDICE

- Principais conclusões

- O que é otimização da taxa de conversão de apps?

- Conversões micro vs. macro: instrumente as duas

- Benefícios de fazer isso bem

- O framework de CRO mobile em 7 passos

- 14 padrões e armadilhas de CRO mobile

- Considerações de CRO específicas por indústria

- Ferramentas de CRO mobile por categoria

- 10 erros comuns de CRO mobile

- Modelo de Maturidade de CRO

- Começando: seus primeiros 30 dias

- O que eu vejo funcionando em 2026

- Leituras relacionadas

- Perguntas frequentes

Artigos relacionados

Melhores práticas para PMs

8 melhorias para aplicativos móveis fintech

Aqui estão 8 dicas de baixo esforço e alta recompensa para melhorar seu aplicativo móvel; 1. Adicione uma barra de progresso à integração 2. Adicione uma tela de integração 3. Use notificações por...

Hannah Squire

Product Analytics Expert

Melhores práticas para PMs

5 KPIs para medir a adoção de novas funcionalidades

As métricas de adoção de recursos mais importantes a serem medidas são: taxa de adoção de recursos, tempo para adoção, frequência de uso, taxa de retenção de usuários e taxa de...

Hannah Squire

Product Analytics Expert

Melhores práticas para PMs

Como medir, analisar e reduzir o churn no seu aplicativo

Mesmo se o seu aplicativo tiver a melhor taxa de aquisição do usuário do mercado, se você tiver o churn (cancelamento) alto, seus esforços serão em vão. Se você quiser saber por que os usuários estão desinstalando ou cancelando a assinatura do seu app, ferramentas como fluxo de tela, heatmaps e gravações de sessões podem fazer com que os usuários...

Luiza Drubscky

Growth Marketing