10 Melhores Ferramentas de A/B Testing para Aplicativos Móveis em 2026

ÍNDICE

- Como avaliamos estas ferramentas (metodologia)

- Principais conclusões

- As 10 melhores ferramentas de A/B testing para Apps Móveis

- Tabela comparativa

- 1. Statsig

- 2. Firebase A/B Testing

- 3. Optimizely

- 4. LaunchDarkly

- 5. Split

- 6. Apptimize

- 7. AB Tasty

- 8. Amplitude Experiment

- 9. VWO

- 10. UXCam (camada de behavioral analytics)

- Ferramentas que avaliei e excluí (e por quê)

- O que é A/B testing para aplicativos móveis?

- Como formar uma boa hipótese de A/B testing

- Discussões da comunidade que valem a leitura

- Melhore sua experimentação com o UXCam

- Perguntas frequentes

Ferramentas de A/B testing permitem que equipes de produto mobile sirvam duas ou mais variantes de uma experiência dentro do aplicativo para diferentes coortes de usuários, meçam qual variante move uma métrica escolhida e decidam qual delas vai para produção. A ferramenta que você escolhe importa menos do que a disciplina em torno do que testar, mas a escolha errada pode atrasar em semanas uma equipe disciplinada.

Eu avaliei mais de 15 ferramentas de experimentação mobile para esta lista e filtrei para 10 com base em quatro critérios (detalhados na metodologia abaixo). O cenário mudou bastante no último ano: plataformas feature-flag-first comeram uma parte grande do mercado que pertencia à Optimizely, e a Statsig em particular se destacou em preço, UX e qualidade de SDK mobile para equipes pequenas e médias.

Como avaliamos estas ferramentas (metodologia)

Cada ferramenta desta lista foi avaliada em quatro critérios, ponderados pelo quanto cada um importa para uma equipe de produto mobile:

Qualidade do SDK mobile (peso de 30%): suporte nativo a iOS, Android, React Native e Flutter. Tamanho do SDK, velocidade de inicialização, comportamento offline e compatibilidade com a revisão da App Store.

Rigor estatístico (peso de 25%): capacidade do motor de experimentação de calcular significância corretamente, suportar sequential testing, lidar com múltiplas métricas e evitar armadilhas estatísticas comuns (peeking, testes com pouco poder).

Acessibilidade de preço (peso de 25%): custo relativo ao valor para o tamanho da equipe. Planos gratuitos, transparência de preços e se a ferramenta exige um contrato enterprise para ser útil.

Encaixe no ecossistema (peso de 20%): integrações com ferramentas de analytics, relatórios de crash, pipelines de CI/CD e o fluxo de desenvolvimento mobile em geral.

Também considerei notas do G2 e Capterra como sinais externos de validação, sentimento da comunidade no Reddit (r/ProductManagement, r/ExperienceOptimization) e conversas diretas com PMs mobile usando essas ferramentas em produção.

As ferramentas estão ranqueadas na ordem que eu recomendaria para uma equipe mobile começando do zero em 2026. Seu ranking pode diferir dependendo do stack existente, tamanho da equipe e volume de experimentos.

Principais conclusões

Para a maioria das equipes mobile pequenas e médias em 2026, Statsig ou Firebase A/B Testing resolvem o caso de uso com um preço que faz sentido. Statsig se você se importa com velocidade de experimentação e profundidade analítica, Firebase se você já está mergulhado no ecossistema Google.

A Optimizely continua sendo o padrão enterprise, mas o preço empurrou muitas equipes para alternativas feature-flag-first como Statsig, Split e LaunchDarkly.

O melhor setup combina uma plataforma de experimentação com uma ferramenta de behavioral analytics (como o UXCam), para que você entenda não só qual variante venceu, mas por quê.

Não comece pela ferramenta. Comece por uma hipótese que nomeie a métrica, a coorte-alvo e o tamanho do efeito esperado. Sem esses três, nenhuma ferramenta vai salvar o experimento.

Fique atento a armadilhas específicas do mobile: ciclos de revisão da App Store, App Tracking Transparency (ATT) do iOS e apps offline-first onde experimentos não podem depender de chamadas de rede ao vivo.

As 10 melhores ferramentas de A/B testing para Apps Móveis

Statsig

Firebase A/B Testing

Optimizely

LaunchDarkly

Split

Apptimize

AB Tasty

Amplitude Experiment

VWO

UXCam (camada de behavioral analytics)

Tabela comparativa

| # | Ferramenta | Nota no G2 | Melhor para | Preço | Plano gratuito | SDKs mobile |

|---|---|---|---|---|---|---|

| 1 | Statsig | 4.8/5 (120+ avaliações) | Equipes pequenas e médias que querem experimentação + analytics | Gratuito até 1M de eventos, depois usage-based | Sim | iOS, Android, RN, Flutter |

| 2 | Firebase A/B Testing | 4.5/5 (como parte do Firebase) | Equipes já no ecossistema Google/Firebase | Gratuito | Sim | iOS, Android |

| 3 | Optimizely | 4.3/5 (500+ avaliações) | Programas de experimentação enterprise (20+ testes simultâneos) | ~$30K-50K/ano | Não | iOS, Android |

| 4 | LaunchDarkly | 4.7/5 (250+ avaliações) | Equipes feature-flag-first adicionando experimentos por cima | ~$10/mês por usuário | Trial de 14 dias | iOS, Android, RN |

| 5 | Split | 4.5/5 (90+ avaliações) | Equipes orientadas a dados onde engenheiros rodam experimentos | ~$8K/ano | Trial de 30 dias | iOS, Android |

| 6 | Apptimize | 4.3/5 (30+ avaliações) | Equipes mobile-only que precisam de mudanças por editor visual | Contato para orçamento | Não | iOS, Android, RN |

| 7 | AB Tasty | 4.5/5 (200+ avaliações) | Empresas europeias com requisitos de hospedagem de dados | ~$2K/mês | Não | iOS, Android |

| 8 | Amplitude Experiment | 4.5/5 (como parte do Amplitude) | Equipes que já usam Amplitude para product analytics | Add-on do Amplitude | Add-on | iOS, Android, RN |

| 9 | VWO | 4.3/5 (400+ avaliações) | Equipes web+mobile que querem um único fornecedor | ~$200/mês | Trial de 30 dias | iOS, Android |

| 10 | UXCam | 4.7/5 (200+ avaliações) | Entender por que as variantes de experimento ganham ou perdem | Gratuito até 3K sessões | Sim | iOS, Android, RN, Flutter, Web |

Notas do G2 consultadas em abril de 2026. Os preços são aproximados e mudam com frequência; sempre confirme com o fornecedor.

1. Statsig

Nota no G2: 4.8/5 (120+ avaliações) | Melhor para: equipes mobile pequenas e médias | Preço: gratuito até 1M de eventos/mês, depois usage-based

Minha principal escolha para a maioria das equipes mobile começando do zero em 2026. A Statsig combina feature flags, A/B testing e product analytics em uma única plataforma com um preço que faz sentido abaixo da escala enterprise. O suporte de SDK mobile é amplo (iOS, Android, React Native, Flutter), o motor estatístico lida bem com sequential testing e o plano gratuito cobre a maioria das equipes em estágio inicial.

Prós:

Plano gratuito generoso (1M de eventos por mês) que muitas equipes pequenas nunca superam

Motor de sequential testing permite parar experimentos mais cedo quando os resultados estão claros, economizando tempo e tráfego

Product analytics embutido significa que você não precisa de uma ferramenta de analytics separada para experimentos básicos

SDKs amigáveis ao desenvolvedor com boa documentação e um Slack comunitário responsivo

Contras:

O plano gratuito é baseado em eventos, então apps de alto volume podem superá-lo mais rápido do que o esperado

Se você já usa Amplitude ou Mixpanel, há alguma sobreposição de analytics

A marca é mais nova que Optimizely ou LaunchDarkly, então equipes de compras enterprise podem resistir

Por que é a #1: melhor combinação de qualidade de SDK mobile, rigor estatístico, preço e velocidade de iteração para equipes que não precisam (ou não querem) um contrato enterprise.

2. Firebase A/B Testing

Nota no G2: 4.5/5 (como parte do Firebase) | Melhor para: equipes nativas do Firebase | Preço: gratuito

O A/B testing mobile nativo do Google, rodando em cima do Remote Config. Gratuito em qualquer escala, integração profunda com o resto do Firebase (Analytics, Crashlytics, Cloud Messaging, Remote Config) e a integração de SDK iOS/Android mais limpa se você já está no ecossistema Firebase.

Prós:

Totalmente gratuito, sem limites de eventos para experimentação

Integração forte com Firebase Analytics, Crashlytics e Remote Config

Setup simples se você já usa o Firebase para analytics e push

Inferência bayesiana disponível junto com frequentista

Contras:

A análise estatística é básica comparada à Statsig ou Optimizely

A UI de gerenciamento de experimentos é travada para gerenciar mais de 5-10 experimentos simultâneos

Segmentação de audiência limitada comparada a ferramentas dedicadas de experimentação

Sem suporte nativo a testes multivariados

Por que é a #2: imbatível para equipes já no ecossistema Google que precisam de experimentação básica a custo zero.

3. Optimizely

Nota no G2: 4.3/5 (500+ avaliações) | Melhor para: programas de experimentação enterprise | Preço: ~$30K-50K/ano

O padrão enterprise. Conjunto amplo de funcionalidades, rigor estatístico forte, SDKs mobile maduros e suporte sólido a testes multivariados e personalização. Se você roda mais de 20 experimentos simultâneos e tem uma equipe dedicada de experimentação, a Optimizely ainda se sustenta.

Prós:

A plataforma de experimentação mobile mais madura do mercado

Recursos avançados de multivariado e personalização

Motor estatístico forte com stats accelerator para resultados mais rápidos

APIs e SDKs bem documentadas com longo histórico

Contras:

O preço começa em ~$30K-50K/ano, o que exclui a maioria das equipes não enterprise

Recursos específicos de mobile não receberam tanto investimento nos últimos 18 meses quanto o lado web

A UI pode parecer pesada para equipes que rodam menos de 10 experimentos por vez

Por que é a #3: a escolha certa para programas enterprise onde o orçamento existe e o volume de experimentação justifica o investimento. Não é custo-efetiva para equipes menores.

4. LaunchDarkly

Nota no G2: 4.7/5 (250+ avaliações) | Melhor para: equipes feature-flag-first | Preço: ~$10/mês por usuário

Plataforma feature-flag-first que adicionou A/B testing como extensão do produto principal. A maioria das empresas que usam LaunchDarkly escolheu a ferramenta por gerenciamento de releases e flagging, e depois colocou experimentos por cima.

Prós:

Excelente gerenciamento de feature flags (o melhor da categoria)

Integração natural entre "quais usuários veem esta feature" e "esta feature performa melhor"

SDKs mobile fortes com fallback de server-side rendering

Comunidade ativa de desenvolvedores e boa documentação

Contras:

Como ferramenta pura de experimentação, é mais fraca que Statsig ou Optimizely

Profundidade de analytics limitada; você precisará de uma ferramenta de product analytics separada

Preço por usuário se acumula rápido em equipes de produto maiores

Por que é a #4: ideal quando feature flags guiam seu processo de deploy e a experimentação é o próximo passo natural.

5. Split

Nota no G2: 4.5/5 (90+ avaliações) | Melhor para: equipes orientadas a dados | Preço: ~$8K/ano

Plataforma feature-flag-first com uma camada de analytics um pouco mais amigável para cientistas de dados que a LaunchDarkly. Boa cobertura de SDK mobile. Se posiciona como a alternativa orientada a desenvolvedores à LaunchDarkly.

Prós:

Tratamento forte de significância estatística para equipes letradas em dados

Boa atribuição entre experimentos

Suporta feature flags, kill switches e rollouts progressivos nativamente

Contras:

A experiência voltada ao product manager é menos polida que Statsig ou Optimizely

A marca é menos conhecida, o que dificulta compras em algumas empresas

Pouca transparência de preços (a maioria dos planos exige conversa com vendas)

Por que é a #5: uma escolha sólida quando a equipe de engenharia lidera a experimentação e se importa com rigor dos dados.

6. Apptimize

Nota no G2: 4.3/5 (30+ avaliações) | Melhor para: equipes mobile-only | Preço: contato para orçamento

Plataforma de A/B testing puramente focada em mobile. Historicamente forte na qualidade de SDK iOS e Android, lida bem com as restrições da App Store e suporta mudanças por editor visual sem ressubmissão. Faz parte do grupo Airship desde 2019.

Prós:

Feita de propósito para mobile, não uma ferramenta web com mobile enxertado

Editor visual para fazer mudanças sem deploys de código ou ciclos de revisão da App Store

Lida bem com cenários offline/cache para apps mobile-first

Contras:

O produto recebeu menos investimento que o lado de mensageria da Airship

A UX de experimentação parece uma geração atrás da Statsig

Preço opaco (apenas enterprise)

Comunidade menor significa menos aprendizados compartilhados e integrações

Por que é a #6: vale considerar para equipes mobile-only que precisam de edição visual (sem ressubmissão à App Store), mas a falta de UX moderna e preço transparente a empurra para fora do top 5.

7. AB Tasty

Nota no G2: 4.5/5 (200+ avaliações) | Melhor para: empresas europeias | Preço: ~$2K/mês

Plataforma europeia de experimentação com suporte forte a SDKs mobile e preço mais acessível que a Optimizely. Popular em varejo e mídia.

Prós:

Hospedagem de dados na UE (exigida por algumas interpretações de conformidade com a GDPR)

Editor visual maduro para experimentos web

Preço mais acessível que a Optimizely para equipes mid-market

Analytics e segmentação decentes embutidos

Contras:

Menor mindshare entre desenvolvedores nos EUA significa menos integrações e recursos de comunidade

O SDK mobile é bom, mas não é a melhor parte do produto

Ecossistema menor que Statsig ou Optimizely

Por que é a #7: a escolha natural para equipes da UE que precisam de hospedagem local de dados e não querem pagar os preços da Optimizely.

8. Amplitude Experiment

Nota no G2: 4.5/5 (como parte do Amplitude) | Melhor para: clientes existentes do Amplitude | Preço: add-on do Amplitude

O produto de experimentação do Amplitude, fortemente acoplado à plataforma de product analytics deles. Se você já usa Amplitude para analytics, o Experiment é o add-on natural que usa os mesmos eventos e coortes.

Prós:

A integração mais forte entre análise de coorte e segmentação de experimento da categoria

Usa a taxonomia de eventos existente do Amplitude (sem instrumentação duplicada)

Bom para equipes que querem segmentar e experimentar a partir da mesma interface

Contras:

Exige um contrato com o Amplitude; não é standalone

O preço se soma quando você adiciona o Experiment a um plano Amplitude existente

Não é motivo para migrar para o Amplitude se você está em outra plataforma de analytics

Por que é a #8: excelente para clientes existentes do Amplitude, pouco atrativa para os demais.

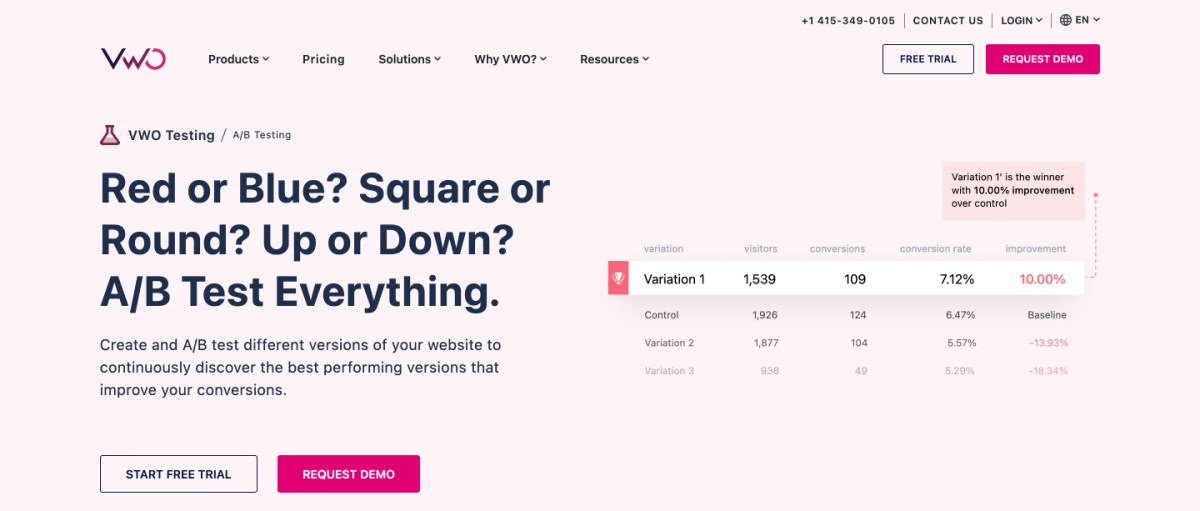

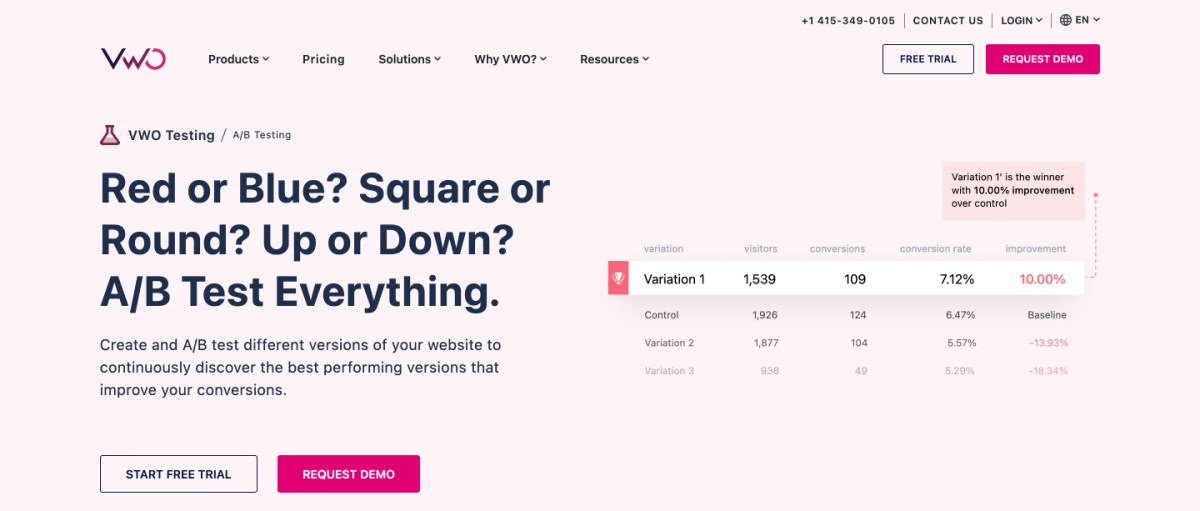

9. VWO

Nota no G2: 4.3/5 (400+ avaliações) | Melhor para: equipes web+mobile que querem um único fornecedor | Preço: ~$200/mês

Plataforma de experimentação web-first com suporte a SDK mobile, edição visual, analytics de formulários e gravação de sessão embutidos. Boa relação custo-benefício comparada à Optimizely.

Prós:

Conjunto amplo de funcionalidades em uma ferramenta só (experimentos, heatmaps, gravação de sessão, analytics de formulário)

Editor visual bem avaliado para testes de landing page

Preço acessível comparado a alternativas enterprise

Contras:

O SDK mobile é menos maduro que o produto web

Se mobile é seu caso de uso principal, ferramentas mobile-first encaixam melhor

Qualidade da gravação de sessão está abaixo de ferramentas dedicadas como UXCam ou FullStory

Por que é a #9: uma escolha razoável para equipes que dividem tempo entre web e mobile e querem um único fornecedor. Não é ideal se mobile é a plataforma principal.

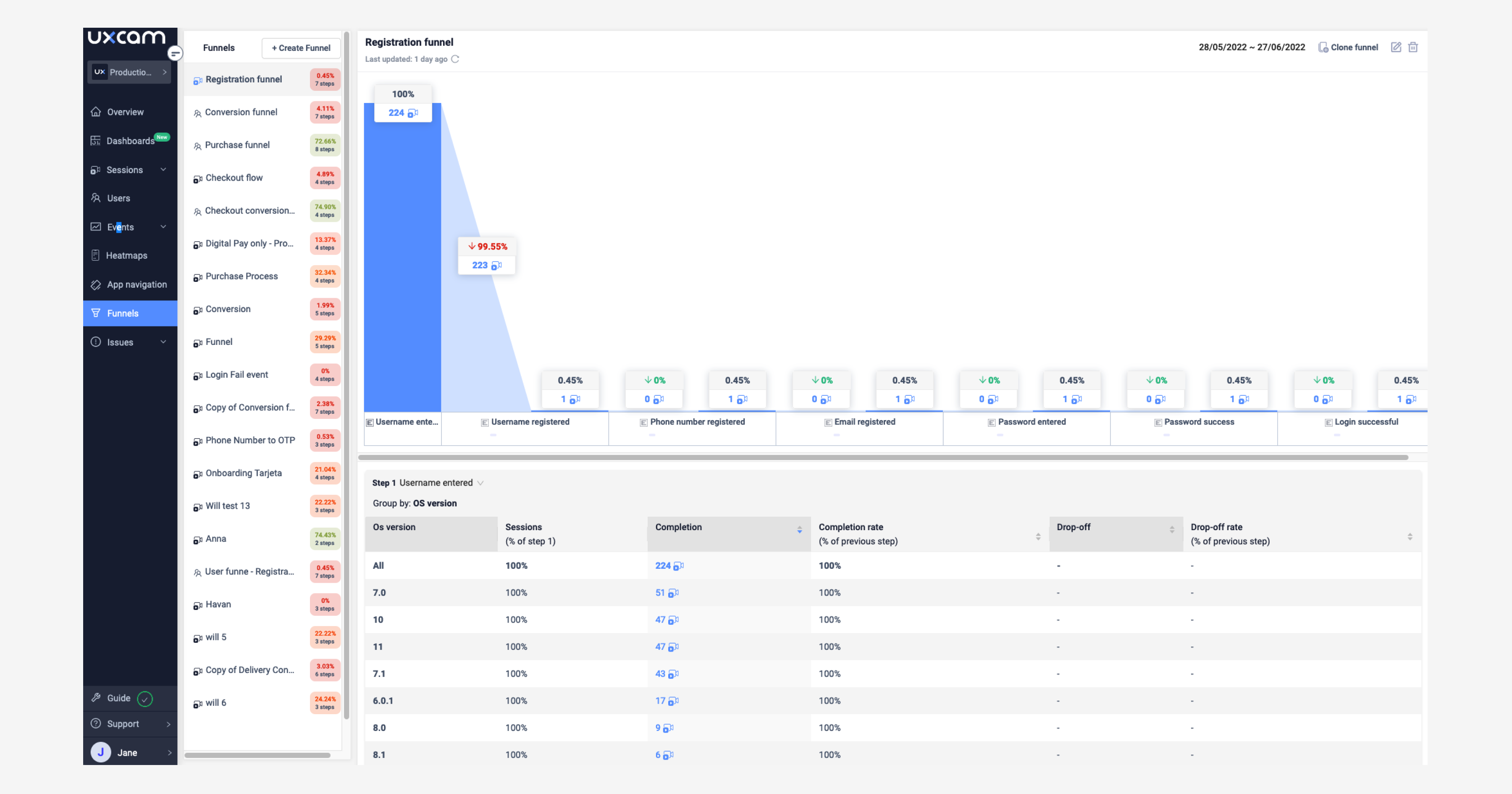

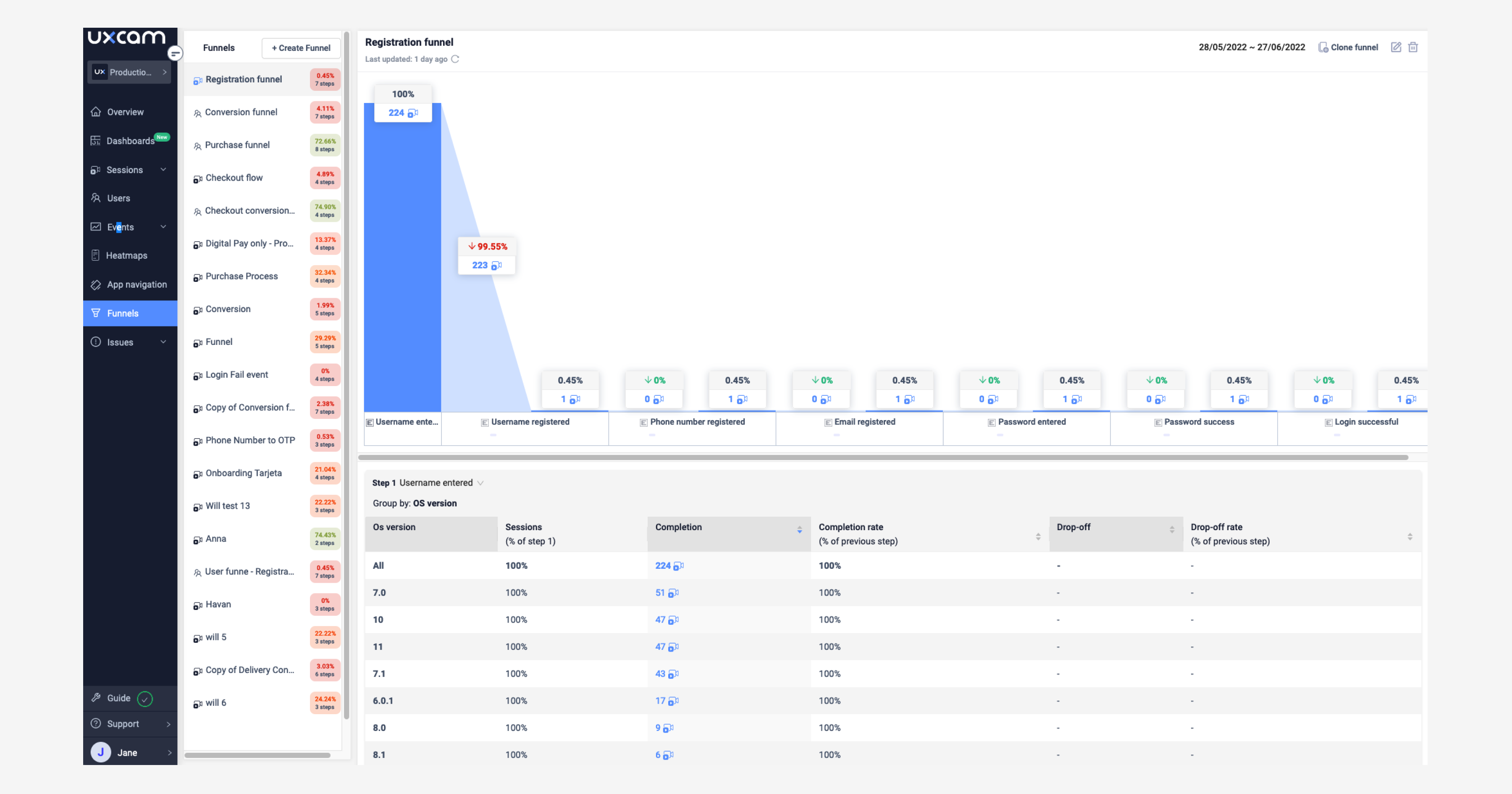

10. UXCam (camada de behavioral analytics)

O UXCam fica uma camada abaixo do A/B testing: a behavioral analytics que explica os resultados do seu experimento. Eu recomendo rodar o UXCam junto a qualquer plataforma de experimentação, porque ler o vencedor de um teste A/B é só metade do trabalho. A outra metade é entender por que os usuários em cada variante se comportaram de forma diferente.

Nota no G2: 4.7/5 (200+ avaliações) | Melhor para: entender os resultados de experimentos | Preço: gratuito até 3K sessões

Quando um experimento mostra um lift, eu quero saber o que especificamente mudou no comportamento do usuário. Quando mostra uma regressão, preciso ver qual parte do novo fluxo confundiu os usuários. O session replay do UXCam e a analista de IA Tara me permitem assistir a sessões filtradas por variante de experimento e trazer à tona os padrões comportamentais por trás do resultado estatístico.

Prós:

Session replay filtrado por variante de experimento revela o "porquê" por trás dos resultados do A/B test

A Tara AI resume padrões comportamentais em milhares de sessões automaticamente

Funciona junto com qualquer uma das 9 ferramentas acima (não é substituta, é complemento)

Plano gratuito (3K sessões) cobre o trabalho inicial de diagnóstico

Contras:

Não serve variantes nem calcula significância estatística; você ainda precisa de uma ferramenta de experimentação separada

O session replay adiciona peso ao SDK (~300KB) ao binário do seu app

Por que é a #10: não é uma ferramenta de experimentação, mas a camada de diagnóstico que torna cada experimento mais útil. A combinação de experimentação + behavioral analytics é o que separa equipes que iteram rápido das equipes que rodam experimentos e não aprendem nada.

Ferramentas que avaliei e excluí (e por quê)

Hotjar: forte para pesquisa qualitativa em web. Suporte mobile é limitado e A/B testing não é sua competência central. Use para pesquisas e heatmaps, não para experimentos.

Crazy Egg: similar ao Hotjar. Bom para heatmaps de landing page. O módulo de A/B testing é básico demais para experimentação séria.

Google Optimize: encerrado pelo Google em setembro de 2023. Se seu stack ainda referencia essa ferramenta, migre para Statsig ou Firebase.

Convert: o produto funciona, mas a comunidade e o ecossistema de integrações são finos o suficiente para que o custo de mudança não se justifique para a maioria das equipes.

O que é A/B testing para aplicativos móveis?

A/B testing é um método de comparar duas ou mais variantes de uma experiência de aplicativo móvel, servindo cada variante para uma coorte aleatoriamente atribuída de usuários e medindo o efeito em uma métrica escolhida. As variantes podem ser qualquer coisa: texto de botão, fluxo de onboarding, layout do paywall, preços, disponibilidade de funcionalidade. O propósito é substituir achismo por um sinal medido antes de lançar uma mudança para todo mundo.

A parte estatística: você precisa de usuários suficientes em cada variante para ver um efeito real acima do ruído aleatório. Um experimento mobile típico precisa de milhares de sessões por variante. Ferramentas que calculam significância estatística evitam que você lance um "vencedor" que era, na verdade, apenas variância.

Como formar uma boa hipótese de A/B testing

Uma boa hipótese tem três partes: uma mudança específica, uma coorte nomeada e um efeito esperado em uma métrica mensurável. O template que eu uso:

"Se mudarmos [coisa específica] para [coorte-alvo], esperamos que [métrica] [se mova em direção] em [magnitude] porque [razão do comportamento do usuário]."

Exemplo: "Se removermos a verificação de telefone do fluxo de cadastro para usuários iOS de primeira vez, esperamos que a taxa de conclusão do cadastro aumente em 15% porque os session replays mostram 22% dos usuários abandonando nessa etapa."

A parte do "porque" é a mais difícil e a mais importante. Sem uma razão fundamentada em comportamento observado, o experimento é um chute com planilha. Eu gero a maioria das minhas hipóteses assistindo a session replays de usuários que não converteram, e depois nomeando a fricção específica que cada replay revela.

Discussões da comunidade que valem a leitura

r/ProductManagement, r/marketing e o Slack da comunidade Statsig são as comunidades ativas para discussões sobre ferramentas de A/B testing. O Google está cada vez mais trazendo threads do Reddit para buscas de comparação de ferramentas, então se manter alinhado com o sentimento real dos usuários importa.

Marcas que usuários do Reddit mencionam com frequência para A/B testing mobile (no início de 2026): Statsig, Firebase, LaunchDarkly e Amplitude Experiment. Optimizely aparece em threads enterprise. Apptimize e AB Tasty têm menos presença em discussões orgânicas.

Melhore sua experimentação com o UXCam

O UXCam é uma product intelligence platform que captura automaticamente toda interação do usuário, sem marcação manual. Ele não roda testes A/B, mas te diz por que uma variante venceu e a outra não, que é a etapa que a maioria dos programas de experimentação pula. A Tara, analista de IA do UXCam, consegue filtrar session replays por variante de experimento e trazer à tona os padrões comportamentais que explicam seus resultados estatísticos, dando a equipes de produto insights baseados em evidência para compartilhar com stakeholders.

Combine qualquer plataforma de experimentação acima com o session replay do UXCam e você fecha o loop entre "o que venceu" e "por que venceu". Instalado em mais de 37.000 produtos, mobile-first e agora pronto para web.

Peça uma demo para ver o fluxo no seu app.

Perguntas frequentes

O que é A/B testing em aplicativos móveis?

A/B testing em aplicativos móveis é a prática de servir duas ou mais variantes de uma experiência dentro do app para coortes de usuários atribuídas aleatoriamente e medir qual variante move mais uma métrica escolhida. É o método padrão para tomar decisões de produto baseadas em dados antes de lançar uma mudança para todos os usuários.

Qual ferramenta de A/B testing é a melhor para uma equipe mobile pequena?

Statsig ou Firebase A/B Testing. As duas têm planos gratuitos significativos. A Statsig é a melhor escolha se você se importa com velocidade de experimentação e quer analytics embutido. O Firebase é a melhor escolha se você já usa outros produtos Firebase e quer custo zero de fornecedor adicional.

Quantos usuários eu preciso para rodar um teste A/B mobile?

Pelo menos 1.000 a 2.000 usuários por variante para detectar um efeito de 5% ou maior. Para efeitos menores (2-3%), você precisará de 5.000+ por variante. Apps com menos de 10K MAU devem focar em testes maiores e mais óbvios, onde o tamanho do efeito é maior, em vez de tentar detectar mudanças sutis.

Qual a diferença entre A/B testing e feature flags?

Feature flags ligam ou desligam uma funcionalidade para usuários específicos. Testes A/B usam feature flags como mecanismo de entrega, mas adicionam atribuição aleatória de variantes e análise estatística para determinar qual variante performa melhor. A maioria das plataformas modernas (Statsig, LaunchDarkly, Split) oferece os dois recursos juntos.

Dá para fazer A/B testing em iOS com App Tracking Transparency?

Sim. A chave: atribuir variantes com base em um identificador first-party estável (Firebase Installation ID ou seu próprio user ID após o cadastro), não IDFA. Medir eventos de conversão dentro do app, não atribuição cross-network. O ATT limita rastreamento cross-app, não experimentação dentro do app.

Quanto tempo um teste A/B mobile deve rodar?

Pelo menos uma semana inteira (para cobrir padrões comportamentais semanais) e tempo suficiente para atingir significância estatística. Para a maioria dos apps mobile, isso significa de 1 a 3 semanas por teste. Menos de uma semana arrisca viés do ciclo semanal. Mais de 4 semanas arrisca confundimento por mudanças sazonais ou atualizações do app.

Qual o maior erro que equipes cometem com A/B testing?

Rodar experimentos sem uma hipótese comportamental. Vejo equipes lançarem testes A/B onde a previsão é "a gente acha que isso vai ser melhor" sem nenhuma razão observada para achar isso. A maioria desses experimentos não produz resultados significativos, desperdiçando tráfego e tempo. Comece com session replay e funis para achar a fricção específica que vale testar, e depois rode o experimento.

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

ÍNDICE

- Como avaliamos estas ferramentas (metodologia)

- Principais conclusões

- As 10 melhores ferramentas de A/B testing para Apps Móveis

- Tabela comparativa

- 1. Statsig

- 2. Firebase A/B Testing

- 3. Optimizely

- 4. LaunchDarkly

- 5. Split

- 6. Apptimize

- 7. AB Tasty

- 8. Amplitude Experiment

- 9. VWO

- 10. UXCam (camada de behavioral analytics)

- Ferramentas que avaliei e excluí (e por quê)

- O que é A/B testing para aplicativos móveis?

- Como formar uma boa hipótese de A/B testing

- Discussões da comunidade que valem a leitura

- Melhore sua experimentação com o UXCam

- Perguntas frequentes

Artigos relacionados

Ferramentas para aplicativos

UXCam X Amplitude: entenda como as plataformas se comparam

Amplitude é uma plataforma de análise de dados que fornece insights sobre o comportamento do usuário e a UXCam é uma solução de analytics exclusiva para apps móveis, qual é a melhor opção para...

Luiza Drubscky

Growth Marketing

Ferramentas para aplicativos

19 Melhores ferramentas de análise de apps móveis 2026

Escolher as melhores ferramentas e plataformas de analytics de aplicativos móveis para o seu app pode ser muito trabalhoso. Mas não se preocupe! Nós já fizemos essa pesquisa pra...

Jonas Kurzweg

Product Analytics Expert

Ferramentas para aplicativos

10 Melhores Ferramentas de A/B Testing para Aplicativos Móveis em 2026

As 10 melhores ferramentas de A/B testing para aplicativos móveis em 2026, avaliadas pela qualidade do SDK mobile, rigor estatístico, preço e encaixe com...

Silvanus Alt, PhD

Founder & CEO | UXCam