Digital analytics é a coleta, mensuração e análise de dados quantitativos e qualitativos de canais digitais (sites, aplicativos móveis, dispositivos conectados, campanhas de marketing) usados para melhorar a experiência do usuário, a performance de marketing e os resultados de negócio. Tudo o mais neste guia é um esclarecimento dessa definição.

O motivo de eu começar pela resposta de manual: o termo "digital analytics" é usado com tanta liberdade que as equipes acabam discutindo sobre ferramentas quando, na verdade, estão fazendo trabalhos diferentes. Web analytics, product analytics, marketing analytics e customer experience analytics são todos subconjuntos de digital analytics, e cada um usa uma parte diferente dos mesmos dados. Saber em qual fatia da torta você está trabalhando economiza semanas de confusão.

Neste guia, vou passar pelos quatro tipos de digital analytics (descritivo, diagnóstico, preditivo, prescritivo), pelas ferramentas que recomendo para cada um, pelas armadilhas que vejo as equipes caírem e por como de fato construir uma cultura que usa os dados em vez de só coletá-los.

Principais conclusões

Digital analytics cobre quatro trabalhos (descrever o que aconteceu, diagnosticar por quê, prever o que vem a seguir, prescrever o que fazer). A maioria das equipes para nos dois primeiros.

O maior valor de digital analytics vem quando dados quantitativos (GA4, Mixpanel, Amplitude) são combinados com sinais qualitativos (session replay, heatmaps, entrevistas com usuários). Um sozinho te dá metade da imagem.

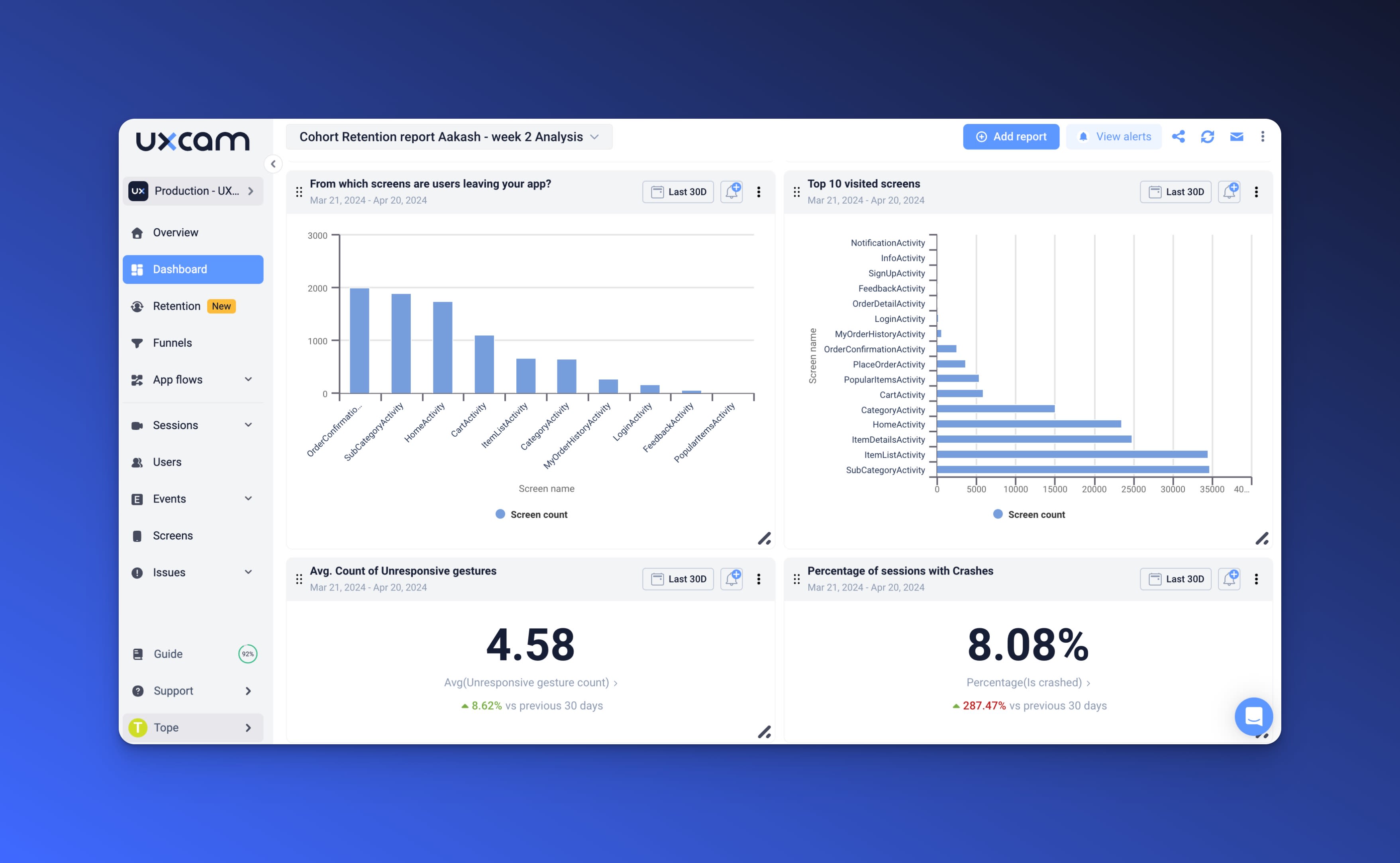

Para a maioria das equipes de produto em 2026, o stack é: GA4 para analytics de marketing, uma ferramenta de product analytics (Mixpanel, Amplitude ou UXCam) para comportamento in-app, uma ferramenta de session replay para diagnóstico comportamental e seu data warehouse para análise cruzada de fontes.

O erro mais comum que vejo: coletar dados que ninguém usa. Cada evento que você rastreia custa tempo de engenharia, custo com fornecedor e atenção do analista. Instrumente para decisões específicas, não "caso a gente precise depois".

Ferramentas de product intelligence com IA, como a Tara, automatizam boa parte da camada de diagnóstico. Em vez de vasculhar replays manualmente ou escrever consultas complexas de funil, você faz uma pergunta em linguagem natural e recebe uma lista priorizada de padrões comportamentais com evidência em sessões.

O que é digital analytics?

Digital analytics é a coleta, mensuração e análise de dados de canais digitais para melhorar resultados de negócio e de usuário. Os canais: sites, aplicativos móveis, dispositivos conectados, email, mídia paga, social, qualquer coisa com um ponto de contato digital. O objetivo: substituir achismo por decisões informadas sobre o que construir, o que mudar e onde gastar.

O escopo é mais amplo do que web analytics (que foca em sites) e mais restrito do que business intelligence (que cobre tudo, de RH a cadeia de suprimentos). Na prática, digital analytics é o que uma equipe de produto ou growth usa diariamente para responder perguntas como "qual funcionalidade gerou o aumento de retenção deste mês?" ou "por que nossa conversão de cadastro caiu no mobile na semana passada?".

Digital analytics vs product analytics vs web analytics

Esses termos são usados de forma intercambiável, e as diferenças importam.

Web analytics foca em sites: pageviews, bounce rate, duração da sessão, fontes de tráfego, eventos de conversão. A ferramenta canônica é o Google Analytics 4. O usuário típico é um profissional de marketing ou analista de SEO.

Product analytics foca no que os usuários fazem dentro de um produto, web ou mobile. Eventos, funis, coortes de retenção, adoção de funcionalidades. As ferramentas canônicas são Mixpanel, Amplitude e UXCam. O usuário típico é um product manager.

Marketing analytics foca em performance de campanha em mídia paga e CRM. As ferramentas canônicas são HubSpot, Salesforce Marketing Cloud e dashboards de BI sob medida. O usuário típico é uma pessoa de marketing ops.

Customer experience (CX) analytics foca em sinais qualitativos e quantitativos de como os usuários se sentem: pesquisas, NPS, session replay, heatmaps, análise de tickets de suporte. As ferramentas canônicas são UXCam, Hotjar e Qualtrics. O usuário típico é um pesquisador de UX ou líder de CX.

Digital analytics é o guarda-chuva que cobre todas as quatro. A maioria das organizações tem as quatro em níveis variados de maturidade.

Entendendo os quatro tipos de digital analytics

Esse é o framework no qual me apoio sempre que uma equipe pergunta "como deveria ser nosso roadmap de digital analytics?".

1. Analytics descritivo: o que aconteceu?

Descreve o que ocorreu no passado. Seus relatórios de pageview, sua contagem de usuários ativos mensais, suas taxas de conversão de funil. Essa é a camada de base. Toda ferramenta de analytics faz isso bem.

Exemplo: "Tivemos 12.000 cadastros em março, 8% a menos que em fevereiro."

2. Analytics diagnóstico: por que aconteceu?

Explica as causas por trás das métricas descritivas. É aqui que session replay e behavioral analytics mostram seu valor, porque uma queda em cadastros não te diz por quê. Assistir a 20 replays de tentativas de cadastro que deram churn normalmente diz.

Exemplo: "Os cadastros caíram porque 34% dos novos usuários iOS encontraram um timeout no prompt de permissão quando adicionamos a tela de ATT, e muitos nunca voltaram."

3. Analytics preditivo: o que vai acontecer a seguir?

Usa dados históricos para modelar prováveis resultados futuros. Modelos de previsão de churn, previsões de lifetime value, detecção de anomalias. Essa camada precisa de mais dados e mais profundidade técnica. A maioria das equipes pequenas e médias não faz isso; equipes grandes rodam seletivamente em métricas de alta alavancagem (receita, churn, LTV).

Exemplo: "A retenção do dia 30 desta coorte está 15% abaixo da mesma coorte de seis meses atrás. Com base em padrões históricos, esperamos 22% de churn no próximo trimestre, a menos que intervenhamos."

4. Analytics prescritivo: o que deveríamos fazer a respeito?

Recomenda ações específicas com base em inputs descritivos + diagnósticos + preditivos. É aqui que a product intelligence com IA vive em 2026. Em vez de assistir replays manualmente e raciocinar sobre um backlog, ferramentas como a Tara AI ingerem os dados comportamentais e propõem ações priorizadas.

Exemplo: "Suas 3 correções mais recomendadas deste mês: (1) simplificar o cadastro de 5 etapas no iOS para reduzir o abandono no prompt de ATT, (2) adicionar lógica de retry para o fluxo de pagamento que falha no Android, (3) investigar o pico de 3x na taxa de rage tap na nova tela de onboarding."

A maioria das equipes opera bem em descritivo e diagnóstico, arrisca em preditivo e mal toca em prescritivo. A lacuna é onde a Tara e ferramentas de IA parecidas estão mudando significativamente o que equipes pequenas conseguem fazer.

Como implementar digital analytics (passo a passo)

Passo 1: defina o que você está medindo e por quê

Antes de instrumentar um único evento, responda a três perguntas para cada métrica que vai rastrear:

Que decisão essa métrica vai informar?

Quem é o tomador de decisão?

Com que frequência ele vai olhar para ela?

Se você não consegue responder às três, está prestes a coletar dados que não serão usados. Já auditei implementações de analytics suficientes para afirmar com confiança que pelo menos 40% dos eventos rastreados em um app típico em produção nunca são lidos por ninguém.

Passo 2: escolha seu stack

Um stack mínimo para a maioria das equipes de produto em 2026:

A maioria das equipes investe demais no lado de marketing e de menos em produto + qualitativo. Se eu tivesse que ranquear por ROI: product analytics > session replay > marketing analytics > data warehouse, nessa ordem, para a maioria das equipes de 0 a 500 pessoas.

Passo 3: instrumente eventos sistematicamente

Use uma taxonomia. Não deixe os engenheiros nomearem eventos ad hoc. Uma convenção simples como

(, , ) escala melhor do que "ItemAddedWhenClickedOnTheAddButton".Rastreie propriedades com cada evento: plataforma (iOS, Android, web), versão, ID do usuário, coorte. Essas propriedades são o que permite segmentar depois.

Monte um tracking plan em um doc compartilhado ou ferramenta (Iteratively, Rudderstack ou um simples doc no Notion). O plano é a fonte da verdade que todo mundo consulta antes de adicionar novo rastreamento.

Passo 4: construa seus primeiros dashboards

Comece com três dashboards:

Aquisição: fontes de tráfego, taxa de cadastro, custo por aquisição

Ativação e retenção: retenção dia 1, dia 7 e dia 30, tempo até a primeira ação significativa

Receita: taxa de conversão, receita por usuário, churn

Cada dashboard deve ter no máximo 6 a 8 métricas. Mais do que isso e as pessoas param de lê-los. Cadência de revisão: olhada diária, mergulho semanal, revisão mensal de coorte.

Passo 5: sobreponha sinais qualitativos

Só os números não explicam o comportamento do usuário. Configure session replay nas suas páginas de maior intenção (checkout, cadastro, funcionalidade principal). Assista a pelo menos 10 sessões por semana. Rode detecção de rage click nos fluxos principais. Integre pesquisas em momentos de alto drop-off.

Esse é o passo que a maioria das equipes pula, e é de onde vêm os maiores insights. Já vi equipes rodarem testes A/B por semanas para ganhar significância estatística em mudanças que 20 minutos assistindo replays teriam dito para nem se incomodar.

Armadilhas comuns em digital analytics

Coletar dados que ninguém usa

Se ninguém abriu o dashboard em 30 dias, remova a métrica. Cada evento custa tempo de engenharia e dinheiro com fornecedor. Inchaço de analytics é real e caro.

Confundir correlação com causalidade

Uma métrica subindo ao mesmo tempo que outra não significa que uma causou a outra. Sem um experimento ou um forte mecanismo causal, correlações são hipóteses, não respostas. Já vi equipes atribuírem altas de receita a funcionalidades que por acaso entraram em produção na mesma semana de uma alta sazonal, o que levou a construir mais funcionalidades nesse padrão que previsivelmente falharam.

Supervalorizar métricas de vaidade

Pageviews, seguidores, cadastros. São fáceis de mover, mas não mapeiam obviamente para receita ou retenção. Um aumento de 50% em cadastros que vem inteiramente de tráfego de baixa qualidade é pior do que o mesmo aumento vindo de tráfego qualificado, porque derruba seus índices no funil todo. Sempre combine métricas de crescimento com métricas de qualidade (taxa de ativação, retenção).

Subinvestir em higiene de dados

Eventos disparando duas vezes, eventos disparando errado depois de um release, coortes definidas de forma inconsistente em dashboards. Problemas de dados se acumulam silenciosamente. Configure alertas para mudanças inesperadas na taxa de eventos e faça uma auditoria trimestral dos seus top 20 eventos para confirmar que ainda batem com suas definições.

Tratar o GA4 como a única ferramenta

O GA4 é bom para marketing analytics e rastreamento básico de conversão na web. Não é feito para product analytics (a capacidade de consulta é limitada, a identidade do usuário entre sessões é frágil, os custos de evento escalam de forma não linear). Se você depende do GA4 para perguntas de produto, vai bater na parede em algum momento. Tenha uma ferramenta de product analytics no stack desde o primeiro ano.

O papel de digital analytics nos negócios modernos

Toda decisão significativa de produto e marketing em uma empresa séria é informada por digital analytics. Isso não era verdade uma década atrás. Hoje é quase universalmente verdade.

O que mudou nos últimos dois anos: camadas de product intelligence com IA tornaram o analytics prescritivo acessível a equipes pequenas. Eu consigo perguntar para a Tara "quais são os três problemas de UX de maior impacto nos últimos 7 dias?" e receber uma lista priorizada apoiada em evidência de sessões, sem precisar de um analista dedicado para rodar a consulta. Esse tipo de workflow antes exigia um time de data science. Hoje um PM sozinho consegue fazer.

O que não mudou: o analytics só é tão bom quanto as decisões que ele gera. Uma equipe que olha dashboards diariamente, mas os ignora ao priorizar o roadmap, está pior do que uma equipe sem analytics, porque está pagando o custo sem obter o valor.

Construindo uma cultura orientada por dados

A cultura é onde a maioria dos programas de analytics falha. Você pode ter as melhores ferramentas do planeta e ainda ter uma equipe que toma decisões no feeling. Três coisas que, na minha experiência, mudam cultura de forma confiável:

Exija que toda proposta de funcionalidade inclua um critério de sucesso mensurável. Se ninguém consegue dizer como é "sucesso" em número, a funcionalidade não deveria ir para produção. Essa regra simples mudou mais culturas de equipe do que qualquer ferramenta.

Faça dos replays parte do ritual do sprint. Escolha um session replay por retrospectiva de sprint, assista em equipe, discutam o que ele revela. Isso cria contexto compartilhado sobre o que os usuários realmente vivenciam e desenvolve o músculo de combinar números com comportamento.

Publique a métrica toda semana. Seja qual for sua estrela-guia, publique semanalmente em um formato que todo mundo veja (email, Slack, quadro branco). Visibilidade cria responsabilidade.

Tendências futuras em digital analytics

Três mudanças que vale a pena acompanhar em 2026 e 2027:

Workflows de analytics nativos de IA. Ferramentas como a Tara, que permitem fazer perguntas em linguagem natural em vez de construir funis, estão mudando como equipes pequenas trabalham. A habilidade de "escrever SQL complexo para segmentar usuários" está sendo comoditizada. As habilidades que passam a importar mais: fazer boas perguntas, interpretar resultados ambíguos, desenhar experimentos que valham a pena rodar.

Mensuração privacy-first. O ATT da Apple, o Privacy Sandbox do Google e a fiscalização do GDPR tornaram o rastreamento entre sessões e entre dispositivos mais difícil. As equipes estão migrando para dados de eventos first-party e tagueamento server-side. Se seu stack de analytics ainda assume que cookies e IDFAs funcionam, você vai bater em problemas de atribuição dentro de um ano.

Fusão comportamental + quantitativa. A antiga divisão entre "ferramentas quant" (GA4, Mixpanel) e "ferramentas qual" (session replay, pesquisas) está se dissolvendo. Plataformas modernas como a UXCam agrupam as duas, com IA que correlaciona as duas automaticamente. Espero que essa consolidação continue, o que significa menos ferramentas, mas integração mais profunda por ferramenta.

Melhore seu digital analytics com o UXCam

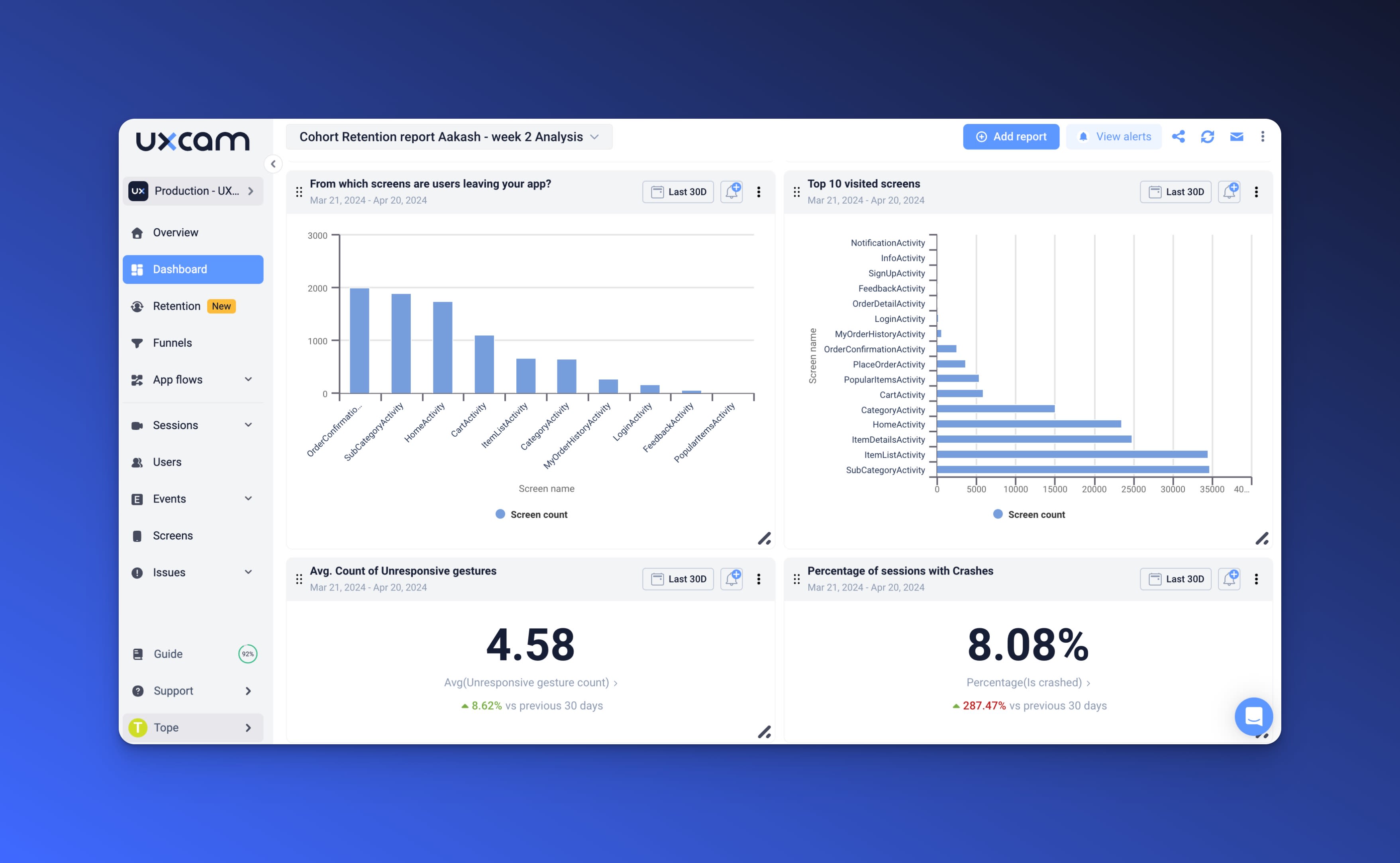

O UXCam é uma plataforma de product intelligence e product analytics que captura automaticamente cada interação do usuário em aplicativos móveis e sites, sem precisar marcar evento por evento. Ela combina analytics qualitativo (session replay, heatmaps), analytics quantitativo (funis, retenção, segmentação) e a Tara, analista de IA que processa sessões para entregar insights baseados em evidência e recomendar ações.

Para equipes de produto que precisam das quatro camadas de digital analytics (descritiva, diagnóstica, preditiva, prescritiva) em uma única plataforma, o UXCam condensa o que antes exigia três ferramentas separadas em uma só. Cada métrica é apoiada por sessões reais de usuário. Viu um drop-off? Clique para assistir às sessões em que os usuários saíram.

Mobile-first, pronto para web, instalado em mais de 37.000 produtos. Peça uma demo para ver no seu produto.

Perguntas frequentes

O que é digital analytics?

Digital analytics é a coleta, mensuração e análise de dados de canais digitais (sites, aplicativos móveis, campanhas de marketing, dispositivos conectados) para melhorar a experiência do usuário, a performance de marketing e os resultados de negócio. Abrange web analytics, product analytics, marketing analytics e customer experience analytics. O objetivo é substituir achismo por decisões mensuradas e informadas sobre o que construir, mudar e priorizar.

Qual a diferença entre digital analytics e product analytics?

Product analytics é um subconjunto de digital analytics. Product analytics foca no que os usuários fazem dentro de um produto específico (cadastros, uso de funcionalidade, retenção, churn), tipicamente usando ferramentas como Mixpanel, Amplitude ou UXCam. Digital analytics é o guarda-chuva mais amplo que inclui product analytics mais web analytics, marketing analytics e customer experience analytics.

Quais são os quatro tipos de digital analytics?

Descritivo (o que aconteceu), diagnóstico (por que aconteceu), preditivo (o que vai acontecer a seguir) e prescritivo (o que fazer a respeito). A maioria das equipes faz bem descritivo e diagnóstico, arrisca em preditivo e mal toca em prescritivo. Ferramentas de product intelligence com IA, como a Tara, estão mudando o quanto a camada prescritiva é acessível para equipes pequenas.

Que ferramentas eu preciso para digital analytics?

Um stack mínimo em 2026: GA4 para marketing analytics, uma ferramenta de product analytics (Mixpanel, Amplitude ou UXCam), uma ferramenta de session replay para diagnóstico comportamental e um data warehouse para análise cruzada de fontes quando você ultrapassar relatórios de uma única ferramenta. A maioria das equipes investe demais no lado de marketing e de menos em ferramentas de produto e qualitativas.

Como eu sei se meu digital analytics está funcionando?

Três sinais. Primeiro, sua equipe consegue responder a perguntas importantes de produto e growth a partir dos dados em menos de um dia (em vez de "deixa eu perguntar pro analista"). Segundo, toda proposta de funcionalidade inclui um critério de sucesso mensurável que é revisado após o lançamento. Terceiro, você removeu pelo menos tantas métricas dos dashboards no último trimestre quanto adicionou, porque foco importa mais do que coleta.

Qual é o maior erro que equipes cometem com digital analytics?

Coletar dados que ninguém usa. Cada evento rastreado custa tempo de engenharia e dinheiro com fornecedor. Se ninguém abriu um dashboard em 30 dias, apague a métrica. Se você não consegue dizer qual decisão uma métrica informa, não a rastreie. A maior parte do inchaço de analytics vem do "vamos rastrear isso caso a gente precise depois", e o "depois" raramente chega.

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.