Melhorar a experiência do usuário é uma daquelas frases que toda equipe de produto usa e quase nenhuma aplica de forma sistemática. Otimização da experiência do usuário é a disciplina de efetivamente fazer isso: identificar fricções específicas de UX, priorizar correções por impacto, lançar mudanças e medir se as mudanças moveram as métricas que deveriam mover. Feito direito, é o trabalho de produto com maior alavancagem que a maior parte das equipes consegue fazer. Feito mal, vira "vamos redesenhar a homepage" a cada seis meses.

Eu trabalhei com equipes de produto que aumentaram a retenção em mais de 20% por meio de otimização de UX estruturada, e com equipes que gastaram um trimestre em um redesign e não moveram nada. A diferença é sempre a mesma: as equipes que têm sucesso medem o que os usuários realmente fazem (não o que elas acham que os usuários querem), escolhem problemas específicos para resolver (não metas genéricas de "melhorar a UX") e validam que cada mudança moveu uma métrica real antes de seguir em frente. Este guia cobre o método de 10 passos que eu uso, as ferramentas que fazem ele funcionar e os padrões que vejo com mais frequência em programas de otimização bem-sucedidos.

Otimização da experiência do usuário é a prática sistemática de identificar, priorizar e corrigir problemas de experiência do usuário para melhorar métricas de produto como conversão, retenção e engajamento. Combina medição quantitativa (funis, heatmaps, análise de coorte) com investigação qualitativa (session replay, entrevistas com usuários) e termina com mudanças lançadas que são medidas contra um baseline.

Principais conclusões

Otimização de UX é orientada por medição. Se você não consegue nomear o problema específico de UX e como vai medir a correção, você não está fazendo otimização, está emitindo opiniões de design.

As vitórias de UX com maior alavancagem vêm da remoção de fricções específicas, não de redesigns. Os melhores programas de otimização que vi lançam de 10 a 20 correções pequenas e direcionadas por trimestre, em vez de um grande redesign por ano.

Session replay é a ferramenta mais útil para otimização de UX. Números dizem que uma métrica se moveu; replays mostram o que especificamente aconteceu para movê-la.

A/B testing importa para mudanças de UX em escala. Equipes pequenas muitas vezes conseguem lançar e medir sem experimentos formais. Quando sua base de usuários for grande o suficiente para dar poder estatístico (5 mil+ sessões por variante), teste antes de liberar para todos.

O que é otimização da experiência do usuário (UX)?

Otimização da experiência do usuário é a prática contínua de medir como os usuários interagem com um produto, identificar fricções ou confusões específicas e lançar mudanças direcionadas que melhorem os resultados de forma mensurável. É um ciclo contínuo, não um projeto pontual. O ciclo: medir → diagnosticar → corrigir → validar → repetir.

Ela se diferencia do design de UX da mesma forma que otimização se diferencia de criação. Design produz o produto inicial; otimização melhora ele ao longo do tempo com base em dados de uso real. A maioria das equipes de produto maduras gasta mais tempo otimizando do que desenhando novas funcionalidades.

Por que a otimização de UX importa

Conversão: cada ponto de fricção em seus fluxos críticos custa conversões. Corrigi-los tem efeito composto ao longo do tempo.

Retenção: usuários que enfrentam fricção cedo frequentemente dão churn antes de voltar. Otimizar a experiência inicial tem efeitos desproporcionais no longo prazo.

Custo de suporte: problemas de UX geram tickets de suporte. A Recora reduziu tickets em 142% depois de corrigir uma confusão específica entre pressionar e tocar que a UX causava.

Receita: para apps monetizados, mesmo pequenas melhorias de UX em paywalls ou fluxos de upgrade se traduzem diretamente em receita.

Vantagem competitiva: produtos que dão uma sensação melhor de uso vencem produtos com mais funcionalidades, mas UX pior. Toda vez.

O processo de otimização de UX em 10 passos

Defina a métrica que você está tentando mover

Audite seus funis atuais para achar os maiores drop-offs

Assista a session replays de usuários que caíram

Identifique padrões específicos de fricção (rage taps, dead clicks, erros)

Formule uma hipótese com uma magnitude prevista

Priorize por impacto esperado e esforço

Desenhe a menor correção possível

Lance com medição no lugar (A/B test se a escala permitir)

Meça por 2 a 4 semanas

Documente o que funcionou e itere

Passo 1: Defina a métrica que você está tentando mover

Otimização de UX sem uma métrica-alvo é trabalho cosmético. Escolha um número específico para mover: retenção de dia 7, taxa de conversão de checkout, conclusão de cadastro, taxa de adoção de funcionalidade. Um. Não todos.

Passo 2: Audite seus funis atuais

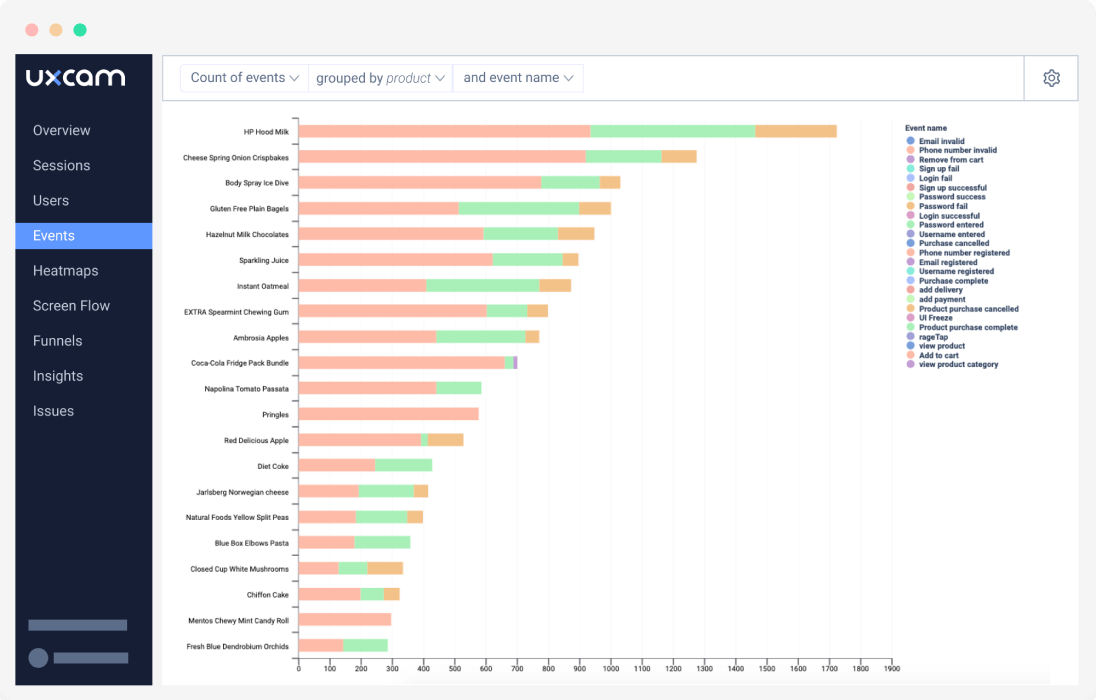

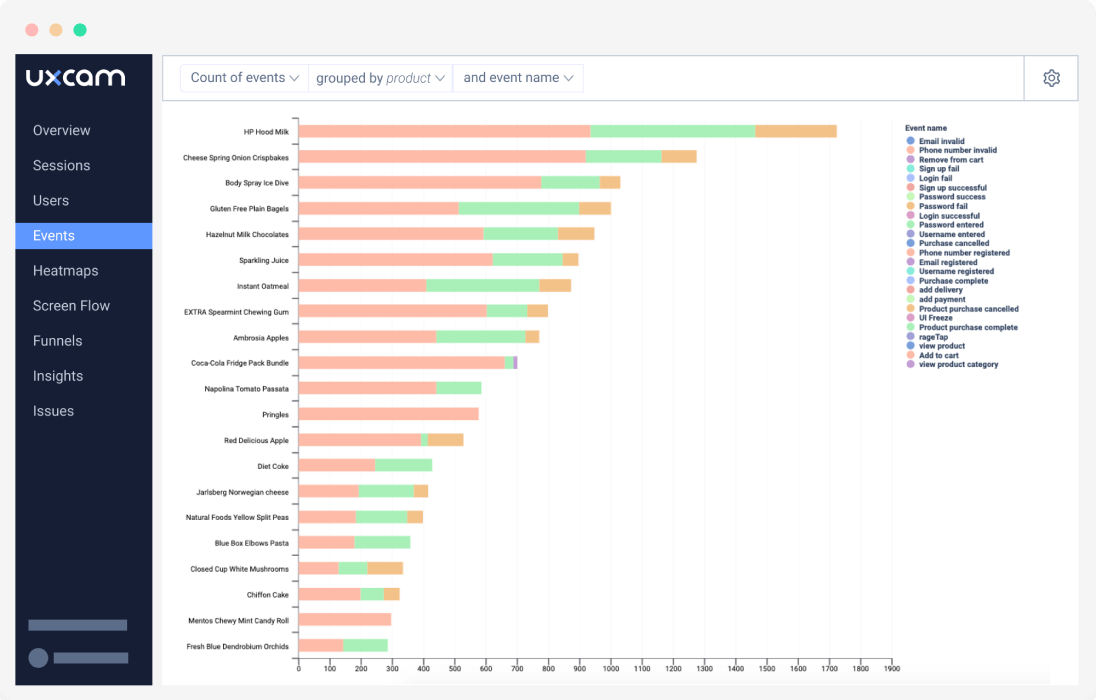

Mapeie seus fluxos de usuário críticos como passos ordenados (cadastro → primeira ação, checkout → compra). Meça o drop-off entre cada passo. O maior drop-off é seu alvo de maior prioridade. O Funnel Analytics do UXCam torna isso um fluxo de trabalho de um clique.

Passo 3: Assista a session replays de usuários que caíram

Este é o passo que a maioria das equipes pula. Filtre os replays para usuários que chegaram ao passo com vazamento e não avançaram. Assista a 10 a 20 deles. Padrões aparecem rápido: um botão que não responde, um formulário que rejeita a entrada, um modal que rouba o foco.

Passo 4: Identifique padrões específicos de fricção

Transforme os padrões que você observou em problemas com nome. "Os usuários não conseguem ver o botão enviar quando o teclado virtual abre no Android intermediário." "Os usuários tocam em 'Voltar' quando queriam 'Cancelar'." "O CTA primário está estilizado como uma ação secundária." Problemas específicos recebem correções específicas.

Passo 5: Formule uma hipótese com magnitude prevista

Uma boa hipótese nomeia a mudança, a coorte-alvo e o efeito esperado. "Se movermos o botão Enviar para cima do teclado no Android, esperamos que a conclusão do formulário nessa coorte suba de 10% a 15%, porque vimos 12% das sessões terminarem com o botão escondido."

Passo 6: Priorize por impacto esperado e esforço

Impacto (quantos usuários são afetados × quanto a métrica pode se mover) dividido por esforço (dias de engenharia para lançar). Alto impacto + baixo esforço primeiro. Não comece pelo redesign; comece pelo botão.

Passo 7: Desenhe a menor correção possível

A menor mudança que plausivelmente resolve a fricção geralmente é suficiente. Resista à tentação de redesenhar o fluxo inteiro. Vitórias incrementais têm efeito composto; grandes redesigns frequentemente regridem.

Passo 8: Lance com medição no lugar

Se sua base de usuários for grande o suficiente, faça um A/B test. Se não, lance para todos os usuários e compare antes/depois. De qualquer forma, instrumente a métrica específica que você está tentando mover para poder confirmar o resultado.

Passo 9: Meça por 2 a 4 semanas

Dê tempo para a mudança estabilizar. Uma semana é pouco (ciclos semanais afetam o comportamento). Quatro semanas geralmente são suficientes para ver um efeito real. Compare a métrica antes e depois, controlando por coortes de aquisição e efeitos sazonais onde for possível.

Passo 10: Documente o que funcionou e itere

Anote o resultado, inclusive as falhas. Equipes que documentam seus experimentos de UX acumulam conhecimento; equipes que não fazem isso reinventam as mesmas lições a cada trimestre.

Boas práticas para manter uma experiência do usuário positiva

Assista a session replays semanalmente. Mesmo quando as métricas parecem boas. Você pega regressões antes que elas se acumulem.

Rode auditorias de rage tap mensalmente. O Issue Analytics do UXCam traz esses dados automaticamente. Cada cluster de rage tap é uma pista de diagnóstico.

Teste em Androids intermediários. Os aparelhos que sua equipe não tem são os que seus usuários têm. BrowserStack, LambdaTest, ou um Samsung A-series baratinho no escritório.

Padrão: iterações pequenas e rápidas. Lance uma correção pequena essa semana, meça, lance a próxima. Isso ganha de redesigns trimestrais em toda equipe que comparei.

Trate performance como UX. Apps lentos dão sensação de quebrados. Monitore tempo de cold start, frame rate e taxa de rage tap como métricas de UX, não só de engenharia.

Mantenha um backlog de bugs de UX separado do trabalho de funcionalidades. Problemas de UX identificados em replays devem ter sua própria triagem e priorização, sem competir com tickets de novas funcionalidades.

Envolva designers em assistir replays. Designers que assistem usuários reais tomam decisões de design melhores que designers que só veem resumos de dados.

Otimização de UX para melhor performance do app

Performance é um subconjunto de UX. Um app lindamente desenhado que leva 4 segundos para fazer cold start dá sensação de quebrado. Três métricas de performance para monitorar como sinais de UX:

Tempo de cold start: mire em <2 segundos no percentil 95

Frame rate durante a rolagem: mire em >50 fps

Tempo até a primeira ação interativa: mire em <3 segundos a partir da instalação

Quando qualquer uma dessas regride, o usuário sente, mesmo que não consiga articular o que mudou. Veja o guia de como melhorar a performance de aplicativos móveis para o framework completo.

Otimize sua experiência do usuário com o UXCam

O UXCam é uma plataforma de product intelligence e product analytics que captura automaticamente toda interação do usuário em aplicativos móveis e sites, sem marcação manual de eventos. O fluxo de otimização cabe em uma ferramenta só: o Funnel Analytics encontra onde os usuários caem, o session replay mostra o porquê, o Issue Analytics sinaliza automaticamente rage taps e congelamentos de UI, e a Tara, analista de IA do UXCam, processa sessões para trazer à tona os problemas de UX de maior impacto e recomendar correções específicas.

A Inspire Fitness aumentou o tempo no app em 460% e cortou rage taps em 56%. A Housing.com fez a adoção de funcionalidades crescer de 20% para 40%. A Costa Coffee elevou os cadastros em 15%. Esse é o tipo de vitória que vem de otimização de UX estruturada, fundamentada no comportamento real do usuário.

Instalado em mais de 37.000 produtos, mobile-first, pronto para web. Peça uma demo para ver como fica no seu app.

Perguntas frequentes

O que é otimização da experiência do usuário?

Otimização da experiência do usuário é o processo sistemático de medir como os usuários interagem com um produto, identificar fricções específicas de UX, lançar correções direcionadas e validar que as mudanças moveram as métricas que deveriam mover. É um ciclo contínuo, e não um projeto pontual, e é o trabalho de produto com maior alavancagem que a maior parte das equipes consegue fazer.

Quais são as áreas-chave para focar na otimização de UX?

Os fluxos críticos onde os usuários tomam decisões que afetam seu negócio: cadastro, onboarding, checkout, ativação, upgrade e adoção de funcionalidades centrais. Comece medindo o drop-off de funil nesses fluxos e depois assista a replays de usuários que caíram para identificar pontos específicos de fricção.

Quais áreas centrais de um produto devem ser otimizadas para melhor UX?

Primeiro: a experiência da primeira sessão, que prevê retenção de longo prazo de forma mais confiável do que qualquer outra coisa. Segundo: os funis de conversão que geram receita. Terceiro: os fluxos de funcionalidades centrais para os quais os usuários voltam. Quarto: tratamento de erros (muitas vezes o maior custo oculto de UX). Quinto: performance, porque apps lentos dão sensação de quebrados, mesmo quando não estão.

Quais ferramentas e técnicas ajudam na otimização de UX?

Session replay (UXCam, Hotjar, FullStory) para ver o que os usuários realmente vivenciam. Funnel analytics (UXCam, Mixpanel, Amplitude) para achar pontos de drop-off. Heatmaps para análise de padrões de toque e rolagem. Plataformas de A/B testing (Statsig, Optimizely, Firebase) para validar mudanças. Ferramentas de diagnóstico com IA como Tara AI automatizam boa parte do trabalho de fazer emergir padrões comportamentais.

Como medir o sucesso da otimização de UX?

Acompanhe a métrica específica que você se propôs a mover. Sinais adicionais: taxa de rage tap (tendência de queda é bom), taxa de conclusão de tarefa por tela, tempo até a primeira ação significativa e retenção de dia 7. Comparação antes/depois em uma janela de 2 a 4 semanas é o mínimo. A/B testing é melhor quando você tem o tráfego necessário.

Quanto tempo leva a otimização de UX?

Cada otimização específica leva de 1 a 4 semanas do diagnóstico ao resultado validado. O programa de otimização em si é contínuo. Equipes que rodam de 10 a 20 otimizações por trimestre acumulam melhorias mensuráveis. Equipes que rodam um grande redesign por ano frequentemente regridem.

Qual a diferença entre design de UX e otimização de UX?

Design de UX cria a experiência inicial do produto. Otimização de UX a melhora ao longo do tempo com base em dados de uso real. Design é mais inicial e criativo; otimização é mais contínua e orientada por medição. Equipes maduras fazem os dois, mas gastam a maior parte do tempo pós-lançamento em otimização.

Com que frequência devo assistir a session replays?

Semanalmente no mínimo. Terça é um bom padrão (dados suficientes acumulados da semana anterior, cedo o bastante na semana atual para lançar correções). Assista a 10 a 15 replays filtrados por um critério específico (usuários que deram churn nessa semana, usuários que não concluíram o funil de cadastro, usuários que deram rage tap). O hábito importa mais do que a cadência específica.

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

Artigos relacionados

UX design

User Stories vs Use Cases: Definições, Templates e Como Escolher Entre Elas

User stories vs use cases, definições, quando usar cada formato, templates, exemplos lado a lado e como a análise de sessões com IA fundamenta os dois...

Silvanus Alt, PhD

Founder & CEO | UXCam

UX design

Exemplos de Dashboard de Customer Experience e as Métricas Que Realmente Importam

Um dashboard de customer experience transforma sinais dispersos em uma única visão. Veja exemplos, as métricas que importam e como construir um que gere...

Silvanus Alt, PhD

Founder & CEO | UXCam

UX design

Otimização da Experiência do Usuário: 10 Passos para Melhorar a UX em 2026

Otimização da experiência do usuário é o processo iterativo de remover fricção, melhorar a clareza e elevar os sinais de conversão e retenção de um...

Silvanus Alt, PhD

Founder & CEO | UXCam