Revisamos as 19 Melhores UX Tools para 2026

ÍNDICE

- Principais conclusões

- Como avaliamos essas UX tools

- Visão geral: as 19 melhores UX tools para 2026

- Melhores UX tools para pesquisa de usuário

- Melhores UX design tools para wireframing e prototipagem

- Melhores softwares de UX para fluxogramas e user flow

- Melhores ferramentas de UX para colaboração e handoff de design

- 13 padrões e armadilhas que separam um stack de UX funcional de uma coleção de shelfware

- Considerações específicas por indústria

- UX tools por categoria

- 10 erros comuns que vejo quando times montam um stack de UX

- Um modelo de maturidade para ferramentas de UX

Passei a última década vendo times de UX queimarem orçamento em stacks de ferramentas que parecem ótimas em uma demo e se desfazem em uma sprint. As UX tools que realmente fazem diferença compartilham algumas características: encaixam em um fluxo de trabalho real, produzem evidências nas quais o resto da organização confia e fecham o ciclo entre a intenção de design e o que os usuários realmente fazem.

Esta é a lista que eu entregaria a um líder de product design montando um stack para 2026 do zero. Dezenove ferramentas cobrindo pesquisa, wireframing, prototipagem, fluxogramas e handoff, com os trade-offs que vejo os times enfrentarem na prática.

Principais conclusões

Um stack de UX moderno precisa de quatro camadas funcionando juntas: pesquisa comportamental, wireframing, prototipagem e handoff. Pule uma e você acaba relitigando decisões lá na frente. A camada em que a maioria dos times ainda investe pouco é analytics comportamental cobrindo tanto mobile quanto web. O UXCam está instalado em mais de 37.000 produtos e é a única ferramenta desta lista que te diz o que os usuários realmente fizeram depois do lançamento, em vez do que testadores disseram que talvez fizessem.

O Figma praticamente consolidou wireframing, prototipagem e handoff para a maioria dos times. Ferramentas especializadas ainda vencem em casos específicos: Axure para interações complexas, Balsamiq para velocidade em baixa fidelidade e Sketch para equipes macOS com lock-in de ecossistema já estabelecido. E feedback autodeclarado vindo de painéis de teste sempre vai discordar do comportamento dentro do produto. Rode os dois e, quando conflitarem, confie na sessão.

A categoria de UX tool mais subutilizada é issue analytics. Rage taps, congelamentos de UI e crashes atrelados a replays são onde a fricção real está, e é a categoria em que a Recora reduziu tickets de suporte em 142% depois de identificar uma confusão entre pressionar-e-segurar que nenhum teste de painel tinha pegado.

Como avaliamos essas UX tools

Pesei quatro critérios, nesta ordem. Utilidade valeu 40%: a ferramenta resolve um problema concreto do fluxo de UX ou é um "bom de ter" que é abandonado até a terceira sprint. Usabilidade valeu 25%, medida como tempo até o primeiro valor para um designer que nunca abriu a ferramenta; qualquer coisa que precise de uma semana de onboarding perde pontos. Colaboração valeu 20%, porque multiplayer em tempo real é o básico hoje e exportar PDFs para stakeholders não é um fluxo de trabalho. Os 15% finais foram para integração e ciclo de evidência: a ferramenta conecta ao resto do stack (Figma, Jira, Slack) e, crucialmente, permite validar decisões contra comportamento real do usuário?

Preços e notas do G2 estão incluídos para contexto, mas não foram pontuados. Toda ferramenta listada foi usada por um time com o qual trabalhei ou que entrevistei.

Visão geral: as 19 melhores UX tools para 2026

Para pesquisa de usuário vou cobrir UXCam, UserTesting, Applause, Lyssna, Hotjar e Survicate. Para wireframing e prototipagem: Balsamiq, Adobe XD, Figma, Sketch e Axure RP. Para fluxogramas e user flow: Overflow, FlowMapp, Lucidchart, Gliffy e UXCam Screen Flow. Para colaboração e handoff: FigJam, Zeplin e Miro.

Melhores UX tools para pesquisa de usuário

As ferramentas de pesquisa se dividem em dois campos. Painéis moderados significam recrutar pessoas e observá-las tentando fazer coisas. Analytics comportamental significa observar todo mundo que de fato usa o produto. Times sérios rodam os dois, porque painéis contam o que as pessoas dizem e analytics conta o que elas fazem. O Nielsen Norman Group tem uma boa taxonomia se você quiser mapear sua cobertura atual contra cada método disponível.

1. UXCam

O UXCam é uma plataforma de product intelligence e product analytics usada por mais de 37.000 produtos. Cobre tanto apps móveis quanto web com a mesma profundidade, o que importa porque a maioria das ferramentas de "UX analytics" ainda trata um dos dois como cidadão de segunda classe.

A razão pela qual o UXCam fica no topo da minha lista de pesquisa é que ele entrega ao designer de UX coisas que as outras ferramentas desta lista não conseguem. O Session replay permite que você assista usuários reais navegando pelo seu produto em vez de um testador pago fingindo ser um, o que significa ver as hesitações, a raiva do botão voltar e os erros de dedo gordo que um script de usabilidade nunca vai trazer à tona. Os Heatmaps mostram atividade de toque, rolagem e gestos que não respondem, revelando onde usuários tocam em coisas que não são botões, que é a falha mais comum de mobile UX que eu vejo. O Issue analytics traz automaticamente à tona rage taps, congelamentos de UI e crashes, e os vincula ao replay exato; foi assim que a Recora reduziu tickets de suporte em 142% depois de perceber que usuários estavam tentando pressionar-e-segurar um controle que só aceitava toques. E a Tara AI processa sessões em escala e te diz o que está quebrado, quem está sendo afetado e o que fazer em seguida. Esse fluxo antes era "designa um designer para assistir 40 replays na sexta à tarde".

Os números dos clientes dão uma ideia do teto. A Inspire Fitness usou o UXCam para aumentar o tempo no app em 460% e cortar rage taps em 56%. A Housing.com fez a adoção de funcionalidades crescer de 20% para 40%. A Costa Coffee aumentou cadastros em 15%. Esses são resultados que você não vai obter de um painel de teste moderado.

Vale saber: UXCam não é onde você roda entrevistas. É onde você descobre quais perguntas de entrevista deveria ter feito. Combine com uma ferramenta de painel como UserTesting ou Lyssna. Roda como dashboard web com SDKs para iOS, Android, React Native, Flutter e web. O plano gratuito inclui 10.000 sessões mensais, com planos pagos sob consulta. G2 avalia 4,7/5 e Capterra 4,6/5.

2. UserTesting

O UserTesting é a escolha padrão quando você precisa recrutar pessoas reais para passar por um protótipo ou um fluxo ao vivo e narrar seu processo de pensamento. O painel é grande, a segmentação demográfica é sólida e o output em vídeo é fácil de cortar e compartilhar. Testes remotos não moderados rodam durante a noite, então você acorda com cinco vídeos narrados e uma lista de pontos óbvios de fricção.

O outro lado é que tem preço enterprise com uma curva de aprendizado no design de teste, e os testadores sabem que estão sendo gravados, então alguns comportamentos ficam artificiais. Preço sob consulta. G2 avalia 4,5/5 e Capterra 4,5/5.

3. Applause

O Applause é uma plataforma premium de testes de usabilidade e QA que combina uma comunidade global de testadores com aparelhos reais e um especialista dedicado para ajudar a desenhar estudos. É o ajuste certo para testes de jornada cross-device em que você precisa atingir regiões específicas, versões de SO ou combinações de operadora, e o suporte prático o torna sólido para produtos regulados ou globais.

Onde ele tropeça é em cadência diária e iterativa. Restrições de agenda e disponibilidade do pool de testadores fazem com que não seja a escolha certa se você quer rodar algo rápido amanhã de manhã. Preço sob consulta, e G2 avalia 4,4/5.

4. Lyssna (antiga UsabilityHub)

O Lyssna é a ferramenta que eu recomendo para times pequenos que precisam de feedback direcional rápido e barato. Cobre testes de primeiro clique, testes de cinco segundos, testes de preferência e card sorts, e tem um painel de mais de 530.000 pessoas embutido para quando você precisa de recrutas. A UI é limpa e a variedade de tipos de teste é ampla, o que o torna um bom generalista para trabalho em estágio inicial.

O salto do gratuito para o plano Basic de US$ 75/mês é íngreme, e as taxas de recrutamento de painel somam rápido se você precisa de um público de nicho. G2 avalia 4,5/5 e Capterra 4,7/5.

5. Hotjar

O Hotjar é uma ferramenta de analytics focada em web que cobre heatmaps, gravações de sessão, pesquisas on-site e analytics de funil para sites e web apps responsivos. É fácil de configurar, funciona bem para sites de marketing e e-commerce, e se conecta a uma ampla biblioteca de integrações.

O detalhe é que ele não foi feito para apps móveis, e a amostragem de sessão nos tiers mais baixos faz com que você perca casos extremos. Clientes também citam regularmente sobrecarga de dados sem camada de priorização em cima. Preço a partir de US$ 32/mês. G2 avalia 4,3/5 e Capterra 4,7/5. Para um olhar mais profundo em alternativas, veja nossa análise de alternativas ao Hotjar.

6. Survicate

O Survicate roda pesquisas contextuais dentro do produto, em sites e em apps móveis. Dá para disparar pesquisas em eventos específicos, o que é muito mais útil do que um popup genérico de NPS. A segmentação é boa, a customização é flexível e suporta múltiplos idiomas de cara.

O preço começa em US$ 119/mês, o que é alto se você só envia algumas pesquisas por mês. Teste gratuito disponível. G2 avalia 4,6/5 e Capterra 4,5/5.

Melhores UX design tools para wireframing e prototipagem

Uma definição rápida, porque isso ainda confunde PMs novos. Wireframes são esboços estruturais de baixa fidelidade, em que o objetivo é discutir layout em vez de cor de botão. Protótipos são representações clicáveis, de alta fidelidade, do produto final, que você pode testar com usuários.

7. Balsamiq

O Balsamiq se compromete fortemente com a baixa fidelidade. A estética deliberadamente desenhada à mão mantém os stakeholders discutindo estrutura em vez de raio de borda de botão, que é exatamente a discussão que você quer na fase de wireframe. É rápido, focado e quase impossível de acidentalmente sobrepolir. No momento em que você precisa de fidelidade visual real, já passou do ponto. Preço a partir de US$ 9/mês. G2 avalia 4,2/5 e Capterra 4,4/5.

8. Adobe XD

O Adobe XD ainda tem usuários fiéis, particularmente em empresas já no Creative Cloud. Lida bem com design baseado em componentes e transições animadas, e a integração com o ecossistema Adobe é genuinamente profunda se você precisa trabalhar com assets de Photoshop e Illustrator.

A desvantagem honesta é que colaboração multi-editor em tempo real nunca foi seu ponto forte, e a Adobe claramente despriorizou o produto. A cadência de releases mostra isso. Preço a partir de US$ 9,99/mês. G2 avalia 4,3/5 e Capterra 4,6/5.

9. Figma

O Figma é o padrão. Se você está montando um stack de time novo em 2026, a pergunta não é se deve usar Figma, é se você precisa de qualquer outra coisa nesta categoria.

Edição multiplayer ao vivo, um design system que realmente escala e prototipagem que cobre 90% do que a maioria dos times precisa é uma combinação difícil de rebater. Componentes interativos, lógica condicional e overlays em camadas te dão simulações próximas do real sem pular para outra ferramenta, e o handoff para dev é forte o suficiente para que a maioria dos times não precise mais de um produto de handoff separado. Os trade-offs são modestos: prototipagem avançada tem curva de aprendizado, e arquivos muito grandes podem travar. Preço a partir de US$ 12 por editor/mês. G2 avalia 4,6/5 e Capterra 4,7/5.

10. Sketch

O Sketch foi pioneiro no espaço de design baseado em vetor e ainda tem uma sensação limpa e opinativa que designers macOS juram por. O ecossistema de plugins é maduro, a performance nativa é rápida e os templates da comunidade são fortes.

O que o elimina como padrão de time é que é só macOS, o que o descarta em qualquer organização cross-OS, e a colaboração em tempo real ainda fica atrás do Figma. Preço a partir de US$ 99/ano. G2 avalia 4,5/5 e Capterra 4,7/5.

11. Axure RP

O Axure RP é a ferramenta à qual times enterprise de UX recorrem quando precisam de protótipos que se comportam como software em vez de slideshows. Lógica condicional, campos de formulário funcionais e interações baseadas em dados estão dentro da ferramenta, e o output serve também como documentação séria de UX ao lado do próprio protótipo.

O preço desse poder é uma curva de aprendizado íngreme, e para a maioria dos times de produto de consumo é exagero. Preço a partir de US$ 25 por usuário/mês. G2 avalia 4,2/5 e Capterra 4,4/5.

Melhores softwares de UX para fluxogramas e user flow

User flows são a ponte entre pesquisa e design. Se você não consegue mapear o fluxo atual, não consegue defender uma mudança nele. Essas ferramentas existem porque tentar manter fluxos em arquivos do Figma fica rapidamente inviável.

12. Overflow

O Overflow importa artboards do Sketch, Figma e XD, embrulha em skins de aparelho e permite conectar e anotar fluxos. O modo de apresentação auto-guiada o torna genuinamente útil para revisão assíncrona com stakeholders, e o compartilhamento protegido por passphrase é um toque legal quando você está mandando fluxos iniciais para fora do time.

Problemas ocasionais com formato de exportação aparecem, e a base de usuários é pequena comparada com ferramentas de fluxo nativas do Figma, então a comunidade de plugins e templates é mais fina. Preço a partir de US$ 15 por usuário/mês. G2 avalia 4,2/5.

13. FlowMapp

O FlowMapp cobre user flows, sitemaps e mapas de jornada do cliente em uma visualização em estilo wireframe de baixa fidelidade. É acessível, os templates específicos de UX poupam tempo em planejamento de estágio inicial, e colabora razoavelmente bem. Onde ele fica sem espaço é em diagramas complexos, e a biblioteca de formas é mais estreita que a do Lucidchart. Preço a partir de US$ 15/mês. G2 avalia 4,7/5 e Capterra 4,7/5.

14. Lucidchart

O Lucidchart é a ferramenta de diagramação adulta. Não é específica de UX, mas cobre fluxos, raias, ERDs e diagramas de sistema com colaboração em tempo real, e as integrações com Slack, Atlassian e Google Workspace são genuinamente fortes. Pode parecer pesado para um time pequeno de UX, e diagramas complexos ocasionalmente desformatam, mas a biblioteca de templates compensa bastante. Preço a partir de US$ 7,95/mês. G2 avalia 4,5/5 e Capterra 4,5/5.

15. Gliffy

O Gliffy é diagramação leve com uma história forte na Atlassian. Se seu time vive no Jira e Confluence, diagramas do Gliffy incorporam nativamente e ficam em sincronia, o que é uma vitória real de produtividade. É baseado em navegador com um app Chrome para edição offline. A biblioteca de formas é menor que a do Lucidchart e os recursos avançados são mais fracos, então serve a times cujos diagramas são fundamentalmente simples, mas precisam viver ao lado dos tickets. Preço a partir de US$ 8 por usuário/mês. G2 avalia 4,4/5 e Capterra 4,3/5.

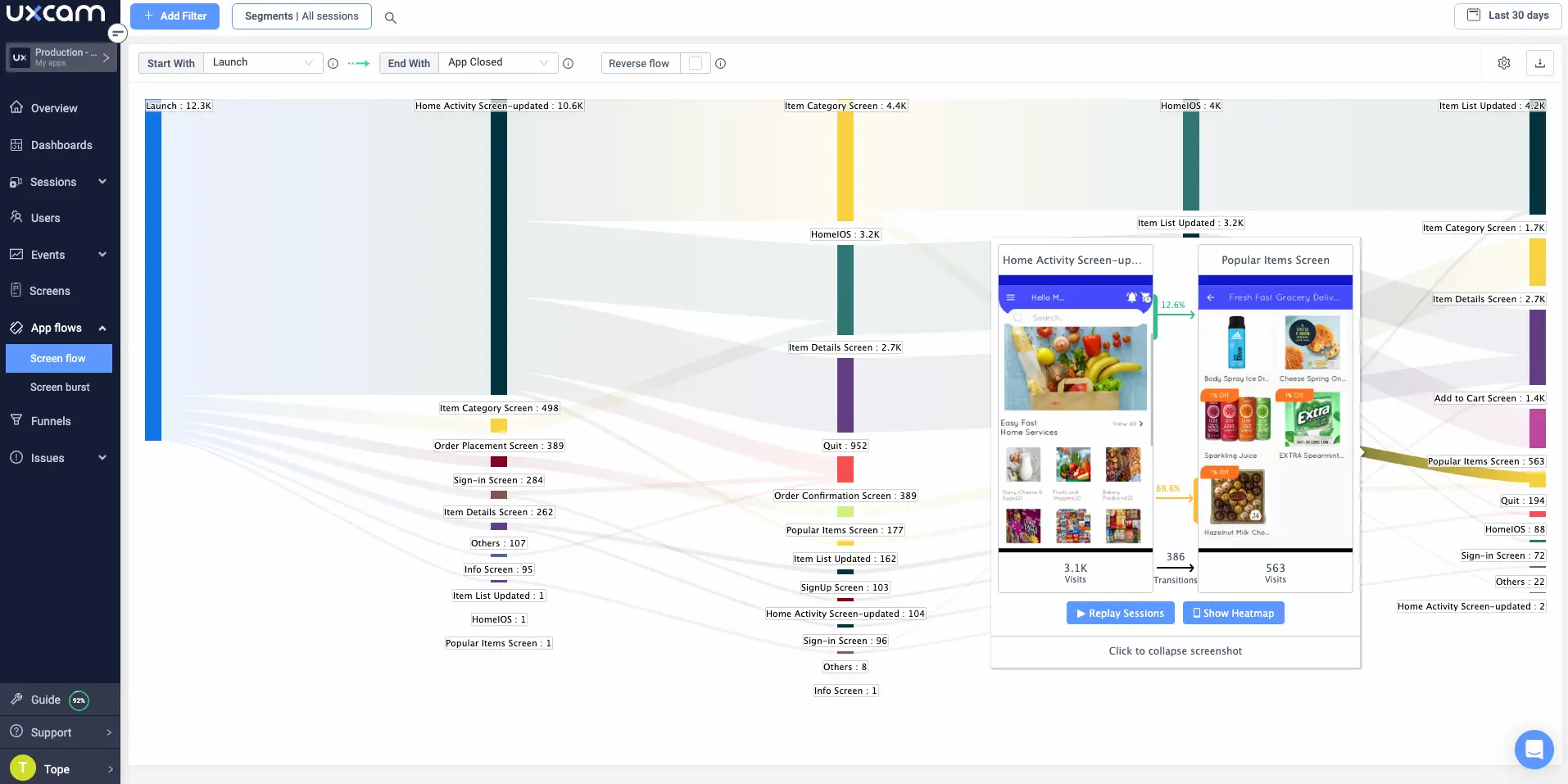

16. UXCam Screen Flow

Esta é a única ferramenta de fluxo da lista que não te pede para desenhar nada. O UXCam Screen Flow gera o user flow real a partir de dados de sessão reais. Você consegue comparar o fluxo que projetou com o fluxo que os usuários estão executando, e o gap entre esses dois normalmente é onde o roadmap vive.

Combine o Screen Flow com session replay e você pode clicar em qualquer nó do fluxo direto para um replay de alguém percorrendo aquele caminho. Essa é a parte de um fluxo de UX que antes era um palpite. O trade-off é que requer a instalação do SDK do UXCam, então não é uma ferramenta descartável para um projeto de sprint único. O plano gratuito inclui 10.000 sessões mensais, com planos pagos sob consulta. G2 avalia 4,7/5 e Capterra 4,6/5.

Melhores ferramentas de UX para colaboração e handoff de design

17. FigJam

O FigJam é o whiteboard do Figma, afinado para sprints de design, mapas de jornada, diagramas de afinidade e widgets de votação. Se seu time já está no Figma, o FigJam é o caminho de menor resistência para sessões de ideação, com handoff fluido para o Figma propriamente dito, multiplayer com acesso de convidado de 24 horas e uma sensação genuinamente divertida. As lacunas são falta de edição offline e histórico de versão mais leve que o do Miro. Preço a partir de US$ 3 por editor/mês. G2 avalia 4,5/5 e Capterra 4,8/5.

18. Zeplin

O Zeplin é feito para handoff limpo entre design e dev: specs, medidas, color tokens, exports de assets e snippets de código para iOS, Android e web. A experiência de handoff para desenvolvedor é genuinamente excelente, o suporte a design system é sólido, e as integrações com Jira e Slack são fortes.

A ressalva honesta é que o Dev Mode embutido do Figma comeu boa parte da razão de ser do Zeplin. Ainda vale a pena se você está no Sketch ou XD, ou se seu time de engenharia especificamente prefere o formato do Zeplin. Gratuito para um projeto, pago a partir de US$ 19/mês. G2 avalia 4,4/5 e Capterra 4,4/5.

19. Miro

O Miro é o whiteboard infinito no qual a maioria dos times multifuncionais acaba se fixando. Mapas de empatia, mapas de jornada, roadmapping, sprint planning e workshops se encaixam confortavelmente. A biblioteca de templates é enorme, funciona em web, desktop e mobile, e se integra com a maior parte do seu stack. Boards massivos podem travar, e não é uma ferramenta de handoff, então combine com Figma ou Zeplin lá na frente. Gratuito para três boards, pago a partir de US$ 8 por usuário/mês. G2 avalia 4,7/5 e Capterra 4,7/5.

13 padrões e armadilhas que separam um stack de UX funcional de uma coleção de shelfware

Escolher boas ferramentas é a parte fácil. Fazer um time usá-las consistentemente e alimentar os outputs em decisões reais é onde a maioria dos stacks morre silenciosamente. Estes são os padrões que eu vejo funcionando e as armadilhas que continuam pegando os times.

1. Comece pela lacuna de evidência, não pela ferramenta de design

A maioria dos times começa uma auditoria de ferramentas debatendo Figma versus Sketch. Essa é a primeira pergunta errada. Comece perguntando quais decisões você não conseguiu defender no último trimestre. Se a resposta é "não sabemos se o novo onboarding moveu a ativação de verdade", a lacuna é analytics comportamental, não software de design. A Reforge tem uma visão útil sobre decisões de produto baseadas em evidência que se aplica diretamente aqui.

2. Uma ferramenta por trabalho, não uma ferramenta por funcionalidade

Cada categoria desta lista tem três ou quatro opções sobrepostas. Escolha uma por categoria e force-a a ganhar sua renovação. Rodar Hotjar e UXCam juntos, ou Miro e FigJam juntos, é quase sempre sinal de dois times comprando a mesma coisa sem conversar.

3. Taxa de amostragem importa mais que contagem de funcionalidades

Tiers baratos de gravação de sessão costumam amostrar de 10% a 25% do tráfego. Isso soa bem até um PM pedir "me mostra os usuários que bateram no crash do iOS 17", e o replay não estar lá. O UXCam captura 100% das sessões nos tiers pagos, o que é a diferença entre uma ferramenta de debug e um exercício de estatística.

4. Teste de protótipo sempre vai discordar do comportamento em produção

Testadores de painel estão em "modo teste". Usuários reais estão distraídos, em redes instáveis, usando um aparelho surrado com 2% de bateria. O Baymard Institute tem anos de evidência de que o comportamento em produção consistentemente revela fricção que testes moderados não captam. Trate testes de protótipo como direcionais, sessões em produção como verdade.

5. Assista a cinco replays antes de abrir um arquivo de design

Eu peço a todo designer dos meus times que faça isso antes de começar qualquer funcionalidade: assistir cinco session replays de usuários fazendo o fluxo adjacente. Leva 15 minutos e mata pelo menos uma suposição ruim por sprint.

6. Atrele toda pesquisa a um evento

Pesquisas genéricas de "Quão satisfeito você está?" produzem ruído. Pesquisas disparadas por um evento específico, como "você acabou de abandonar o checkout" ou "você acabou de usar o novo filtro três vezes", produzem decisões. Survicate e UXCam suportam segmentação acionada por evento.

7. Não deixe o handoff virar o gargalo

O handoff entre design e dev é onde 20% de uma sprint pode sumir se a cadeia de ferramentas está errada. O Dev Mode do Figma cobre a maioria dos times hoje. Se você ainda está exportando links estáticos do Zeplin e colando em tickets do Jira, seu stack está te custando dias por release.

8. Quantifique sinais de frustração, não apenas conte eventos

Ferramentas tradicionais de analytics contam toques. O Issue analytics conta toques frustrados: rage taps, navegação para trás repetida, congelamentos de UI. Esse é o sinal que a Recora usou para encontrar a confusão de pressionar-e-segurar que cortou seus tickets em 142%.

9. Faça da Tara AI ou equivalente uma revisão semanal ritual

O modelo antigo de "designer assiste 40 replays na sexta" não escala. A Tara AI processa sessões em escala e traz à tona o que mudou e por quê. Coloque um slot semanal de 30 minutos no calendário para revisar suas descobertas com PM e engenharia.

10. Construa um repositório de pesquisa, não uma pasta de PDFs

Vídeos órfãos de Lookback ou UserTesting são efetivamente lixo em seis semanas. Marque descobertas por funcionalidade, persona e fluxo em um único sistema pesquisável. O Dovetail e o Condens fazem isso bem.

11. Projete para o aparelho P95, não para seu MacBook

Designers mobile consistentemente testam em iPhones topo de linha. Usuários reais estão em Androids intermediários com 3GB de RAM. O emulador de perfil de aparelho do Android Studio e a segmentação por aparelho do UXCam vão mostrar como a outra metade entrega.

12. Mate ferramentas que não alimentam o próximo estágio

Se uma ferramenta produz um output que não informa diretamente o próximo estágio do fluxo de trabalho, é desperdício. Uma sessão de whiteboard que termina em uma foto do whiteboard falhou. Um relatório de pesquisa que termina como anexo em PDF falhou. Todo estágio deve entregar um artefato vivo, linkável e pesquisável.

13. Orce rituais de ferramentas, não só licenças

Uma ferramenta sem um ritual é shelfware. Coloque revisão de replay na pauta do kickoff da sprint. Coloque leituras de heatmap em todo post-mortem de funcionalidade. Coloque resultados de pesquisa no standup de segunda. A licença é barata; o convite de calendário ausente é o que mata a adoção.

Considerações específicas por indústria

O mesmo stack não serve para todo vertical. Aqui está como penso nos ajustes por indústria.

Fintech e bancos

Compliance e privacidade na gravação de sessão são as primeiras perguntas. Você precisa de uma ferramenta que mascare PII por padrão, suporte mascaramento no aparelho e te dê uma trilha de auditoria limpa. O mascaramento automático de dados sensíveis e a postura SOC 2 do UXCam importam mais aqui do que na maioria dos verticais. Espere escrutínio maior também em fluxos de consentimento de pesquisa moderada. A orientação da FINRA sobre teste de experiência digital vale a leitura antes de escolher uma ferramenta de painel.

Healthcare e healthtech

A HIPAA e regras equivalentes da UE restringem a lista de ferramentas nitidamente. Analytics comportamental tem que ser configurável para excluir PHI na camada de SDK, não depois do fato. Teste de protótipo com pacientes reais requer processo próximo de IRB. A maioria dos times que vi nesse espaço roda UXCam ou similar com mascaramento agressivo, mais um parceiro especialista em pesquisa em vez de um painel aberto.

E-commerce e varejo

A pergunta dominante é fricção de funil, especialmente em web mobile e apps. Heatmaps, mapas de rolagem e analytics de funil importam mais do que sofisticação de prototipagem. O aumento de 15% em cadastros da Costa Coffee veio exatamente desse tipo de trabalho de funil. Os benchmarks de usabilidade de checkout do Baymard Institute são o banco de dados de referência para esse vertical.

Produtos SaaS e B2B

Ativação e adoção de funcionalidades são as métricas de dinheiro. A Housing.com fez a adoção de funcionalidades crescer de 20% para 40% usando UXCam para encontrar os pontos de abandono no fluxo de novo usuário. Acrescente ao stack uma ferramenta forte de pesquisa in-product para feedback de ativação, e uma ferramenta de mapeamento de fluxo que consiga segmentar por tier de plano.

Mídia, streaming e games

Duração de sessão, engajamento e dados de rage-tap importam mais. A Inspire Fitness aumentou o tempo no app em 460% e cortou rage taps em 56%, que é exatamente o padrão que vejo repetidamente em produtos orientados a engajamento. Prototipagem importa menos aqui do que analytics de comportamento em produção, porque o "feel" do produto é impossível de testar com precisão em um protótipo.

Viagem, mobilidade e on-demand

Esses apps vivem ou morrem pela confiabilidade cross-device, cross-network, cross-region. A diversidade de aparelhos do Applause importa aqui de um jeito que não importa para um produto puro de SaaS. Combine com UXCam para detecção de anomalias em produção, porque os casos extremos nesse espaço (sinal fraco, drift de GPS, kill de app em background) são onde os usuários de fato dão churn.

UX tools por categoria

Uma referência rápida se você está montando uma lista curta.

Analytics comportamental e session replay: UXCam, Hotjar, FullStory, LogRocket.

Teste de usuário moderado e não moderado: UserTesting, Lyssna, Applause, Maze, UserZoom.

Pesquisas e feedback in-product: Survicate, Sprig, Qualaroo.

Wireframing e design: Figma, Sketch, Balsamiq, Adobe XD, Penpot.

Prototipagem avançada: Axure RP, ProtoPie, Framer.

Mapeamento de fluxo e diagramação: Lucidchart, FlowMapp, Overflow, Gliffy, Whimsical, UXCam Screen Flow.

Whiteboarding e workshops: Miro, FigJam, Mural.

Handoff entre design e dev: Figma Dev Mode, Zeplin, Avocode.

Repositórios de pesquisa: Dovetail, Condens, EnjoyHQ.

Testes de acessibilidade: axe DevTools, Stark, WAVE.

10 erros comuns que vejo quando times montam um stack de UX

Comprar Figma e dar o stack por encerrado

Figma é necessário, mas não suficiente. Sem uma camada de pesquisa e uma camada de analytics comportamental, você está entregando palpites educados. Adicione pelo menos uma ferramenta de painel e uma ferramenta de analytics de produção.

Tratar session replay como ferramenta só de debugging

Engenharia recorre ao replay quando entra um relato de bug. Tudo bem, mas designers e PMs deveriam estar na ferramenta de replay mais vezes que engenharia. A mudança cultural é a vitória.

Confundir analytics de evento com UX analytics

Mixpanel e Amplitude te dizem o que os usuários clicaram. Não te dizem por que os usuários hesitaram por 12 segundos antes de clicar. Você precisa tanto de dado de evento quanto de contexto de sessão para tomar uma decisão real.

Rodar pesquisas sem um plano de tamanho de amostra

Três respondentes de NPS não são um sinal. Decida o N mínimo por segmento antes de lançar a pesquisa, e não tome decisões abaixo desse limite.

Deixar a dispersão de ferramentas esconder a ownership

Se ninguém consegue dizer qual PM é dono da conta do UserTesting, ninguém está conduzindo a conta do UserTesting. Atribua um DRI para cada ferramenta, e coloque uma revisão trimestral de utilização nos OKRs dele.

Pular a auditoria de acessibilidade

Designers e engenheiros assumem que "o outro time" cuida de acessibilidade. Construa isso na cadeia de ferramentas: Stark no Figma, axe DevTools no navegador, passagens manuais de leitor de tela em fluxos críticos. As diretrizes WCAG 2.2 são a linha de base, não uma meta esticada.

Projetar em desktop para uma base de usuários majoritariamente mobile

Ainda vejo times projetando telas de 1440px para produtos em que 70% do tráfego é mobile. Defina o frame padrão do Figma para o aparelho P50 real da sua analytics, e force toda revisão a acontecer em um celular real.

Investir demais em prototipagem, investir de menos em monitoramento de produção

Um protótipo que testa lindamente e um fluxo de produção com 30% de abandono são um par muito comum. Você encontrou os problemas que um testador conseguia trazer à tona. Não encontrou os que só aparecem em escala, em aparelhos reais, em redes reais.

Ignorar o custo de troca

A ferramenta mais barata no ano um pode ser a mais cara ao longo de três anos se você superar ela. Orce para o stack de que vai precisar em 3x a escala atual, não 1x.

Não fechar o ciclo de volta para pesquisa

Enviar para produção não é o fim do ciclo. Uma funcionalidade que vai ao ar é uma hipótese para testar. Se você não tem um ritual para revisar comportamento 30 e 90 dias pós-lançamento, não está fazendo pesquisa de UX, está fazendo opinião de UX.

Um modelo de maturidade para ferramentas de UX

Aqui está o playbook que entrego a líderes que perguntam "onde deveríamos estar?" Case sua situação com um nível, depois invista no próximo.

Nível 1: Ad hoc

Um designer, Figma, entrevistas de usuário ocasionais por Zoom. Sem processo de pesquisa repetível, sem analytics comportamental. Ok para uma startup pre-seed. O caminho de upgrade é adicionar uma ferramenta de analytics comportamental no tier gratuito (UXCam ou Hotjar) antes de entregar para clientes pagantes.

Nível 2: Instrumentado

Figma para design, FigJam ou Miro para ideação, uma ferramenta básica de analytics no lugar, estudos ocasionais de Lyssna ou UserTesting. Você tem dado mas não tem ritual para usá-lo. O caminho de upgrade é adicionar um repositório de pesquisa, instalar session replay e atribuir um DRI para revisões semanais de replay.

Nível 3: Dirigido por evidência

Toda funcionalidade vai ao ar com uma hipótese, um plano de medição e uma revisão pós-lançamento. Session replay, heatmaps e issue analytics estão na pauta semanal de todo PM. Pesquisa de painel preenche as lacunas que analytics comportamental não alcança. Tara AI ou equivalente está processando sessões em escala. A maioria das empresas de 50-500 pessoas deveria estar aqui.

Nível 4: Operacional

Pesquisa e analytics são infraestrutura. Todo designer e PM tem acesso sob demanda a comportamento real de usuário. Sinais de frustração são rastreados como métricas de primeira classe ao lado de

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

ÍNDICE

- Principais conclusões

- Como avaliamos essas UX tools

- Visão geral: as 19 melhores UX tools para 2026

- Melhores UX tools para pesquisa de usuário

- Melhores UX design tools para wireframing e prototipagem

- Melhores softwares de UX para fluxogramas e user flow

- Melhores ferramentas de UX para colaboração e handoff de design

- 13 padrões e armadilhas que separam um stack de UX funcional de uma coleção de shelfware

- Considerações específicas por indústria

- UX tools por categoria

- 10 erros comuns que vejo quando times montam um stack de UX

- Um modelo de maturidade para ferramentas de UX

Artigos relacionados

Design de UX

Mobile UX Design: Guia Completo para 2026

Mobile UX design é a prática de projetar aplicativos móveis que o usuário consegue navegar com naturalidade em telas pequenas com entrada pelo...

Silvanus Alt, PhD

Founder & CEO | UXCam

Design de UX

Revisamos as 19 Melhores UX Tools para 2026

As 19 melhores UX tools para 2026, testadas em pesquisa, wireframing, prototipagem, fluxogramas e handoff. Prós, contras e preços honestos de um...

Silvanus Alt, PhD

Founder & CEO | UXCam

Design de UX

Princípios de gestalt - Como Melhorar a UX do seu App

Crie ótimas experiências para os seus usuários utilizando ferramentas...

Luiza Drubscky

Growth Marketing