O que é UX Analytics? Um Guia Prático (+ as 10 Melhores Ferramentas de UX Analytics em 2026)

UX analytics é a prática de coletar, conectar e interpretar dados comportamentais e experienciais, como cliques, session replays, heatmaps, funis e sinais de frustração, para entender como pessoas reais realmente usam um produto digital e onde elas travam.

Eu revisei centenas de stacks de analytics de times de produto nos últimos anos, e o padrão que mais vejo é esse: times têm muitos dados e muito pouca compreensão. Dashboards cheios de contagens de eventos, taxas de rejeição e gráficos de DAU, mas ninguém consegue responder à pergunta básica "por que a conversão caiu na terça-feira passada?" em menos de uma hora.

Esse é o gap que o UX analytics fecha. Este guia percorre o que UX analytics realmente é, os métodos qualitativos e quantitativos que vale a pena usar, como construir uma estratégia que se sustente e as 10 ferramentas de UX analytics que eu colocaria na shortlist em 2026, incluindo onde cada uma realmente merece seu lugar.

Principais conclusões

UX analytics combina dados quantitativos (eventos, funis, retenção) com dados qualitativos (session replays, heatmaps, feedback) para que você entenda tanto o que o usuário faz quanto por quê.

O caminho mais rápido para insight acionável é autocapture mais session replay. Tagueamento manual de eventos vai te atrasar e deixar lacunas.

Sinais de frustração, rage taps, congelamentos de UI, erros repetidos, são a métrica de UX de maior alavancagem que a maioria dos times ignora.

Uma ferramenta de UX analytics só é útil se conectar comportamento a sessões específicas que você consegue realmente assistir. Caso contrário, você está olhando para gráficos sem explicação.

Em 2026, analistas de IA (como a Tara AI dentro do UXCam) estão substituindo o trabalho manual de assistir sessões uma a uma.

A ferramenta que você escolher deve combinar com sua plataforma. Hotjar e Mouseflow são só web. UXCam, Glassbox e Contentsquare cobrem mobile e web.

O que é UX analytics?

UX analytics é a disciplina de medir a experiência do usuário por meio de uma combinação de dados comportamentais, dados experienciais e feedback, e então transformar esses sinais em decisões de produto. Está na interseção entre product analytics e pesquisa com usuário.

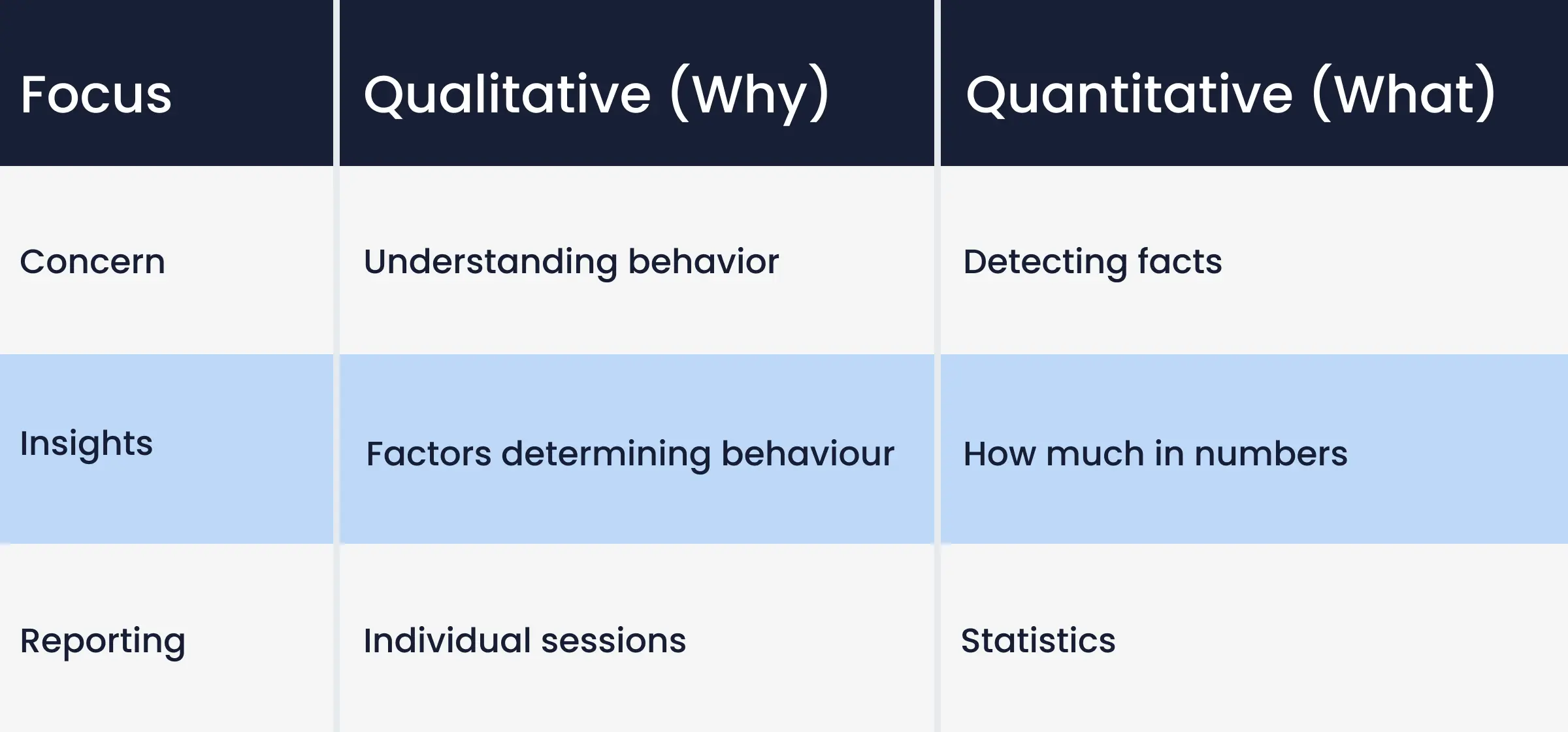

Dois tipos de dados fazem isso funcionar:

Dados quantitativos de UX dizem o que aconteceu em escala: visualizações de tela, eventos de toque, taxas de conversão, curvas de retenção, duração de sessão, quedas de funil.

Dados qualitativos de UX dizem por quê: session replays, heatmaps, respostas de pesquisa, eventos de rage tap e congelamento de UI, testes de usabilidade.

Analytics tradicional de web como Google Analytics 4 para na visão agregada. UX analytics vai uma camada mais fundo: para qualquer gráfico que você vê, dá para puxar as sessões específicas de usuário por trás dele e assistir ao que aconteceu.

Por que UX analytics importa mais do que costumava

Quando comecei nessa área, times entregavam em ciclos trimestrais e faziam teste A/B uma vez por release. Agora a velocidade de produto comprimiu para releases semanais ou diárias, e o custo de lançar um fluxo confuso é imediato: usuários evadem, tickets de suporte se acumulam e notas nas app stores caem. A pesquisa da Forrester sobre ROI de customer experience mostra que cada ponto de melhoria nos scores do CX Index pode se traduzir em centenas de milhões em receita para grandes marcas, e a mesma dinâmica de composição acontece em produtos menores, só que em escala menor.

Alguns resultados concretos que times alcançam quando operacionalizam UX analytics direito:

Encontrar fricção antes que se espalhe. A Recora reduziu tickets de suporte em 142% depois que replays do UXCam mostraram usuários pressionando-e-segurando um botão que só precisava de um único toque. Nenhuma contagem de sessão ou taxa de rejeição teria trazido isso à tona.

Aumentar conversão. A Costa Coffee subiu registros em 15% depois de encontrar e corrigir os pontos de fricção no fluxo de cadastro.

Impulsionar retenção e engajamento. A Inspire Fitness aumentou o tempo no app em 460% e cortou rage taps em 56% assistindo sistematicamente onde usuários travavam.

Crescer adoção de funcionalidades. A Housing.com moveu adoção de funcionalidade de 20% para 40% combinando funis com replays para iterar no onboarding.

Priorizar com evidência. Pare de debater HiPPOs (opiniões do mais bem pago na sala) e aponte para sessões reais de usuário.

Dados quantitativos vs qualitativos de UX

Você precisa dos dois tipos de dado. Quantitativo mostra escala, qualitativo mostra causa. Rodar um sem o outro é o erro mais comum que eu vejo:

Times com apenas dados quantitativos conseguem dizer que o funil de checkout cai 30% no passo 3, mas não o porquê.

Times com apenas dados qualitativos conseguem descrever cinco usuários específicos que deram rage tap em um toggle de preço, mas não se isso representa 0,1% ou 20% das sessões.

Plataformas modernas combinam as duas visões em um só lugar. Dentro do UXCam, qualquer passo de funil ou coorte de retenção está a um clique dos session replays subjacentes.

Métodos qualitativos de UX analytics

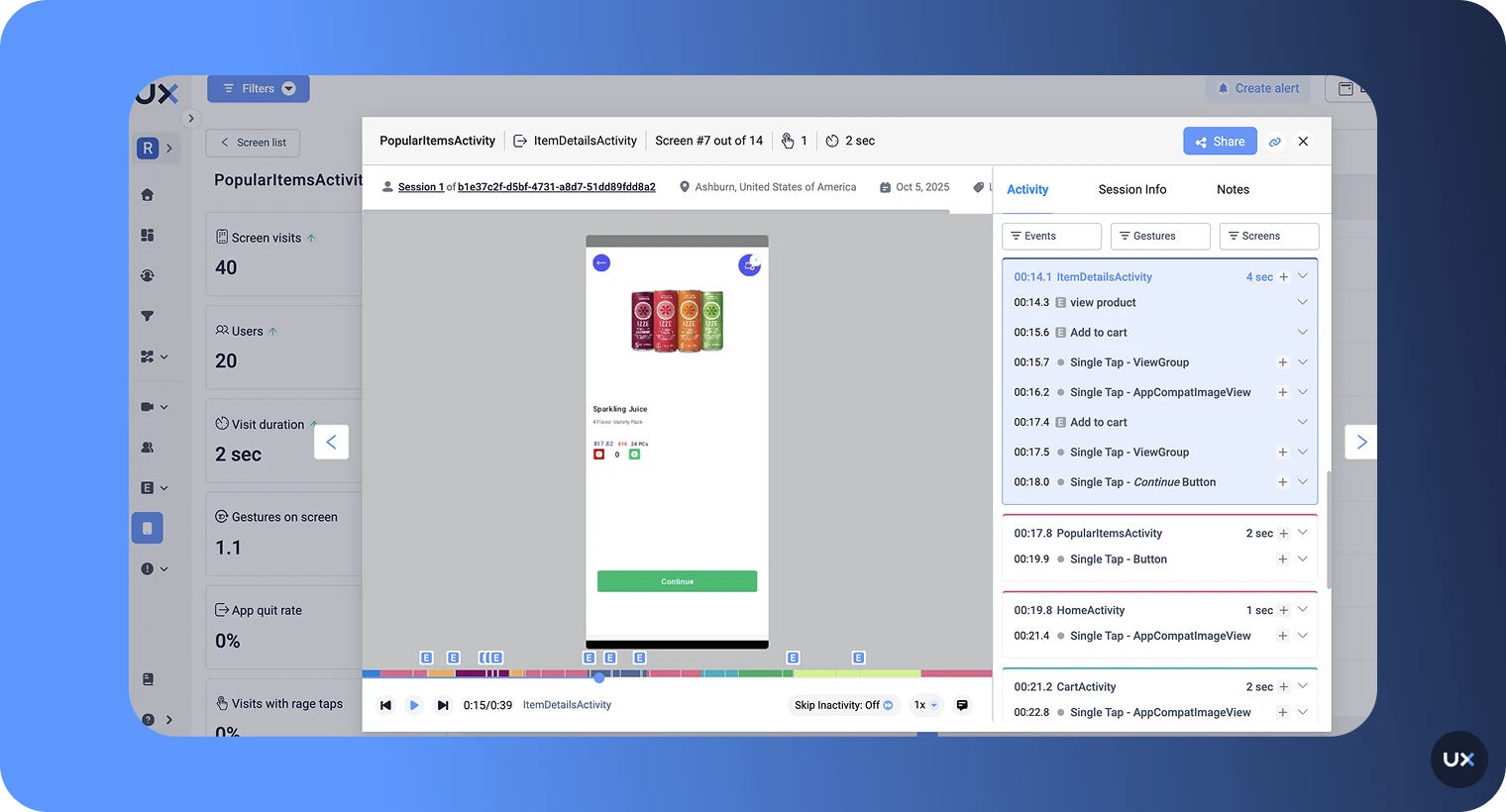

Session replay

Session replay grava interações reais do usuário, toques, rolagens, navegação, hesitação, e reproduz tudo como vídeo. É o método qualitativo de maior alavancagem para a maioria dos times de produto porque não exige recrutamento de participante, agendamento, laboratório nem moderador.

Com a Tara AI, a analista de IA do UXCam, você nem precisa assistir sessões manualmente. A Tara processa sessões em volume, traz à tona os padrões que importam e recomenda ações.

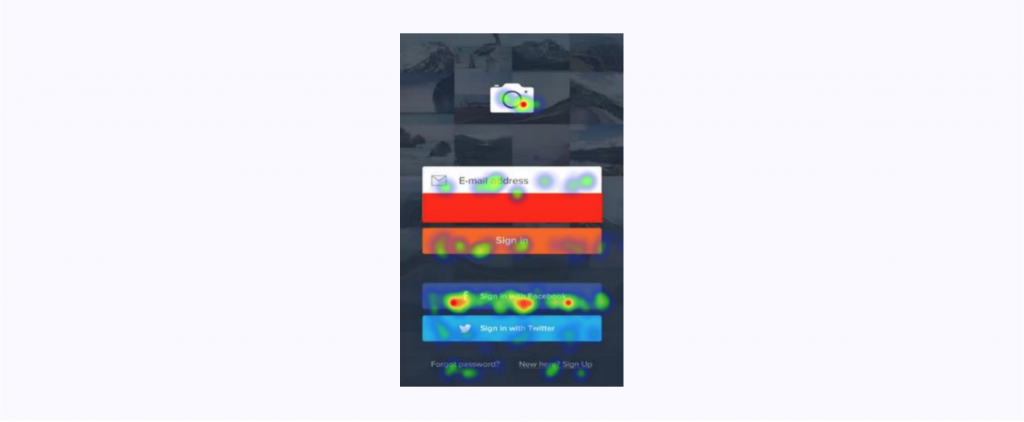

Heatmaps

Heatmaps sobrepõem densidade de toque, rolagem e atenção em uma tela para que você veja engajamento num piscar de olhos. São a forma mais rápida de identificar zonas mortas, CTAs mal interpretados e layouts em que o elemento mais tocado não é aquele em torno do qual você projetou o fluxo.

Testes de usabilidade

Teste de usabilidade dá a você observação estruturada de usuários concluindo tarefas específicas. É mais lento e mais caro que replays, mas é a ferramenta certa quando você está validando um novo fluxo pré-lançamento ou testando contra um concorrente. Combine-o com ferramentas de teste de usabilidade remoto para manter os custos baixos.

Focus groups e estudos de diário

Úteis ocasionalmente para pesquisa generativa. Raramente recomendo para UX analytics contínuo porque a relação sinal/ruído é baixa comparada a replays, e o comportamento autorrelatado dos participantes costuma ser impreciso.

Feedback do usuário e NPS

Feedback in-app, pesquisas de NPS e avaliações na app store dão input direto da voz do cliente. São mais valiosos quando conectados à sessão comportamental por trás do comentário, para que você veja o que o usuário estava fazendo quando deu rage tap até chegar a uma avaliação de 1 estrela.

Métodos quantitativos de UX analytics

Event analytics e product analytics

Tracking de eventos captura ações específicas do usuário: um toque em "Adicionar ao carrinho", uma visualização da tela de preços, um checkout bem-sucedido. Plataformas modernas suportam autocapture, que grava toda interação sem exigir que engenheiros instrumentem cada evento à mão.

Funnel analytics

Funis mostram conversão entre passos definidos e expõem onde usuários caem. A diferença entre uma boa ferramenta de funil e uma ótima: dá para clicar em uma queda e assistir aos replays dos usuários que abandonaram bem ali?

Retention analytics

Retention analytics acompanha se os usuários voltam e o que os faz voltar. Coortes de retenção de Dia 1, Dia 7 e Dia 30 combinadas com dados de uso de funcionalidade são como você identifica seus momentos reais de product-market fit.

Teste A/B

Teste A/B valida hipóteses com rigor estatístico, mas você precisa de tráfego suficiente para suportar, normalmente mais de 2.000 usuários por variante, e de uma métrica primária clara antes de começar. Veja nossa análise das melhores ferramentas de teste A/B para apps móveis.

Form e click testing

Analytics de formulário mede abandono em cada campo de input. Click testing registra qual elemento é tocado primeiro em uma dada tela. Ambas são ferramentas de uso específico que se encaixam dentro de uma prática mais ampla de UX analytics.

13 padrões, táticas e armadilhas de UX analytics que vale conhecer

Nos últimos anos fazendo isso, esses são os padrões específicos aos quais eu volto quando audito o setup de um time. Trate isso como um checklist para rodar contra sua própria prática.

1. Autocapture antes de instrumentação manual

Times que começam escrevendo um plano de tracking de 200 eventos normalmente não entregam nada por três meses. Instale um SDK de autocapture primeiro, deixe toda interação fluir, depois adicione eventos customizados para momentos críticos de negócio como "assinatura iniciada" ou "KYC concluído". O guia de plano de tracking da Segment explica por que a maioria dos planos manuais se deteriora em um trimestre.

2. Conecte cada gráfico a um replay

Se sua ferramenta de funil e sua ferramenta de replay vivem em URLs diferentes, você construiu um dashboard, não uma prática de analytics. A integração de maior alavancagem em qualquer stack de UX é "clique no passo de queda, assista às 20 sessões que caíram". Sem isso, times adivinham.

3. Trate rage taps e congelamentos de UI como métricas de primeira classe

Rage taps (toques repetidos no mesmo elemento em uma janela curta) e congelamentos de UI se correlacionam mais fortemente com churn do que quase qualquer outro comportamento que eu já medi. O issue analytics do UXCam traz ambos à tona automaticamente. Se sua ferramenta não faz isso, você está perdendo o indicador de frustração de maior sinal disponível.

4. Segmente por fonte de aquisição no primeiro dia

Um usuário de paid social se comporta completamente diferente de um usuário de indicação. Curvas de retenção agregadas escondem isso. Divida toda métrica principal por canal antes de tirar conclusões, senão você vai "corrigir" o onboarding para a coorte errada.

5. Assista a sessões em 2x com o som desligado

Dica prática, não filosófica. Você vai processar de 3 a 4 vezes mais sessões por hora, e seu reconhecimento de padrão na verdade melhora porque você para de superindexar momentos individuais. Reserve velocidade 1x para as 5-10 sessões que você quer dissecar.

6. Não amostre se puder evitar

Dados amostrados de sessão perdem a cauda longa de bugs estranhos, que é onde a maioria das correções de alto impacto se esconde. Se seu plano limita sessões, priorize a captura dos seus fluxos de maior valor (checkout, cadastro, upgrade) e despriorize o resto.

7. Construa scores de fricção, não dashboards

Um composto ponderado de rage taps, congelamentos de UI, crashes e abandono se correlaciona com volume de suporte melhor do que qualquer métrica isolada. A pesquisa da NN/g sobre frustração defende exatamente esse tipo de visão composta.

8. Revise sessões em equipe, não sozinho

Um PM solo assistindo replays encontra 30% dos insights que um PM, designer e engenheiro assistindo juntos encontram. O engenheiro identifica a falha técnica, o designer identifica o problema de layout, o PM identifica o descompasso de intenção.

9. Tagueie sessões por hipótese, não por evento

Depois da revisão, tagueie com rótulos como "confusao-checkout-frete" ou "queda-permissao-onboarding". Tags de evento ficam obsoletas. Tags de hipótese se compõem em uma biblioteca pesquisável de issues conhecidas.

10. Não confunda volume de replay com volume de insight

Assistir a 500 sessões por semana não é um KPI. Entregar 3 correções validadas por sprint a partir de insights de replay é. Meça output, não input. A Tara AI colapsa o lado do input para que você possa focar no output.

11. Instrumente estados de erro, não só caminhos felizes

A maioria dos times rastreia "payment_success". Poucos rastreiam "payment_failed_reason". Sem a taxonomia de falha, seu funil parece uma caixa-preta exatamente no momento em que você mais precisa de visibilidade.

12. Trate avaliações da app store como dado qualitativo

Avaliações são sessões rotuladas, o usuário te diz o que deu errado nas próprias palavras. Conecte as datas de avaliação da app store aos dados de sessão e você frequentemente vai encontrar o replay que originou a nota 1 estrela.

13. Mate métricas de vaidade trimestralmente

DAU não é um outcome. Duração de sessão não é um outcome. Faça uma auditoria de métricas implacável a cada trimestre e aposente qualquer coisa que não tenha influenciado uma decisão nos três meses anteriores. O artigo da ProductPlan sobre métricas de vaidade vs acionáveis é um framework inicial útil.

Considerações de UX analytics por indústria

Fintech e bancos

Compliance é a restrição dura. Masking de PII, SOC 2 e frequentemente PCI-DSS precisam estar embutidos antes de uma única sessão ser gravada. Já vi times de fintech gastarem seis semanas negociando instalações de SDK com seu time de segurança. Os times que se movem mais rápido escolhem um fornecedor com masking automático on-device (o UXCam mascara campos de input por padrão) e uma postura de compliance documentada desde o início. Observe fluxos de KYC e de funding como um falcão, é ali que a evasão se compõe em LTV perdido.

E-commerce e varejo

O abandono de carrinho fica em torno de 70% no setor, e as razões variam tela por tela. Instrumente seleção de frete, preenchimento de endereço e seleção de método de pagamento como passos separados de funil. Combine analytics de formulário com session replay para ver o campo específico que causou o abandono. Picos sazonais de tráfego (Black Friday, feriados) também significam que sua linha de base de conversão muda, segmente antes e depois para evitar falsos positivos em correções.

Saúde e telemedicina

Compliance com HIPAA é inegociável, o que tira várias ferramentas desta lista a menos que assinem um BAA. Masking vai além de cartões de crédito aqui, você precisa mascarar campos de diagnóstico, nomes de medicamento e notas do profissional. Fluxos de agendamento de consultas e renovação de receita são as jornadas de maior valor para monitorar, e rage taps em telas de agendamento se correlacionam com pacientes migrando para suporte telefônico, o que explode o custo operacional.

SaaS e B2B

Ativação é a métrica que importa. Os benchmarks de PLG da OpenView mostram que a taxa de ativação de Dia 30 é o preditor mais forte de retenção anual para SaaS self-serve. Use session replay para assistir ao que sua coorte de ativação mais rápida realmente faz, e depois otimize o onboarding para funilar todo novo usuário por esse caminho.

Mídia e streaming

Engajamento e frequência de sessão dominam, e fricção aparece como travamento e buffering em vez de toques. Combine UX analytics com dados de performance técnica (falhas de início de vídeo, taxas de rebuffer), porque um usuário que evade depois de um incidente de buffering parece comportamentalmente com um usuário que evadiu por UX. Sem a sobreposição técnica, você vai atribuir errado.

Viagem e hospitalidade

Jornadas multi-sessão são a norma, usuários pesquisam no celular, reservam no desktop, gerenciam no celular de novo. Cross-device identity stitching importa mais aqui do que na maioria das categorias. Seletores de data e interações com mapa são pontos comuns de fricção, assista aos replays de usuários que tocam no botão de busca três ou mais vezes sem mudar os inputs.

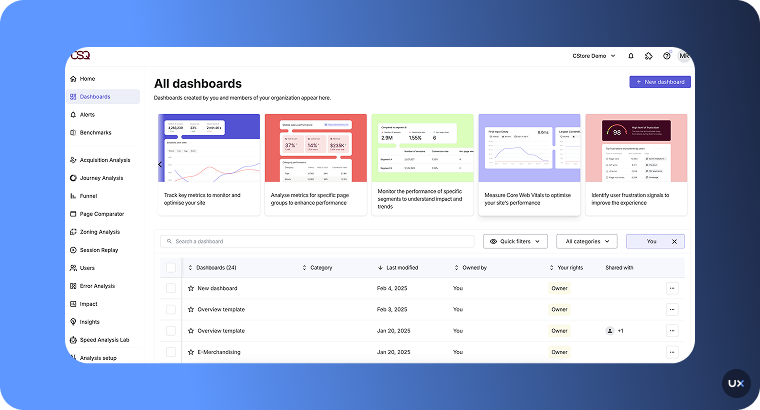

Ferramentas de UX analytics por categoria

Nem todo time precisa de uma suíte completa. Aqui está como o mercado se divide pelo trabalho específico a ser feito.

Product intelligence all-in-one: UXCam (mobile e web, com IA), Contentsquare, Glassbox, FullStory.

Product analytics quantitativo-first: Mixpanel, Amplitude, Heap, PostHog.

Qualitativo só web: Hotjar, Mouseflow, Microsoft Clarity (gratuito, surpreendentemente capaz).

Usabilidade e pesquisa com usuário: Maze, UserTesting, Lookback, Dovetail para repositórios de pesquisa.

Feedback e pesquisas: Qualtrics, Typeform, Sprig, módulos de pesquisa in-app dentro da maioria das plataformas DXA.

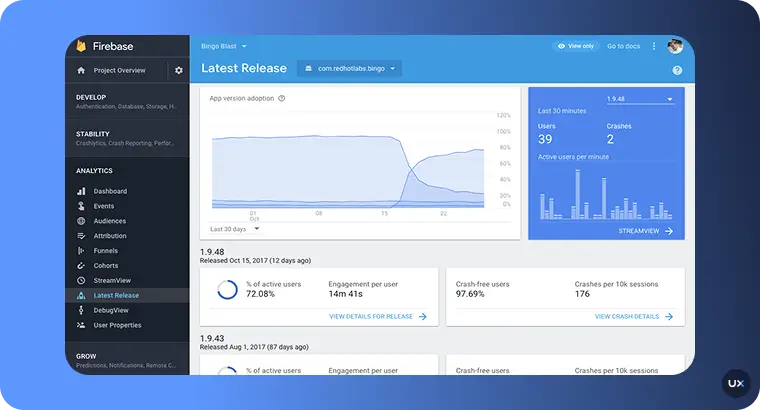

Ferramentas de apoio específicas de mobile: Firebase Analytics para atribuição de instalação, Sentry ou Bugsnag para relatório de crash, AppsFlyer ou Adjust para atribuição.

Experimentação: Statsig, LaunchDarkly, Optimizely, VWO.

Camada de data warehouse e modelagem: Snowflake, BigQuery, dbt para times construindo uma camada custom de analytics downstream.

A maioria dos times de mid-market termina com três ferramentas: uma plataforma de product intelligence (UXCam ou similar), uma ferramenta de analytics quantitativo se precisarem de trabalho mais profundo de coorte e uma ferramenta de pesquisa ou feedback. Times com quatro ou mais ferramentas sobrepostas quase sempre têm uma oportunidade de consolidação que vale de US$ 30 a 100 mil por ano.

Como construir uma estratégia de UX analytics que realmente funciona

Aqui está a sequência pela qual eu levo os times.

1. Defina a decisão que você precisa tomar, não o dashboard que você quer construir. "Devemos redesenhar o onboarding?" é uma decisão. "Rastrear todos os eventos" não é. Comece pela pergunta.

2. Escolha de 3 a 5 métricas norte de UX. Eu sugeriria: taxa de ativação, retenção de Dia 7, conversão do funil principal, taxa de rage tap e tempo até primeiro valor. Mais que isso e nada recebe atenção.

3. Instale autocapture primeiro, eventos customizados depois. Todo dia que você passa tagueando eventos manualmente é um dia em que você não está obtendo insight. SDKs de autocapture como o do UXCam capturam tudo automaticamente, depois você adiciona eventos customizados para ações específicas de negócio.

4. Conecte quantitativo ao qualitativo por padrão. Todo gráfico deve estar a um clique das sessões subjacentes. Se seu stack não suporta isso, você tem duas ferramentas desconectadas, não uma prática de analytics.

5. Faça da revisão semanal de sessão um ritual. 30 minutos por semana com seu PM, designer e engenheiro assistindo replays de usuários confusos vence qualquer relatório de pesquisa trimestral. Ou deixe a Tara AI fazer o trabalho de assistir e trazer os principais padrões.

6. Feche o ciclo. Todo insight vira um ticket, todo ticket é entregue, toda mudança entregue é medida contra a linha de base.

Um modelo de maturidade de UX analytics

Use isso para descobrir onde você realmente está, não onde gostaria de estar.

Nível 1: Reativo. Você tem Google Analytics ou Firebase, olha dashboards semanalmente e a maioria das decisões de produto é movida por opinião ou HiPPO. Quando a conversão cai, você gasta dias adivinhando as causas.

Nível 2: Instrumentado. Você instalou uma ferramenta de product analytics e tagueou seu funil principal. Consegue responder perguntas de "o que aconteceu" mas não de "por quê". Session replay, se você tem, vive em uma ferramenta separada que ninguém abre.

Nível 3: Conectado. Quantitativo e qualitativo vivem em uma só plataforma. Revisões semanais de sessão são um ritual. Rage taps e congelamentos de UI são rastreados. Você entrega mudanças com base em evidência e as mede contra uma linha de base.

Nível 4: Proativo. Uma camada de analista de IA (Tara AI ou equivalente) traz padrões à tona sem você pedir. Friction scoring é uma métrica de board. Novas funcionalidades entregam com hipóteses de UX e critérios de sucesso pré-definidos. Você pega issues em monitoramento pré-release antes que a maioria dos usuários veja.

Nível 5: Embedded. UX analytics é como a empresa inteira fala sobre usuários, não uma especialidade. Suporte, marketing e engenharia puxam dos mesmos dados comportamentais. Toda decisão de ticket, campanha e release tem uma sessão ou coorte específica por trás.

A maioria dos times que audito está no Nível 2 achando que está no Nível 3. O pulo mais rápido é do Nível 2 para o Nível 3, e normalmente está a uma consolidação de plataforma de distância.

As melhores ferramentas de UX analytics em 2026

Como eu avaliei essas ferramentas

Eu pontuei toda ferramenta em cinco critérios ponderados:

Profundidade de dado qualitativo (qualidade de session replay, fidelidade de heatmap, sinais de frustração), 30%

Analytics quantitativo (eventos, funis, retenção, coortes), 25%

Cobertura de plataforma (mobile, web, híbrido, enterprise), 15%

Setup e tempo até insight (autocapture, IA, facilidade de instrumentação), 15%

Transparência de preços e valor em escala mid-market, 15%

Também considerei as notas públicas do G2 e os resultados que clientes realmente reportam. Não incluí ferramentas que não consegui acessar ou que são primariamente automação de marketing com uma aba de analytics aparafusada.

1. UXCam

Melhor para: times de produto de apps móveis e web que também precisam de cobertura web, mais qualquer pessoa que queira analytics qualitativo e quantitativo sem rodar duas ferramentas.

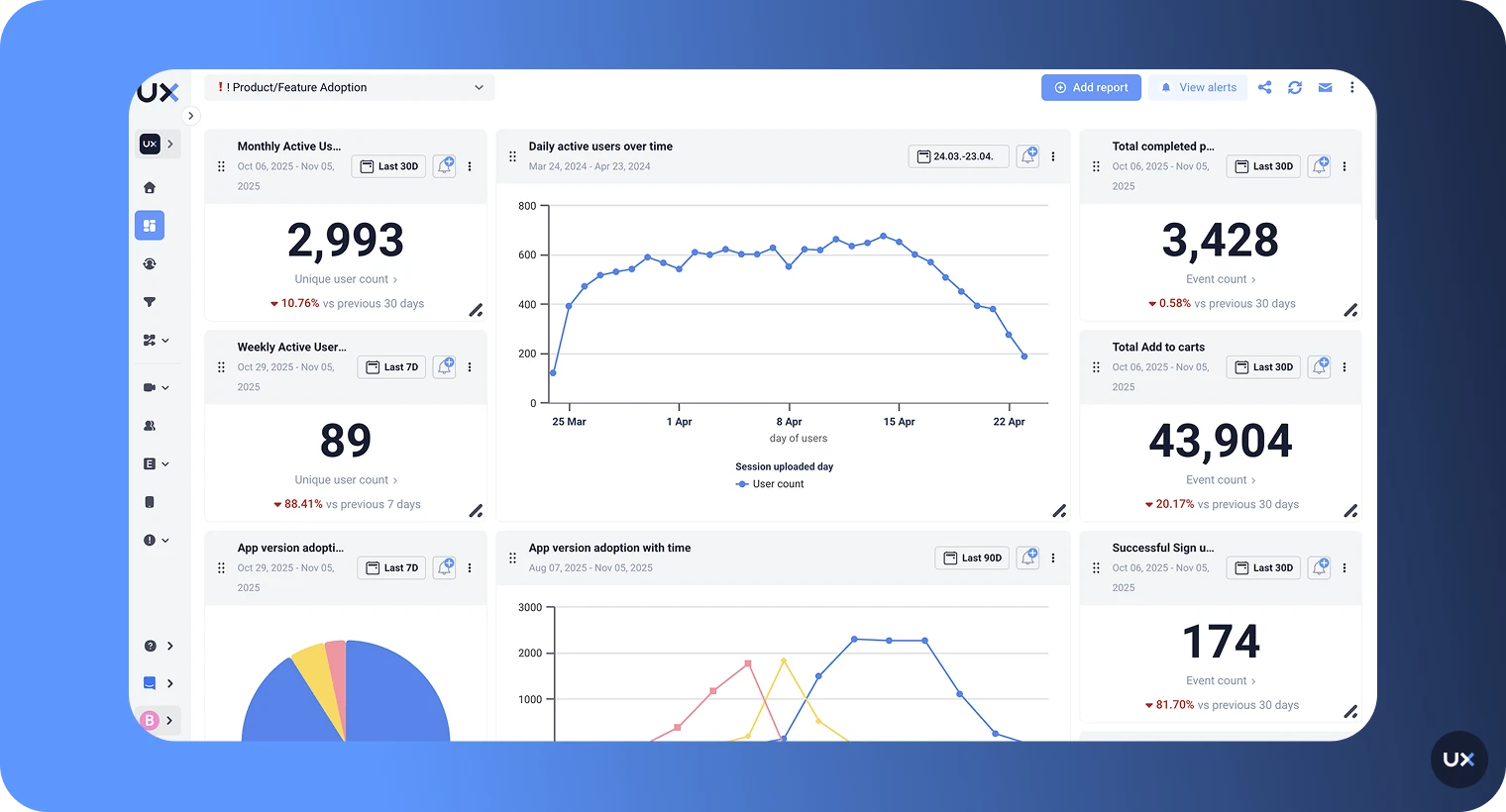

O UXCam é uma plataforma de product intelligence e product analytics instalada em mais de 37.000 produtos. Combina session replay, heatmaps, issue analytics (rage taps, congelamentos de UI, crashes), funis, retenção e Tara AI, a analista de IA que assiste sessões por você e traz padrões e recomendações à tona automaticamente. O UXCam cobre tanto apps móveis quanto web.

Prós

SDK de autocapture, não precisa tagueamento manual de eventos para começar

Tara AI resume padrões de comportamento e sinaliza fricção automaticamente

Session replays ligados a todo gráfico de funil, retenção e issue

Detecção de rage tap e congelamento de UI out of the box

Compatível com GDPR, CCPA e HIPAA com masking automático de dados

4,7 estrelas no G2

Contras

Integrações customizadas em nível enterprise podem exigir engenharia de solução

Mais poderoso em mobile, embora a paridade com web esteja agora ativa

Preço: Plano gratuito até 3.000 sessões/mês. Planos pagos customizados por volume. Veja planos do UXCam.

Prova de que funciona: Recora cortou tickets de suporte em 142%. Inspire Fitness subiu tempo no app em 460% e cortou rage taps em 56%. Housing.com dobrou adoção de funcionalidade de 20% para 40%.

2. Mixpanel

Melhor para: times de produto que querem analytics quantitativo baseado em evento e estão dispostos a combiná-lo com uma ferramenta qualitativa separada.

O Mixpanel é uma plataforma de product analytics bem estabelecida conhecida por tracking de evento flexível, funis, análise de coorte e relatório de retenção. Motor quantitativo forte, sem session replay nativo (eles têm uma funcionalidade de replay, mas é mais leve que ferramentas especialistas).

Prós

Análise poderosa de funil e coorte

Interface forte de consulta sem SQL

Plano gratuito generoso

Contras

Instrumentação de evento exige tempo de engenharia

Profundidade qualitativa (replays, heatmaps, sinais de frustração) é limitada

Custos escalam de forma acentuada com volume de evento

Preço: Plano gratuito incluso. Plano Growth começa em US$ 0,28 por 1.000 eventos. Enterprise sob consulta.

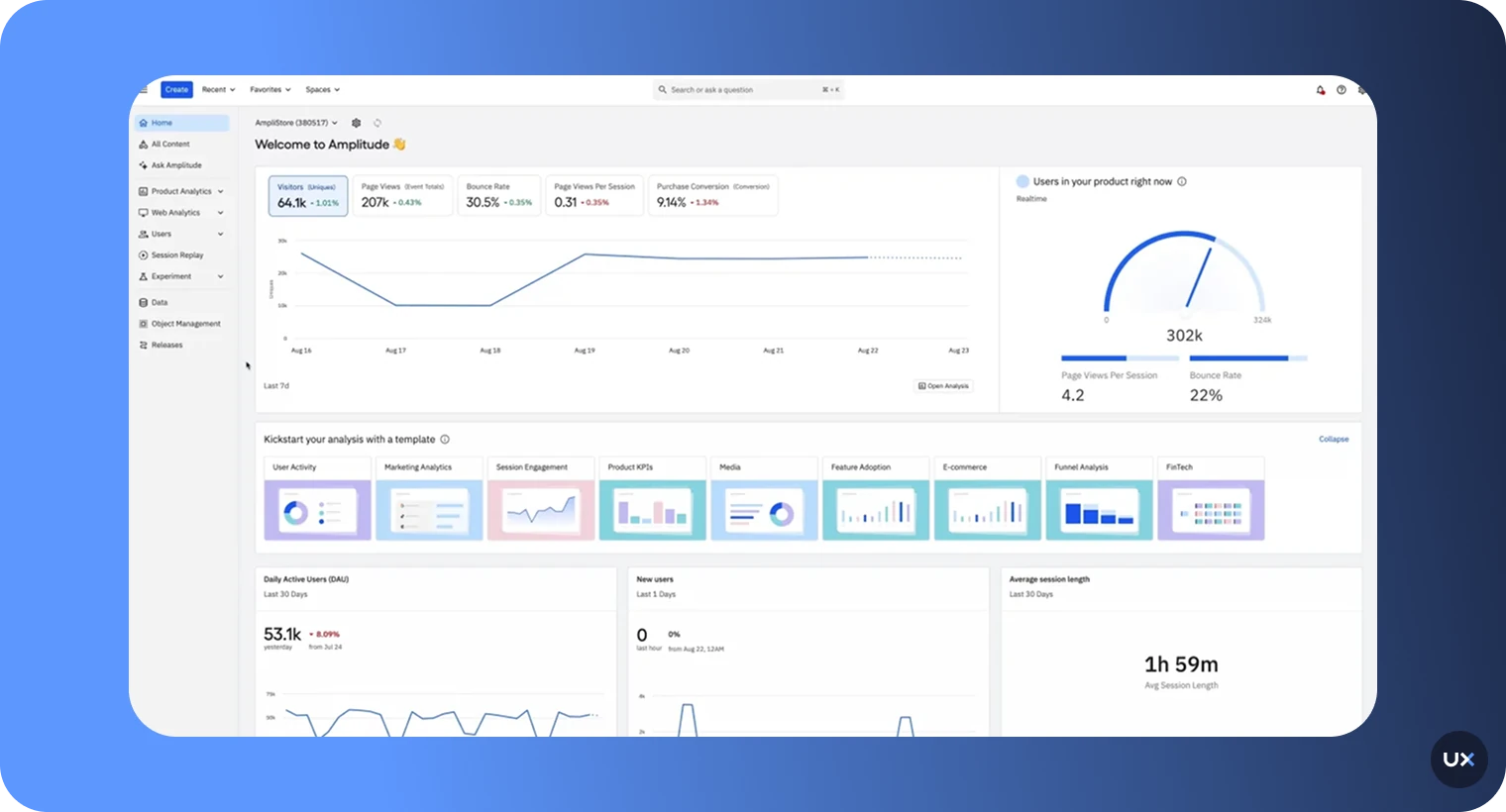

3. Amplitude

Melhor para: times grandes com função de dados dedicada e foco pesado em coortes comportamentais e analytics preditivo.

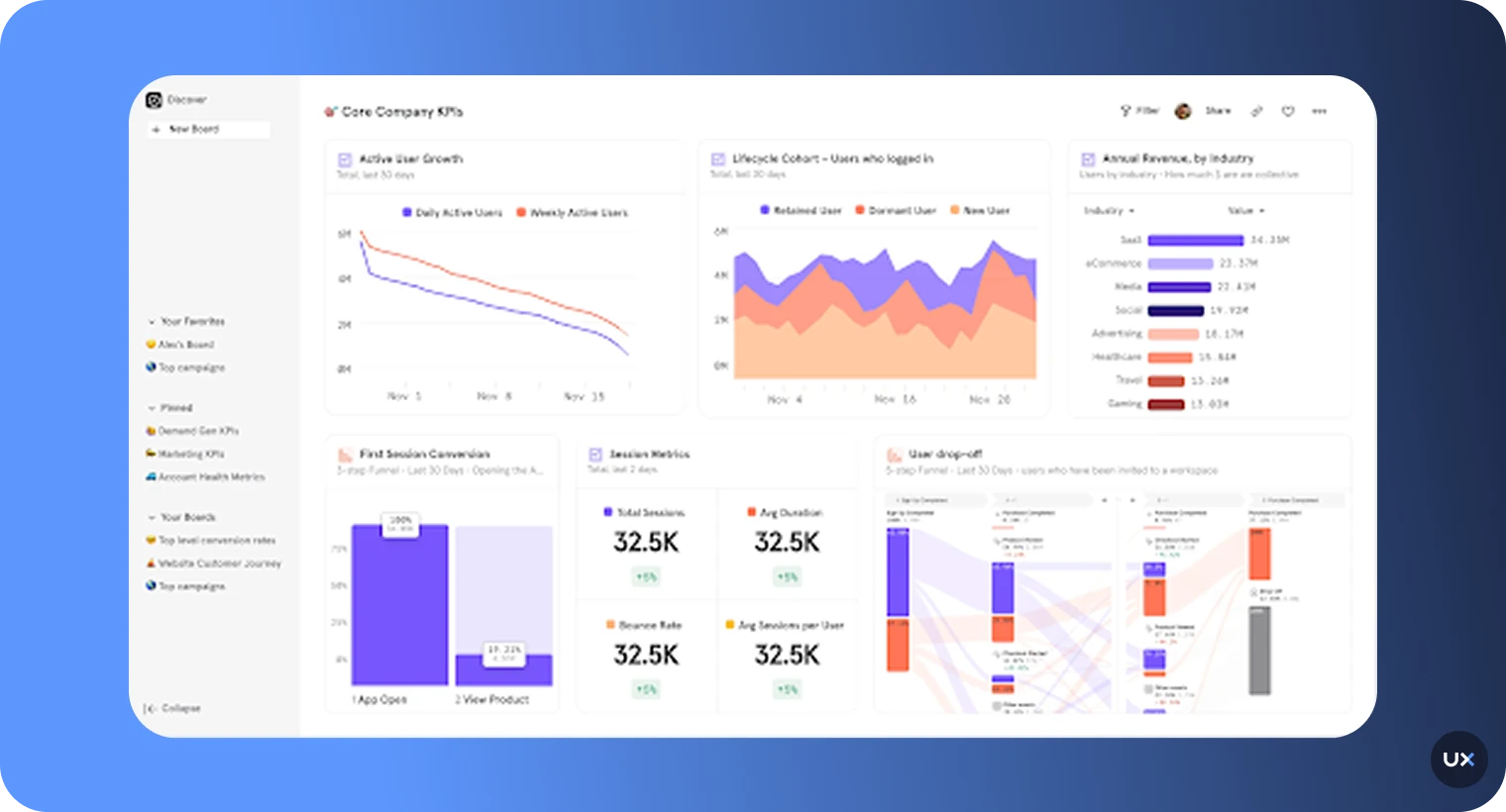

O Amplitude é um líder em product analytics com ferramentas fortes de pathfinder, coorte e preditivas. Como o Mixpanel, é quantitativo-first e mais poderoso quando combinado com uma plataforma qualitativa.

Prós

Análise de coorte comportamental de primeira classe

Visualização de fluxo Pathfinder

Modelos preditivos de churn e engajamento

Plano gratuito até 10M de eventos mensais

Contras

Curva de aprendizagem íngreme para não-analistas

Session replay é um add-on mais recente e menos maduro

Preço enterprise fica caro rápido

Preço: Gratuito até 10M de eventos/mês. Plano Plus a partir de ~US$ 61/mês. Enterprise sob consulta.

4. Contentsquare

Melhor para: times enterprise de digital experience com orçamento para uma plataforma full-suite.

O Contentsquare é uma plataforma abrangente de digital experience analytics combinando session replays, heatmaps, journey mapping, frustration scoring e insights de IA. Adquiriu a Hotjar, então há alguma sobreposição de produto, a Hotjar atende o SMB, a Contentsquare o enterprise.

Prós

Análise profunda de jornada e zoning

Insights "Sense" alimentados por IA

Forte em web e mobile web

Contras

Preço enterprise, não acessível para times menores

Implementação pode levar meses

Cobertura de app nativo mobile é menos madura do que em ferramentas para apps móveis e web

Preço: Apenas cotação customizada.

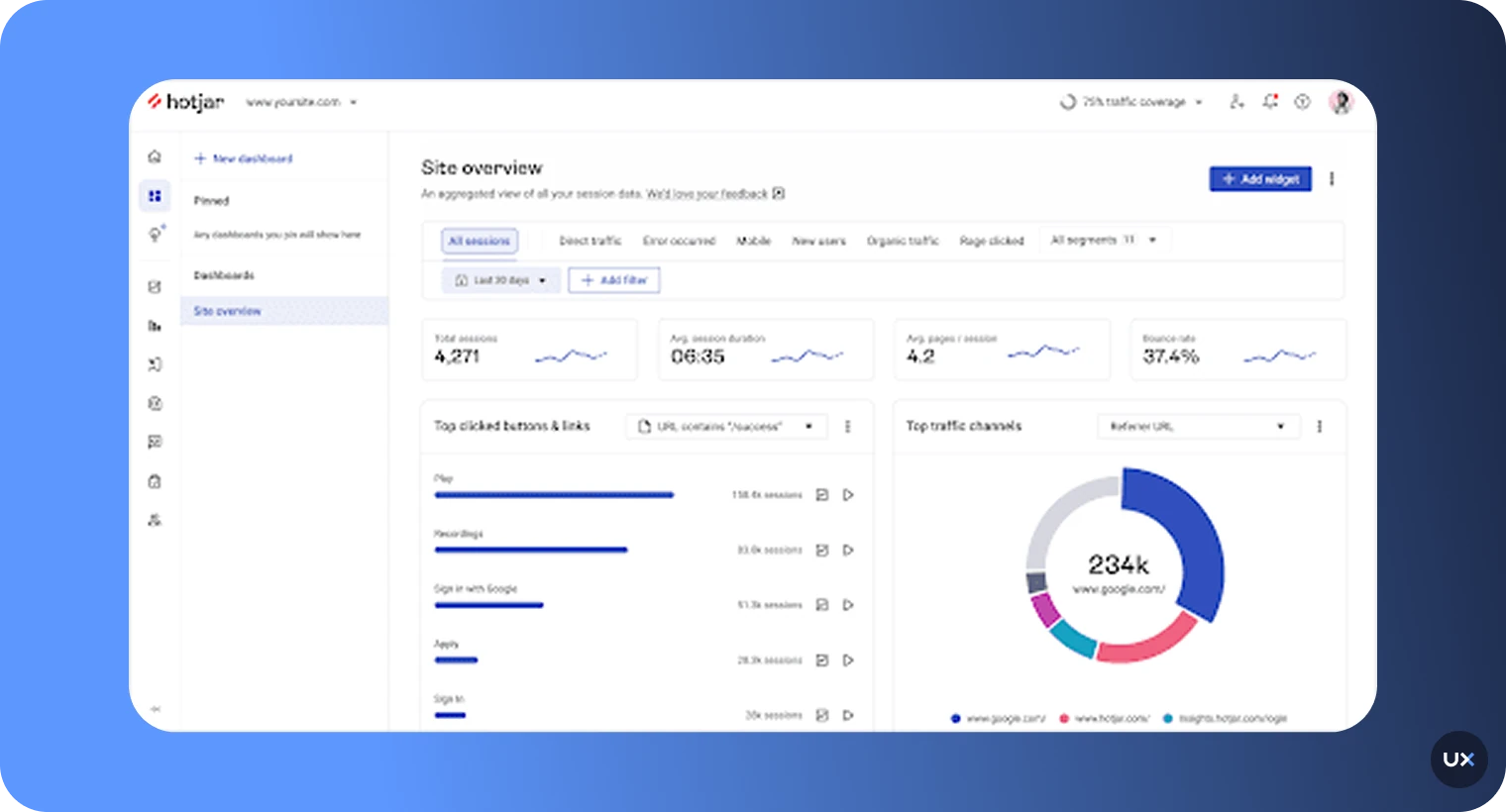

5. Hotjar

Melhor para: times web pequenos e médios que querem heatmaps, replays e pesquisas em uma ferramenta leve.

O Hotjar (agora parte da Contentsquare) é a ferramenta qualitativa de analytics web mais adotada para SMBs. Heatmaps, gravações de sessão e pesquisas no site. Só web, então times de app móvel precisam combinar com outra coisa.

Prós

Fácil de configurar, UI amigável

Plano gratuito generoso

Heatmap e replay básicos sólidos

Contras

Sem suporte nativo para app móvel

Analytics quantitativo (funis, coortes) é raso

Limites de sessão em planos inferiores batem rápido em sites de alto tráfego

Preço: Plano gratuito para sempre. Pago a partir de US$ 49/mês.

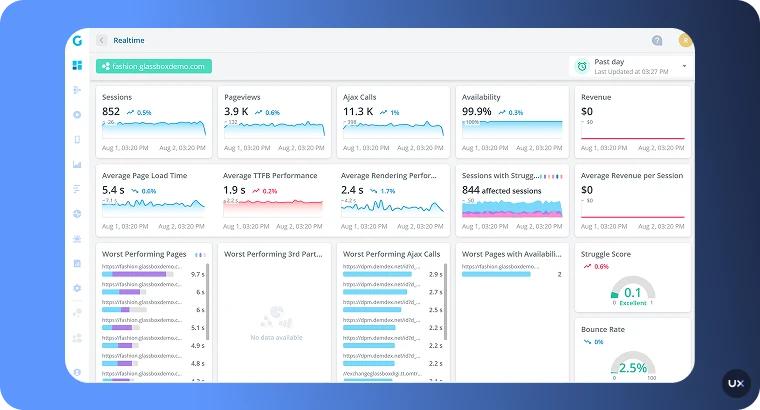

6. Glassbox

Melhor para: empresas reguladas (finanças, saúde, seguros) que precisam de 100% de captura de sessão e compliance rigoroso.

O Glassbox (que adquiriu a SessionCam) captura toda interação de usuário em web e mobile com governança de dados de nível enterprise. Feito para organizações em que você precisa de toda sessão, não de uma amostra.

Prós

Captura de sessão completa, sem amostragem

Certificado ISO/IEC 27001, compliance forte

Detecção de struggle e journey analytics

Contras

Preço e implementação enterprise

Exagero para a maioria dos times de mid-market

UI é densa e exige treinamento

Preço: Sob consulta.

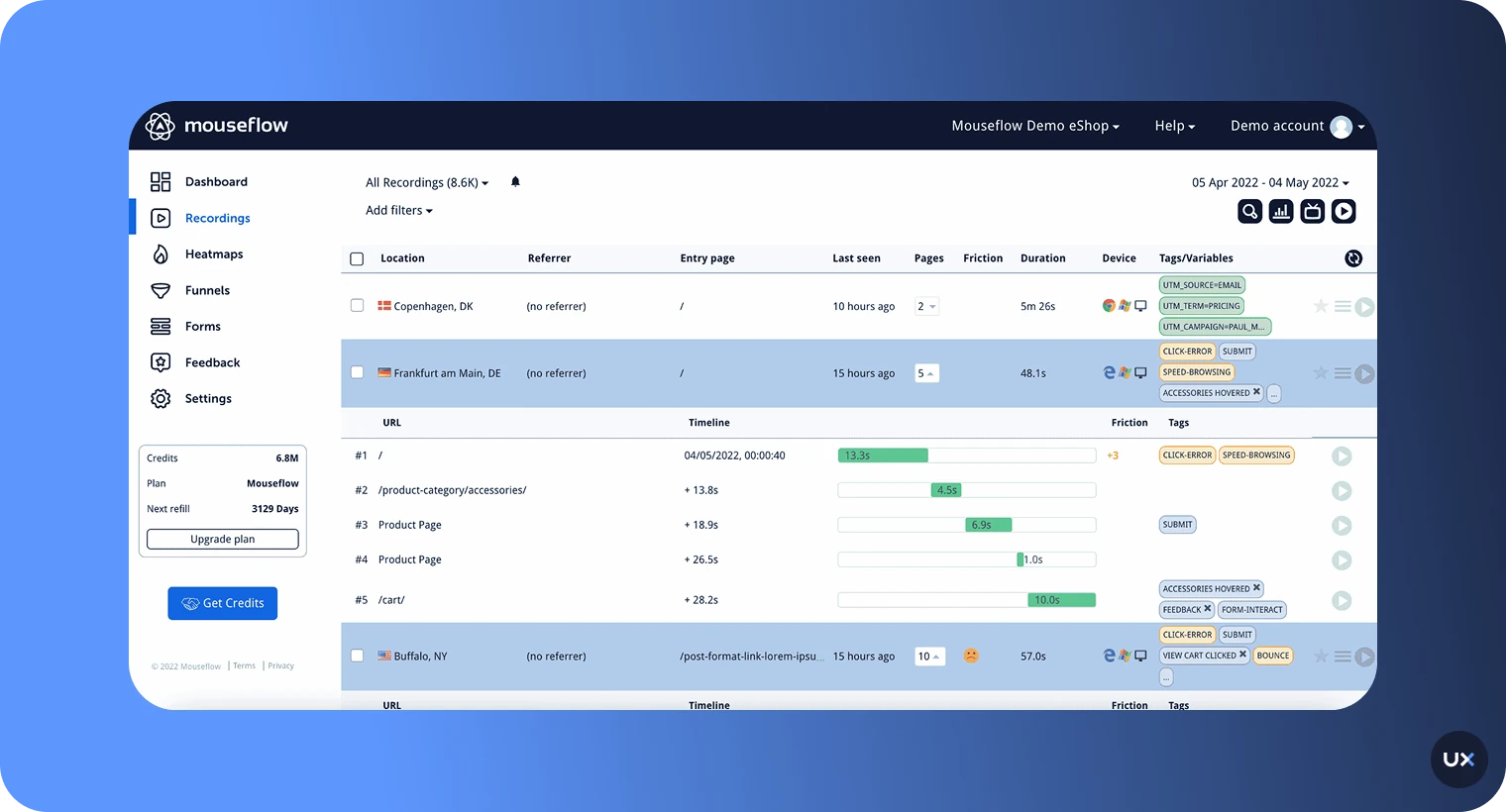

7. Mouseflow

Melhor para: times web de marketing focados em otimização de conversão.

O Mouseflow oferece session replay, seis tipos de heatmaps, funis e analytics de formulário para websites. Uma alternativa sólida ao Hotjar com variedade mais forte de heatmaps.

Prós

Seis tipos de heatmap incluindo atenção e geo

Friction scoring em sessões

Preço de entrada acessível

Contras

Só web, sem analytics de app móvel

Free tier limitado a 500 sessões/mês

Profundidade quantitativa é limitada

Preço: Gratuito até 500 sessões/mês. Pago a partir de US$ 39/mês.

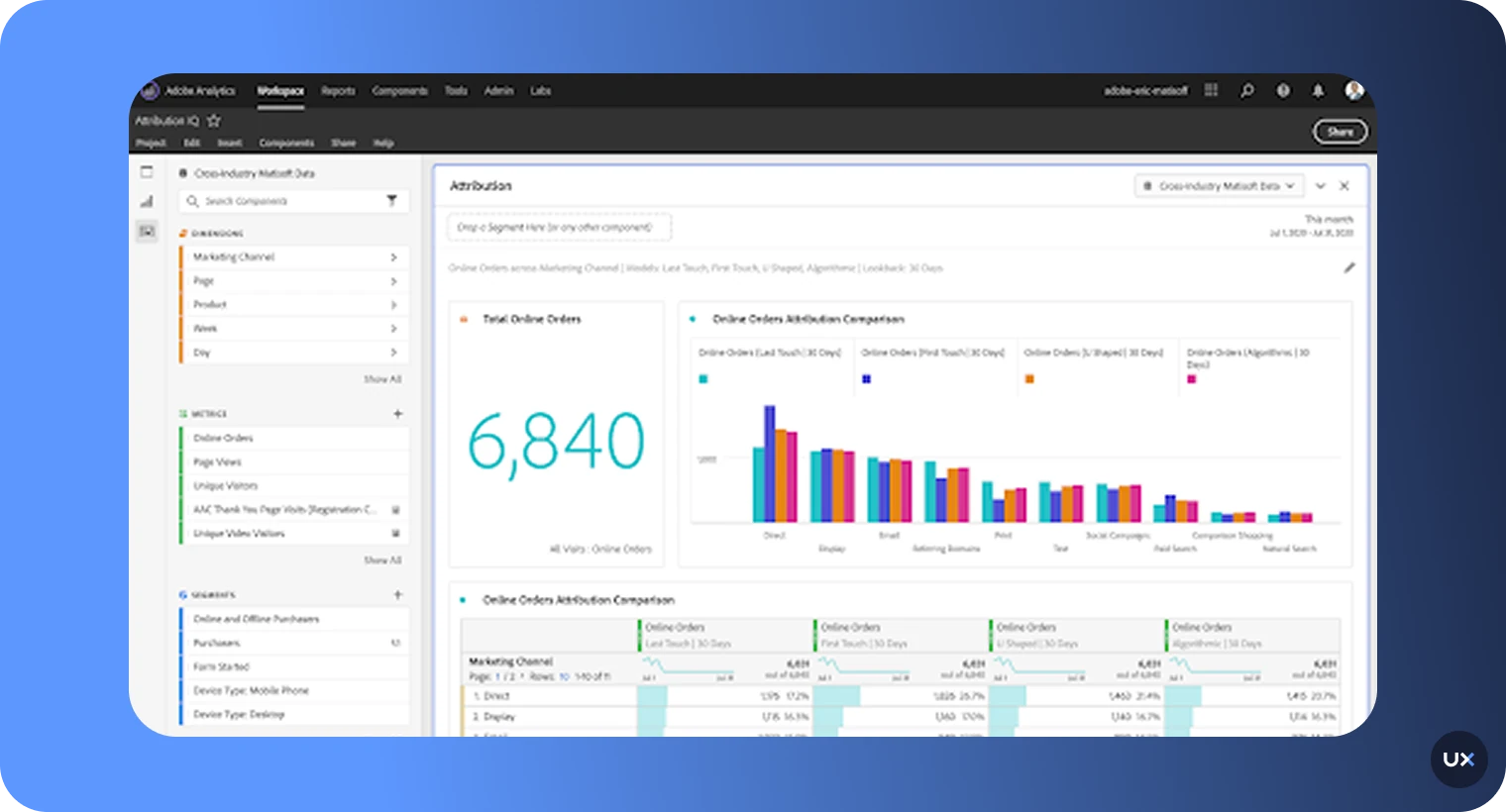

8. Adobe Analytics

Melhor para: grandes empresas já dentro do ecossistema Adobe Experience Cloud.

O Adobe Analytics é uma plataforma de analytics enterprise peso-pesado com segmentação avançada, modelagem de atribuição e previsão por IA via Adobe Sensei.

Prós

Segmentação e atribuição extremamente profundas

Integração estreita com o resto do Adobe Experience Cloud

Governança nível enterprise

Contras

Curva de aprendizagem íngreme, exige especialistas

Caro, preço apenas sob consulta

Ferramentas qualitativas são limitadas sem adicionar outros produtos Adobe

Preço: Cotação customizada.

9. Firebase Analytics

Melhor para: apps móveis em estágio inicial que precisam de tracking de evento gratuito e leve.

O Firebase Analytics (parte do Google Firebase) dá a você tracking básico de evento, segmentação de audiência e atribuição para apps móveis. Bom como ponto de partida, mas é uma ferramenta de relatório, não de UX analytics.

Prós

Gratuito para começar

Integração nativa com Google Ads e BigQuery

Bom para atribuição de instalação e relatório de crash

Contras

Sem session replay ou heatmaps

Amostragem em apps de alto volume

Latência de dado torna análise em tempo real desconfortável

Preço: Free tier, pay-as-you-go para funcionalidades avançadas.

10. FullStory

Melhor para: times com foco web que querem session replay com uma camada quantitativa forte.

O FullStory é uma plataforma de digital experience com autocapture, session replay, heatmaps e analytics de funil. Tradicionalmente web-first, com cobertura mobile crescente.

Prós

Autocapture forte e análise retroativa

UI de replay limpa

Boa detecção de sinal de frustração

Contras

Paridade mobile atrás de ferramentas para apps móveis e web

Preço enterprise opaco

Pode parecer pesado para times pequenos

Preço: Cotação customizada.

Comparativo rápido

| Ferramenta | Melhor para | Mobile | Web | Plano gratuito | Preço inicial |

|---|---|---|---|---|---|

| UXCam | Times de produto mobile + web | ✅ | ✅ | 3.000 sessões/mês | Sob consulta |

| Mixpanel | Product analytics baseado em evento | ✅ | ✅ | Sim | US$ 0,28/1k eventos |

| Amplitude | Analytics comportamental enterprise | ✅ | ✅ | 10M eventos/mês | ~US$ 61/mês |

| Contentsquare | DXA enterprise | Limitado | ✅ | Não | Sob consulta |

| Hotjar | Times web SMB | ❌ | ✅ | Sim | US$ 49/mês |

| Glassbox | Enterprise regulada | ✅ | ✅ | Não | Sob consulta |

| Mouseflow | CRO web | ❌ | ✅ | 500 sessões/mês | US$ 39/mês |

| Adobe Analytics | Enterprise stack Adobe | ✅ | ✅ | Não | Sob consulta |

| Firebase | Mobile em estágio inicial | ✅ | Limitado | Sim | Gratuito |

| FullStory | DXA web | Limitado | ✅ | Não | Sob consulta |

10 erros comuns de UX analytics para evitar

Taguear 200 eventos antes de assistir a 20 sessões. Instrumentação sem observação produz dashboards que ninguém lê. Inverta a ordem.

Tratar session replay como teatro de vigilância. Se você está assistindo sessões para validar uma decisão que já tomou, vai encontrar o que quer. Entre com uma hipótese, não com um veredito.

Ignorar masking de PII até o jurídico acender o alerta. Fazer retrofit de masking em um código-base maduro é doloroso. Configure no primeiro dia, mesmo que você seja um time de duas pessoas.

Medir duração de sessão como métrica de sucesso. Sessões longas podem significar engajamento ou confusão. Sem sinais de frustração sobrepostos, você não sabe qual é.

Rodar análise de funil em uma única janela de data. Funis mudam com sazonalidade, campanhas de marketing e releases. Sempre compare semana contra semana ou contra uma coorte de controle.

Confiar em dados autorrelatados de pesquisa mais do que em dados comportamentais. Usuários rotineiramente descrevem comportamentos que não batem com seus replays. Quando os dois conflitam, o comportamento vence.

Construir um data warehouse custom antes de validar as perguntas. Implementações de seis meses de Snowflake são um movimento preferido de procrastinação para times que não querem enfrentar seus issues reais de UX.

Só assistir a sessões de usuários evadidos. Você também precisa assistir a power users. O delta entre um usuário confuso e um fluente te diz onde investir esforço de design.

Pular métricas específicas de mobile em um produto pesado em mobile. Áreas de toque, conflitos de gesto e prompts de permissão se comportam nada parecido com cliques web. Instrumente para a plataforma em que você realmente está.

Reter insights dentro do time de produto. Suporte, marketing e vendas todos se beneficiam de evidência de sessão. Monte um canal no Slack ou um e-mail semanal em que os 3 melhores replays da semana sejam compartilhados.

O que vem a seguir para UX analytics

Algumas mudanças que estou acompanhando de perto em 2026:

Analistas de IA substituem o trabalho manual de assistir replay. Ferramentas como a Tara AI dentro do UXCam processam milhares de sessões e trazem à tona os 5 padrões que importam. O workflow de revisão manual está acabando.

Friction scoring se torna a métrica primária de UX. Rage taps, congelamentos de UI e erros repetidos te dão um "friction score" composto que se correlaciona firmemente com churn e volume de suporte.

Analytics unificado de mobile e web. Times estão consolidando de 3 a 4 ferramentas separadas em uma plataforma que cobre toda superfície.

Privacy-first por padrão. Com regulação evoluindo na UE, EUA e APAC, masking automático de PII não é mais uma funcionalidade premium, é o básico.

Melhore seu UX analytics com o UXCam

Se você está cansado de assistir a dashboards que não se explicam, comece um trial gratuito do UXCam. Você vai receber 3.000 sessões mensais, session replay completo, heatmaps, funis, issue analytics e Tara AI. Instalado em mais de 37.000 produtos, para apps móveis e web.

Pergunt

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

Artigos relacionados

Product best practices

Design Centrado no Usuário: Definição, Princípios, Processo e Como Medir

Design centrado no usuário explicado por um analista de produto: princípios, processo UCD, métricas e como equipes usam dados de sessão para validar...

Silvanus Alt, PhD

Founder & CEO | UXCam

Product best practices

Diseño centrado en el usuario: definición, principios, proceso y cómo medirlo

Diseño centrado en el usuario explicado por un analista de producto: principios, proceso de UCD, métricas y cómo los equipos usan datos de sesión para...

Silvanus Alt, PhD

Founder & CEO | UXCam

Product best practices

User-Centered Design: Definition, Principles, Process, and Methods

User-centered design (UCD) is a design framework that prioritizes users' needs, behaviors, and context at every stage of the product process, from...

Silvanus Alt, PhD

Founder & CEO | UXCam