¿Qué es UX Analytics? Guía de un practicante (+ las 10 mejores herramientas de UX Analytics en 2026)

UX analytics es la práctica de recopilar, conectar e interpretar datos de comportamiento y de experiencia, como clics, session replays, heatmaps, funnels y señales de frustración, para entender cómo usan realmente un producto digital las personas reales y dónde se quedan atascadas.

He revisado los stacks de analytics de cientos de equipos de producto en los últimos años, y el patrón que veo con más frecuencia es este: los equipos tienen un montón de datos pero muy poca comprensión. Dashboards llenos de conteos de eventos, tasas de rebote y gráficos de DAU, y aun así nadie puede responder la pregunta básica "¿por qué cayó la conversión el martes pasado?" en menos de una hora.

Esa brecha es la que cierra UX analytics. Esta guía recorre qué es realmente UX analytics, los métodos cualitativos y cuantitativos que vale la pena usar, cómo construir una estrategia que se sostenga y las 10 herramientas de UX analytics que pondría en mi shortlist en 2026, incluyendo dónde cada una realmente se gana su lugar.

Conclusiones clave

UX analytics combina datos cuantitativos (eventos, funnels, retención) con datos cualitativos (session replays, heatmaps, feedback) para que entiendas tanto qué hacen los usuarios como por qué.

El camino más rápido a un insight útil es autocapture más session replay. El etiquetado manual de eventos te va a frenar y dejar vacíos.

Las señales de frustración, rage taps, congelamientos de UI y errores repetidos son la métrica de UX de mayor impacto que la mayoría de los equipos ignora.

Una herramienta de UX analytics solo es útil si conecta el comportamiento con sesiones específicas que realmente puedas ver. De lo contrario estás mirando gráficos sin explicación.

En 2026, los analistas de IA (como Tara AI dentro de UXCam) están reemplazando la tarea manual de mirar sesiones una por una.

La herramienta que elijas debería coincidir con tu plataforma. Hotjar y Mouseflow son solo para web. UXCam, Glassbox y Contentsquare manejan móvil y web.

¿Qué es UX analytics?

UX analytics es la disciplina de medir la experiencia de usuario a través de una combinación de datos de comportamiento, datos de experiencia y feedback, y luego convertir esas señales en decisiones de producto. Se sitúa en la intersección entre product analytics y la investigación de usuarios.

Dos tipos de datos la hacen funcionar:

Los datos cuantitativos de UX te dicen qué pasó a escala: vistas de pantalla, eventos de toque, tasas de conversión, curvas de retención, duración de sesión, caídas de funnel.

Los datos cualitativos de UX te dicen por qué: session replays, heatmaps, respuestas de encuestas, eventos de rage tap y congelamientos de UI, pruebas de usabilidad.

El web analytics tradicional, como Google Analytics 4, se queda en la vista agregada. UX analytics va una capa más profundo: para cualquier gráfico que veas, puedes abrir las sesiones específicas de usuarios detrás de él y ver qué pasó.

Por qué UX analytics importa más que antes

Cuando empecé en este espacio, los equipos lanzaban en un ciclo trimestral y hacían A/B tests una vez por release. Ahora la velocidad de producto se comprimió a releases semanales o diarios, y el costo de lanzar un flujo confuso es inmediato: los usuarios hacen churn, los tickets de soporte se acumulan y las calificaciones en las app stores se caen. La investigación de Forrester sobre ROI de customer experience muestra que cada punto de mejora en los puntajes del CX Index puede traducirse en cientos de millones en ingresos para marcas grandes, y la misma dinámica compuesta se da en productos más chicos, solo que a menor escala.

Algunos resultados concretos que logran los equipos cuando operacionalizan bien UX analytics:

Encuentran la fricción antes de que se propague. Recora redujo los tickets de soporte en un 142% después de que los replays de UXCam mostraran usuarios presionando-y-manteniendo un botón que solo necesitaba un toque. Ningún conteo de sesiones o tasa de rebote habría hecho aflorar eso.

Impulsan la conversión. Costa Coffee aumentó los registros un 15% después de encontrar y corregir los puntos de fricción en su flujo de sign-up.

Generan retención y engagement. Inspire Fitness incrementó el tiempo en app un 460% y redujo los rage taps un 56% al mirar sistemáticamente dónde se atascaban los usuarios.

Hacen crecer la adopción de funcionalidades. Housing.com llevó la adopción de funcionalidades del 20% al 40% combinando funnels con replays para iterar sobre el onboarding.

Priorizan con evidencia. Dejan de debatir HiPPOs (opiniones de la persona mejor pagada) y apuntan a sesiones reales de usuarios.

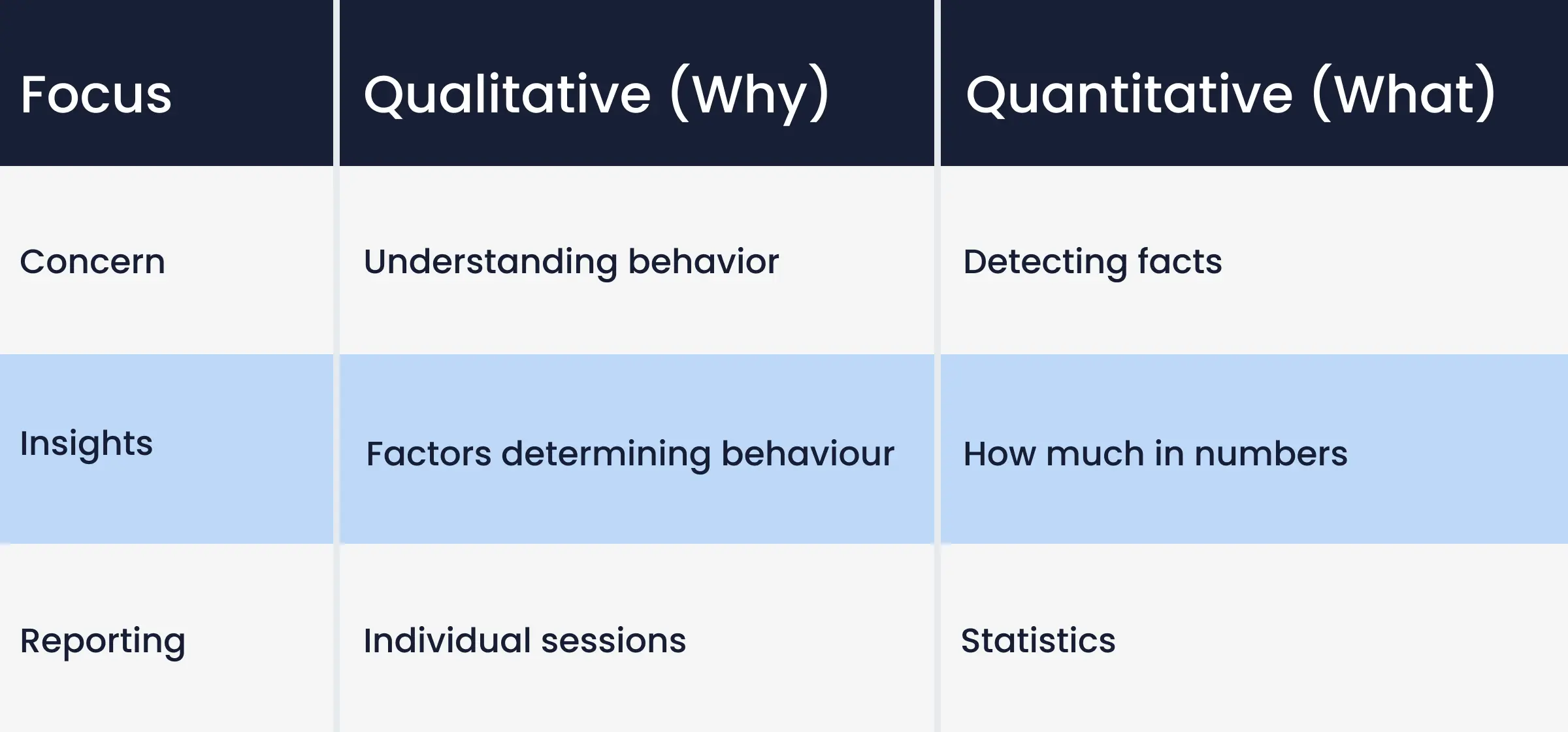

Datos cuantitativos vs cualitativos de UX

Necesitas los dos tipos de datos. Lo cuantitativo muestra la escala, lo cualitativo muestra la causa. Usar uno sin el otro es el error más común que veo:

Los equipos con solo datos cuantitativos pueden decirte que el funnel de checkout cae un 30% en el paso 3, pero no por qué.

Los equipos con solo datos cualitativos pueden describir cinco usuarios específicos que hicieron rage tap en un toggle de precios, pero no si eso representa el 0,1% o el 20% de las sesiones.

Las plataformas modernas combinan las dos vistas en un solo lugar. Dentro de UXCam, cualquier paso de funnel o cohorte de retención está a un clic de los session replays subyacentes.

Métodos cualitativos de UX analytics

Session replay

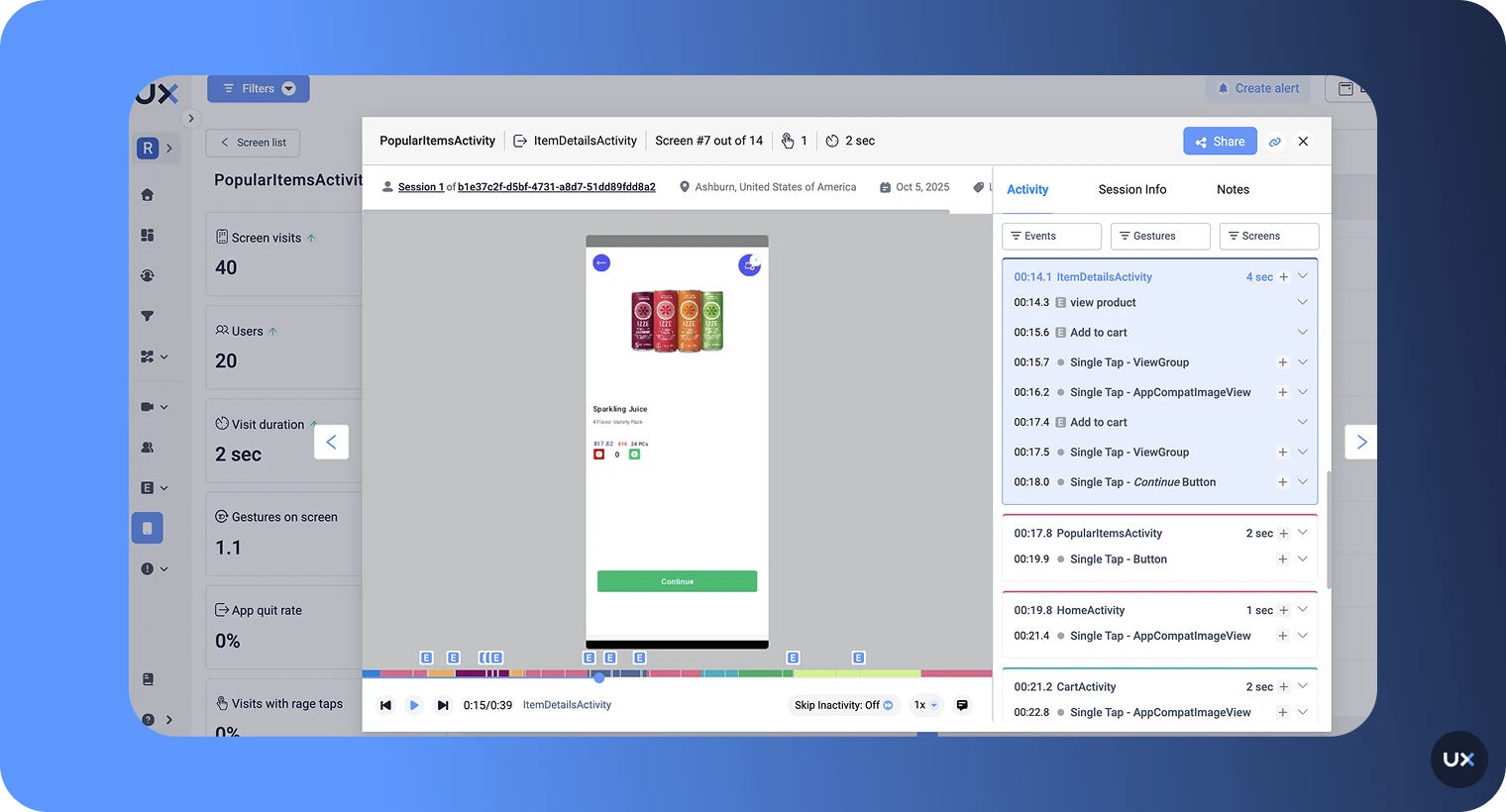

Session replay graba interacciones reales de los usuarios, toques, scrolls, navegación, duda, y las reproduce como video. Es el método cualitativo de mayor impacto para la mayoría de los equipos de producto porque no requiere reclutar participantes, ni agendar, ni laboratorio, ni moderador.

Con Tara AI, la analista de IA de UXCam, ni siquiera necesitas ver sesiones manualmente. Tara procesa sesiones a volumen, hace aflorar los patrones que importan y recomienda acciones.

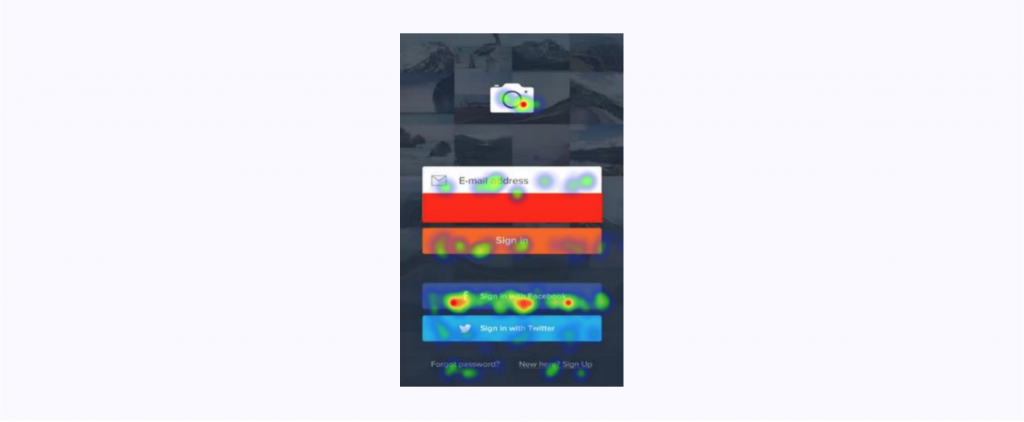

Heatmaps

Los heatmaps superponen densidad de toques, scroll y atención sobre una pantalla para que veas el engagement de un vistazo. Son la forma más rápida de detectar zonas muertas, CTAs mal leídos y layouts donde el elemento más tocado no es aquel alrededor del cual diseñaste el flujo.

Pruebas de usabilidad

Las pruebas de usabilidad te dan observación estructurada de usuarios completando tareas específicas. Son más lentas y más caras que los replays, pero son la herramienta correcta cuando estás validando un flujo nuevo prelanzamiento o probando contra un competidor. Combínalas con herramientas de pruebas de usabilidad remotas para mantener bajos los costos.

Focus groups y estudios de diario

Útiles ocasionalmente para investigación generativa. Rara vez los recomiendo para UX analytics continuo porque la relación señal-ruido es baja comparada con los replays, y el comportamiento autorreportado de los participantes suele ser inexacto.

Feedback de usuarios y NPS

El feedback in-app, las encuestas de NPS y las reseñas en app stores te dan input directo de voz del cliente. Son más valiosas cuando se conectan con la sesión de comportamiento detrás del comentario, de modo que puedas ver qué estaba haciendo el usuario cuando hizo rage tap hasta dejar una reseña de 1 estrella.

Métodos cuantitativos de UX analytics

Event y product analytics

El tracking de eventos captura acciones específicas de usuarios: un toque en "Agregar al carrito", una vista de la pantalla de precios, un checkout exitoso. Las plataformas modernas soportan autocapture, que registra cada interacción sin requerir que los ingenieros instrumenten cada evento a mano.

Funnel analytics

Los funnels te muestran la conversión entre pasos definidos y exponen dónde caen los usuarios. La diferencia entre una buena herramienta de funnels y una excelente: ¿puedes hacer clic en una caída y ver los replays de los usuarios que abandonaron justo ahí?

Retention analytics

El retention analytics rastrea si los usuarios regresan y qué los hace volver. Las cohortes de retención de día 1, día 7 y día 30 combinadas con datos de uso de funcionalidades son la forma de identificar tus verdaderos momentos de product-market fit.

A/B testing

El A/B testing valida hipótesis con rigor estadístico, pero necesitas tráfico suficiente para darle poder, usualmente más de 2.000 usuarios por variante, y una métrica primaria clara antes de empezar. Mira nuestro desglose de las mejores herramientas de A/B testing para mobile apps.

Pruebas de formularios y clics

El análisis de formularios mide el abandono en cada campo de entrada. El click testing registra qué elemento se toca primero en una pantalla dada. Ambas son herramientas de uso acotado que encajan dentro de una práctica más amplia de UX analytics.

13 patrones, tácticas y tropiezos de UX analytics que vale la pena conocer

A lo largo de los últimos años haciendo esto, estos son los patrones específicos a los que sigo volviendo cuando audito el setup de un equipo. Tómalo como un checklist que puedes correr contra tu propia práctica.

1. Autocapture antes de instrumentación manual

Los equipos que empiezan escribiendo un plan de tracking de 200 eventos usualmente no lanzan nada por tres meses. Instala un SDK de autocapture primero, consigue que todas las interacciones estén fluyendo, después agrega eventos personalizados para los momentos críticos del negocio como "subscription started" o "KYC completed". La guía de planes de tracking de Segment explica por qué la mayoría de los planes manuales se deterioran en un trimestre.

2. Conecta cada gráfico a un replay

Si tu herramienta de funnels y tu herramienta de replay viven en URLs diferentes, construiste un dashboard, no una práctica de analytics. La integración de mayor impacto en cualquier stack de UX es "haz clic en el paso de caída, mira las 20 sesiones que cayeron". Sin ella, los equipos adivinan.

3. Monitorea rage taps y congelamientos de UI como métricas de primera clase

Los rage taps (toques repetidos sobre el mismo elemento en una ventana corta) y los congelamientos de UI correlacionan más estrechamente con el churn que casi cualquier otro comportamiento que haya medido. El issue analytics de UXCam hace aflorar los dos automáticamente. Si tu herramienta no lo hace, te estás perdiendo el indicador de frustración de mayor señal disponible.

4. Segmenta por fuente de adquisición desde el día uno

Un usuario de paid-social se comporta de forma totalmente distinta a un usuario de referido. Las curvas de retención agregadas esconden eso. Divide cada métrica principal por canal antes de sacar conclusiones, si no, vas a "arreglar" el onboarding para la cohorte equivocada.

5. Mira sesiones a velocidad 2x con el sonido apagado

Consejo práctico, no filosófico. Vas a procesar de 3 a 4 veces más sesiones por hora, y tu reconocimiento de patrones en realidad mejora porque dejas de obsesionarte con momentos individuales. Reserva la velocidad 1x para las 5 a 10 sesiones que quieras diseccionar.

6. No muestrees si puedes evitarlo

Los datos de sesión muestreados se pierden la cola larga de bugs raros, que es donde se esconden la mayoría de los arreglos de alto impacto. Si tu plan tope las sesiones, prioriza capturar tus flujos de mayor valor (checkout, signup, upgrade) y despriorizar todo lo demás.

7. Construye puntajes de fricción, no dashboards

Un compuesto ponderado de rage taps, congelamientos de UI, crashes y abandono correlaciona con el volumen de soporte mejor que cualquier métrica individual. La investigación del NN/g sobre frustración argumenta exactamente por esta clase de vista compuesta.

8. Revisa sesiones en equipo, no en solitario

Un PM solo mirando replays encuentra el 30% de los insights que un PM, un diseñador y un ingeniero mirando juntos encuentran. El ingeniero detecta el glitch técnico, el diseñador detecta el problema de layout, el PM detecta el desajuste de intención.

9. Etiqueta sesiones por hipótesis, no por evento

Después de revisar, etiqueta con labels como "checkout-confusion-shipping" u "onboarding-permission-drop". Las etiquetas de eventos envejecen. Las etiquetas de hipótesis se componen en una biblioteca buscable de problemas conocidos.

10. No confundas volumen de replay con volumen de insights

Ver 500 sesiones por semana no es un KPI. Lanzar 3 arreglos validados por sprint a partir de insights de replay sí lo es. Mide el output, no el input. Tara AI colapsa el lado del input para que puedas enfocarte en el output.

11. Instrumenta los estados de error, no solo los happy paths

La mayoría de los equipos trackean "payment_success". Pocos trackean "payment_failed_reason". Sin la taxonomía de fallos, tu funnel parece una caja negra justo en el momento en que más necesitas visibilidad.

12. Trata las reseñas de app store como datos cualitativos

Las reseñas son sesiones etiquetadas, el usuario te dice qué salió mal con sus propias palabras. Conecta las fechas de las reseñas de app store con los datos de sesión y con frecuencia vas a encontrar el replay que provocó la calificación de 1 estrella.

13. Elimina métricas de vanidad cada trimestre

El DAU no es un resultado. La duración de sesión no es un resultado. Haz una auditoría despiadada de métricas cada trimestre y retira cualquiera que no haya influido en una decisión en los últimos tres meses. El artículo de vanidad vs accionables de ProductPlan es un marco útil para empezar.

Consideraciones de UX analytics específicas por industria

Fintech y banca

El cumplimiento es la restricción dura. El enmascaramiento de PII, SOC 2 y a menudo PCI-DSS tienen que estar integrados antes de que se grabe una sola sesión. He visto equipos de fintech pasar seis semanas negociando instalaciones de SDK con su equipo de seguridad. Los equipos que se mueven más rápido eligen un proveedor con enmascaramiento automático en el dispositivo (UXCam enmascara los campos de entrada por defecto) y postura de cumplimiento documentada desde el principio. Vigila los flujos de KYC y funding como un halcón, ahí es donde el dropout se compone en LTV perdido.

E-commerce y retail

El abandono de carrito ronda el 70% a nivel industria, y las razones varían pantalla por pantalla. Instrumenta la selección de envío, la entrada de dirección y la selección de método de pago como pasos de funnel separados. Combina form analytics con session replay para poder ver el campo específico que causó el abandono. Los picos de tráfico estacional (Black Friday, fin de año) también significan que tu conversión base cambia, segmenta antes y después para evitar falsos positivos en los arreglos.

Salud y telemedicina

El cumplimiento de HIPAA es no negociable, lo que descarta varias herramientas de esta lista a menos que firmen un BAA. El enmascaramiento va más allá de las tarjetas de crédito aquí, necesitas enmascarar campos de diagnóstico, nombres de medicación y notas del proveedor. Los flujos de reserva de citas y renovación de recetas son las jornadas de mayor valor para monitorear, y los rage taps en pantallas de reserva correlacionan con pacientes que saltan al soporte telefónico, lo que dispara el costo operativo.

SaaS y B2B

La activación es la métrica que importa. Los benchmarks de PLG de OpenView muestran que la tasa de activación a día 30 es el predictor individual más fuerte de la retención anual para SaaS self-serve. Usa session replay para ver qué hace realmente tu cohorte que activa más rápido, después optimiza el onboarding para dirigir a cada usuario nuevo por ese camino.

Medios y streaming

El engagement y la frecuencia de sesión dominan, y la fricción aparece como stalling y buffering más que como toques. Combina UX analytics con datos de rendimiento técnico (fallos de arranque de video, ratios de rebuffer), porque un usuario que hace churn tras un incidente de buffering se ve conductualmente como uno que hizo churn por UX. Sin la capa técnica, vas a atribuir mal.

Viajes y hospitalidad

Las jornadas multi-sesión son la norma, los usuarios investigan en móvil, reservan en escritorio, gestionan en móvil otra vez. La unificación de identidad entre dispositivos importa más aquí que en la mayoría de las categorías. Los date pickers y las interacciones con mapas son puntos comunes de fricción, mira los replays de usuarios que tocan el botón de búsqueda tres o más veces sin cambiar los inputs.

Herramientas de UX analytics por categoría

No todo equipo necesita una suite completa. Así es como se desglosa el mercado según el trabajo específico a hacer.

Product intelligence todo-en-uno: UXCam (móvil y web, con IA), Contentsquare, Glassbox, FullStory.

Product analytics cuantitativo primero: Mixpanel, Amplitude, Heap, PostHog.

Cualitativo solo web: Hotjar, Mouseflow, Microsoft Clarity (gratis, sorprendentemente capaz).

Usabilidad e investigación de usuarios: Maze, UserTesting, Lookback, Dovetail para repositorios de investigación.

Feedback y encuestas: Qualtrics, Typeform, Sprig, módulos de encuestas in-app dentro de la mayoría de plataformas DXA.

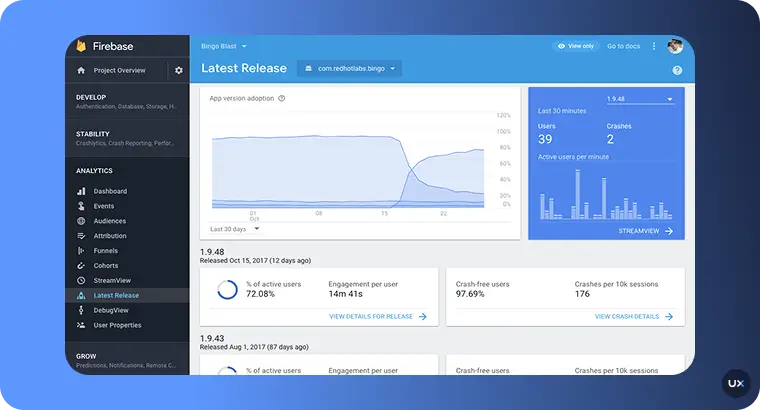

Herramientas de apoyo específicas para móvil: Firebase Analytics para atribución de instalaciones, Sentry o Bugsnag para reporte de crashes, AppsFlyer o Adjust para atribución.

Experimentación: Statsig, LaunchDarkly, Optimizely, VWO.

Data warehouse y capa de modelado: Snowflake, BigQuery, dbt para equipos que construyen una capa de analytics personalizada aguas abajo.

La mayoría de los equipos de mid-market terminan con tres herramientas: una plataforma de product intelligence (UXCam o similar), una herramienta de analytics cuantitativo si necesitan trabajo de cohortes más profundo y una herramienta de encuestas o feedback. Los equipos con cuatro o más herramientas superpuestas casi siempre tienen una oportunidad de consolidación que vale entre 30.000 y 100.000 USD anuales.

Cómo construir una estrategia de UX analytics que realmente funcione

Esta es la secuencia por la que llevo a los equipos.

1. Define la decisión que necesitas tomar, no el dashboard que quieres construir. "¿Deberíamos rediseñar el onboarding?" es una decisión. "Trackear todos los eventos" no lo es. Empieza con la pregunta.

2. Elige de 3 a 5 métricas UX north-star. Yo sugeriría: tasa de activación, retención a día 7, conversión clave de funnel, tasa de rage taps y tiempo hasta el primer valor. Más que eso y nada recibe atención.

3. Instala primero autocapture, después eventos personalizados. Cada día que pasas etiquetando eventos manualmente es un día en que no estás obteniendo insights. Los SDKs de autocapture como el de UXCam capturan todo automáticamente, después agregas eventos personalizados para acciones específicas del negocio.

4. Conecta lo cuantitativo con lo cualitativo por defecto. Cada gráfico debería estar a un clic de las sesiones subyacentes. Si tu stack no lo soporta, tienes dos herramientas desconectadas, no una práctica de analytics.

5. Haz de la revisión semanal de sesiones un ritual. 30 minutos a la semana con tu PM, diseñador e ingeniero mirando replays de usuarios confundidos le gana a cualquier informe trimestral de investigación. O deja que Tara AI mire por ti y te traiga los patrones principales.

6. Cierra el ciclo. Cada insight se convierte en un ticket, cada ticket se lanza, cada cambio lanzado se mide contra la línea base.

Un modelo de madurez de UX analytics

Úsalo para descubrir dónde estás realmente, no dónde quisieras estar.

Nivel 1: Reactivo. Tienes Google Analytics o Firebase, miras dashboards semanalmente y la mayoría de las decisiones de producto están impulsadas por opinión o por HiPPO. Cuando cae la conversión, pasas días adivinando las causas.

Nivel 2: Instrumentado. Instalaste una herramienta de product analytics y etiquetaste tu funnel principal. Puedes responder preguntas de "qué pasó" pero no de "por qué". El session replay, si lo tienes, vive en una herramienta separada que nadie abre.

Nivel 3: Conectado. Lo cuantitativo y lo cualitativo viven en una sola plataforma. Las revisiones semanales de sesiones son un ritual. Se trackean rage taps y congelamientos de UI. Lanzas cambios basados en evidencia y los mides contra una línea base.

Nivel 4: Proactivo. Una capa de analista de IA (Tara AI o equivalente) hace aflorar patrones sin que los pidas. El puntaje de fricción es una métrica a nivel de directorio. Las nuevas funcionalidades se lanzan con hipótesis de UX y criterios de éxito predefinidos. Detectas problemas en monitoreo pre-release antes de que la mayoría de los usuarios los vea.

Nivel 5: Embebido. UX analytics es cómo toda la compañía habla de los usuarios, no una especialidad. Soporte, marketing e ingeniería tiran de los mismos datos de comportamiento. Cada ticket, campaña y decisión de release tiene una sesión o cohorte específica detrás.

La mayoría de los equipos que audito están en Nivel 2 creyendo que están en Nivel 3. El salto más rápido es de Nivel 2 a Nivel 3, y usualmente está a una consolidación de plataforma de distancia.

Las mejores herramientas de UX analytics en 2026

Cómo evalué estas herramientas

Puntué cada herramienta en cinco criterios ponderados:

Profundidad de datos cualitativos (calidad del session replay, fidelidad de heatmaps, señales de frustración), 30%

Analytics cuantitativo (eventos, funnels, retención, cohortes), 25%

Cobertura de plataforma (móvil, web, híbrido, enterprise), 15%

Setup y tiempo hasta el insight (autocapture, IA, facilidad de instrumentación), 15%

Transparencia de precios y valor a escala mid-market, 15%

También consideré las calificaciones públicas de G2 y los resultados que los clientes realmente reportan. No incluí herramientas a las que no pude acceder o que son principalmente marketing automation con una pestaña de analytics pegada.

1. UXCam

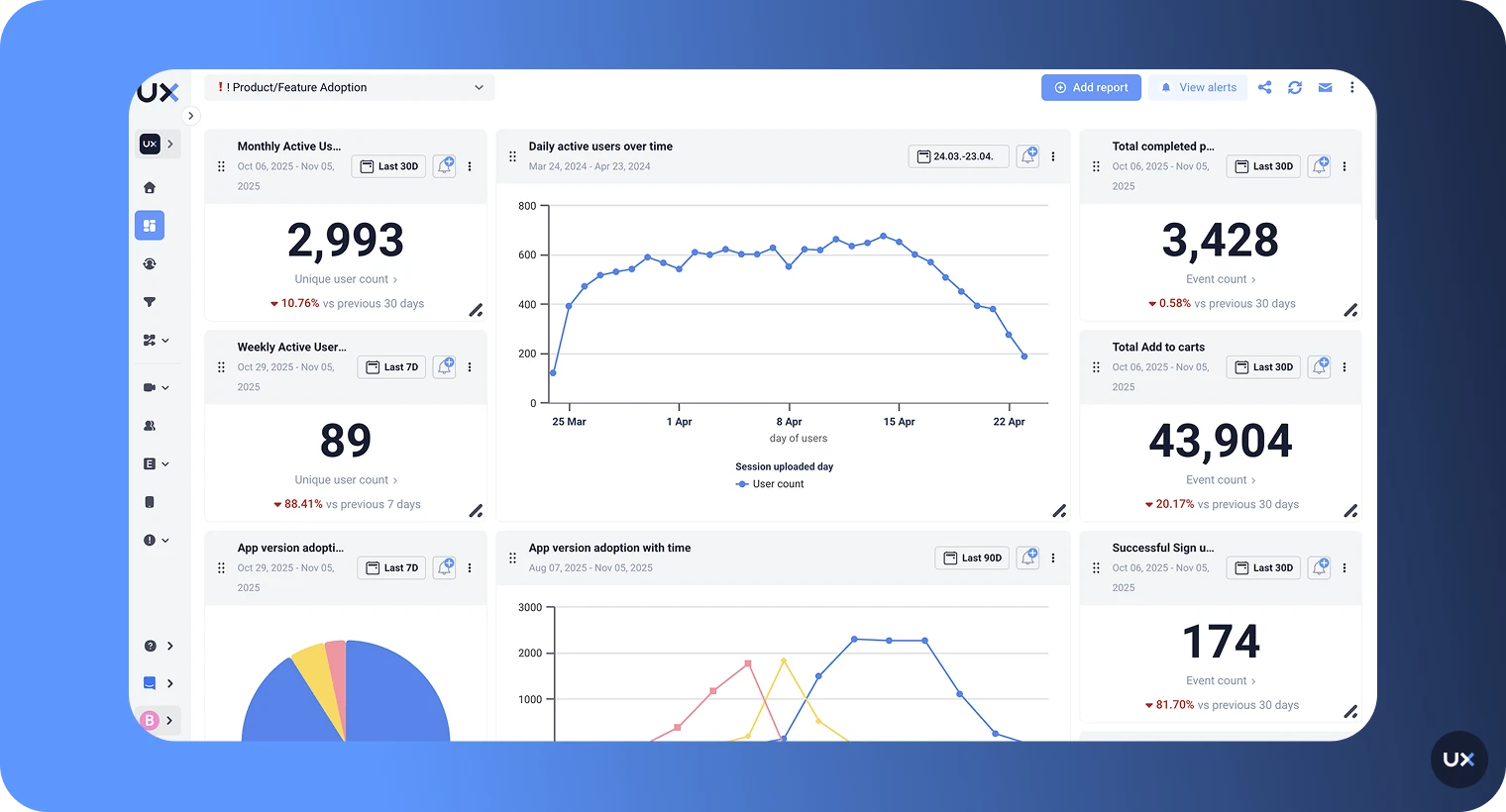

Ideal para: equipos de producto de apps móviles y web que también necesitan web, más cualquiera que quiera analytics cualitativo y cuantitativo sin correr dos herramientas.

UXCam es una plataforma de product intelligence y product analytics instalada en más de 37.000 productos. Combina session replay, heatmaps, issue analytics (rage taps, congelamientos de UI, crashes), funnels, retención y Tara AI, la analista de IA que mira sesiones por ti y hace aflorar patrones y recomendaciones automáticamente. UXCam cubre tanto aplicaciones móviles como la web.

Pros

SDK de autocapture, no necesitas etiquetado manual de eventos para empezar

Tara AI resume patrones de comportamiento y marca fricción automáticamente

Session replays vinculados a cada gráfico de funnel, retención e incidencias

Detección de rage taps y congelamientos de UI lista para usar

Cumple con GDPR, CCPA y HIPAA con enmascaramiento automático de datos

4,7 estrellas en G2

Contras

Las integraciones personalizadas de nivel enterprise pueden requerir ingeniería de soluciones

Más potente en móvil, aunque la paridad web ya está disponible

Precios: Plan gratuito hasta 3.000 sesiones/mes. Planes pagos personalizados por volumen. Mira los planes de UXCam.

Prueba de que funciona: Recora redujo los tickets de soporte en un 142%. Inspire Fitness elevó el tiempo en app un 460% y redujo los rage taps un 56%. Housing.com duplicó la adopción de funcionalidades del 20% al 40%.

2. Mixpanel

Ideal para: equipos de producto que quieren analytics cuantitativo basado en eventos y están dispuestos a combinarlo con una herramienta cualitativa separada.

Mixpanel es una plataforma de product analytics bien establecida, conocida por el tracking flexible de eventos, funnels, análisis de cohortes y reportes de retención. Motor cuantitativo fuerte, sin session replay nativo (tienen una funcionalidad de replay pero es más liviana que las herramientas especializadas).

Pros

Análisis potente de funnels y cohortes

Interfaz de consulta sin SQL muy sólida

Tier gratuito generoso

Contras

La instrumentación de eventos requiere tiempo de ingeniería

La profundidad cualitativa (replays, heatmaps, señales de frustración) es limitada

Los costos escalan pronunciadamente con el volumen de eventos

Precios: Plan gratuito incluido. Plan Growth desde 0,28 USD por 1.000 eventos. Enterprise personalizado.

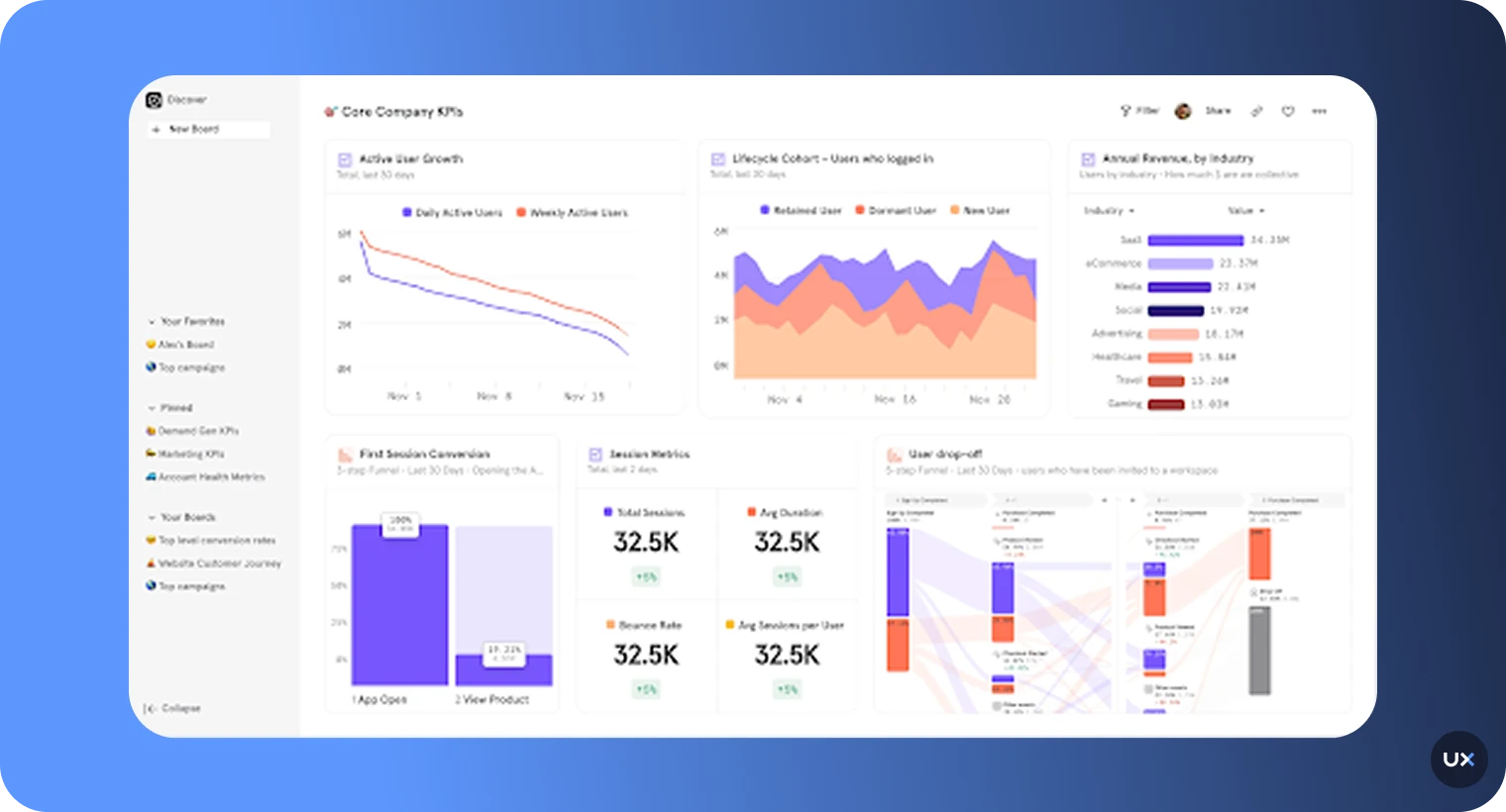

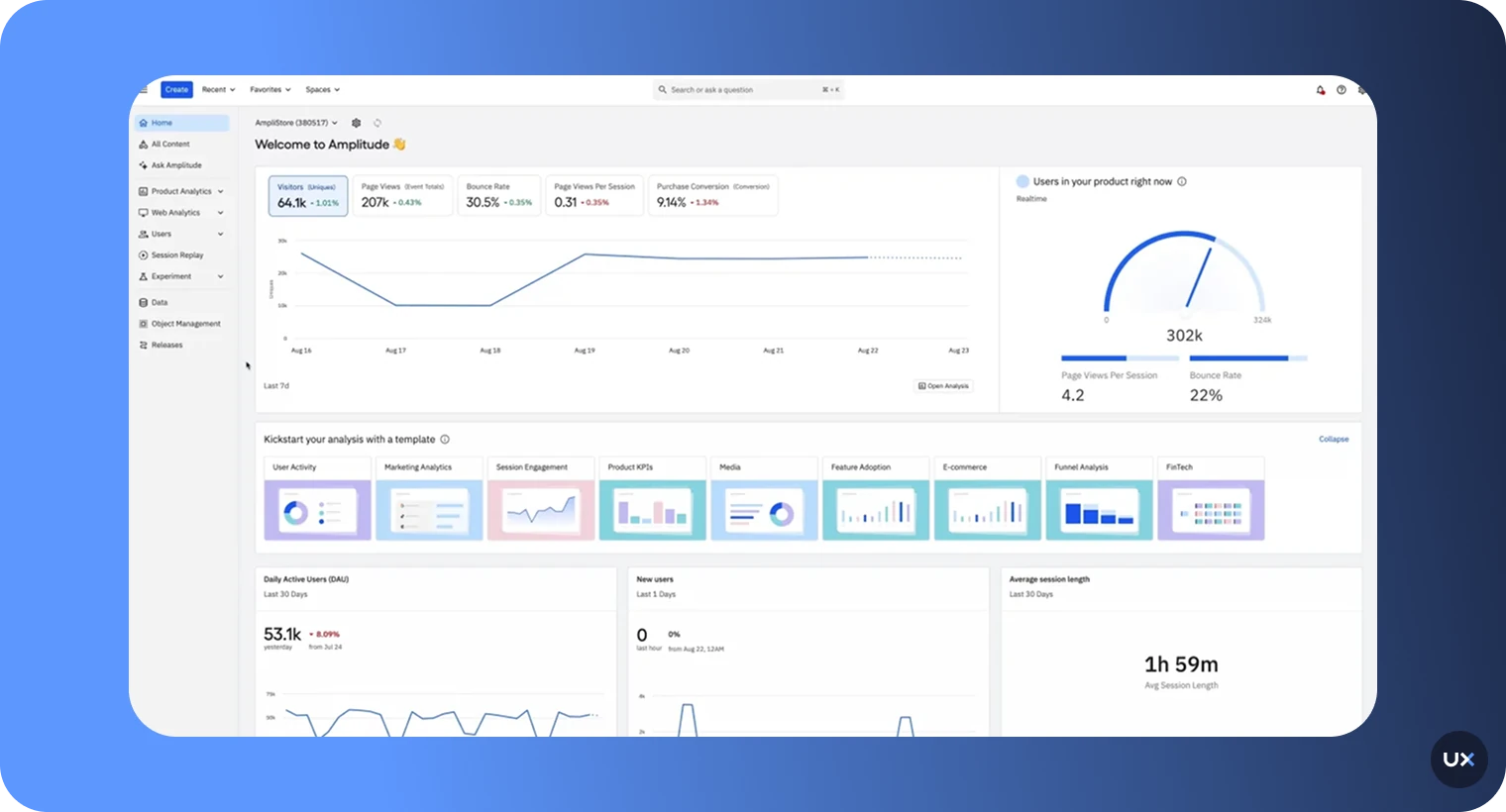

3. Amplitude

Ideal para: equipos grandes con función de datos dedicada y fuerte foco en cohortes conductuales y analytics predictivo.

Amplitude es un líder en product analytics con herramientas sólidas de pathfinder, cohortes y predictivas. Como Mixpanel, es cuantitativo primero y más potente cuando se combina con una plataforma cualitativa.

Pros

Análisis de cohortes conductuales de primer nivel

Visualización de flujos con Pathfinder

Modelos predictivos de churn y engagement

Plan gratuito hasta 10M de eventos mensuales

Contras

Curva de aprendizaje empinada para no-analistas

El session replay es un add-on más nuevo y menos maduro

El precio enterprise se vuelve caro rápido

Precios: Gratis hasta 10M de eventos/mes. Plan Plus desde ~61 USD/mes. Enterprise personalizado.

4. Contentsquare

Ideal para: equipos enterprise de experiencia digital con presupuesto para una plataforma de suite completa.

Contentsquare es una plataforma integral de digital experience analytics que combina session replays, heatmaps, journey mapping, puntaje de frustración e insights con IA. Adquirió Hotjar, así que hay algo de superposición de producto, Hotjar sirve al SMB, Contentsquare al enterprise.

Pros

Análisis profundo de journey y zonas

Insights "Sense" impulsados por IA

Sólido tanto en web como en web móvil

Contras

Precio enterprise, no accesible para equipos más chicos

La implementación puede tomar meses

La cobertura nativa de apps móviles es menos madura que en herramientas enfocadas en apps móviles y web

Precios: Solo cotización personalizada.

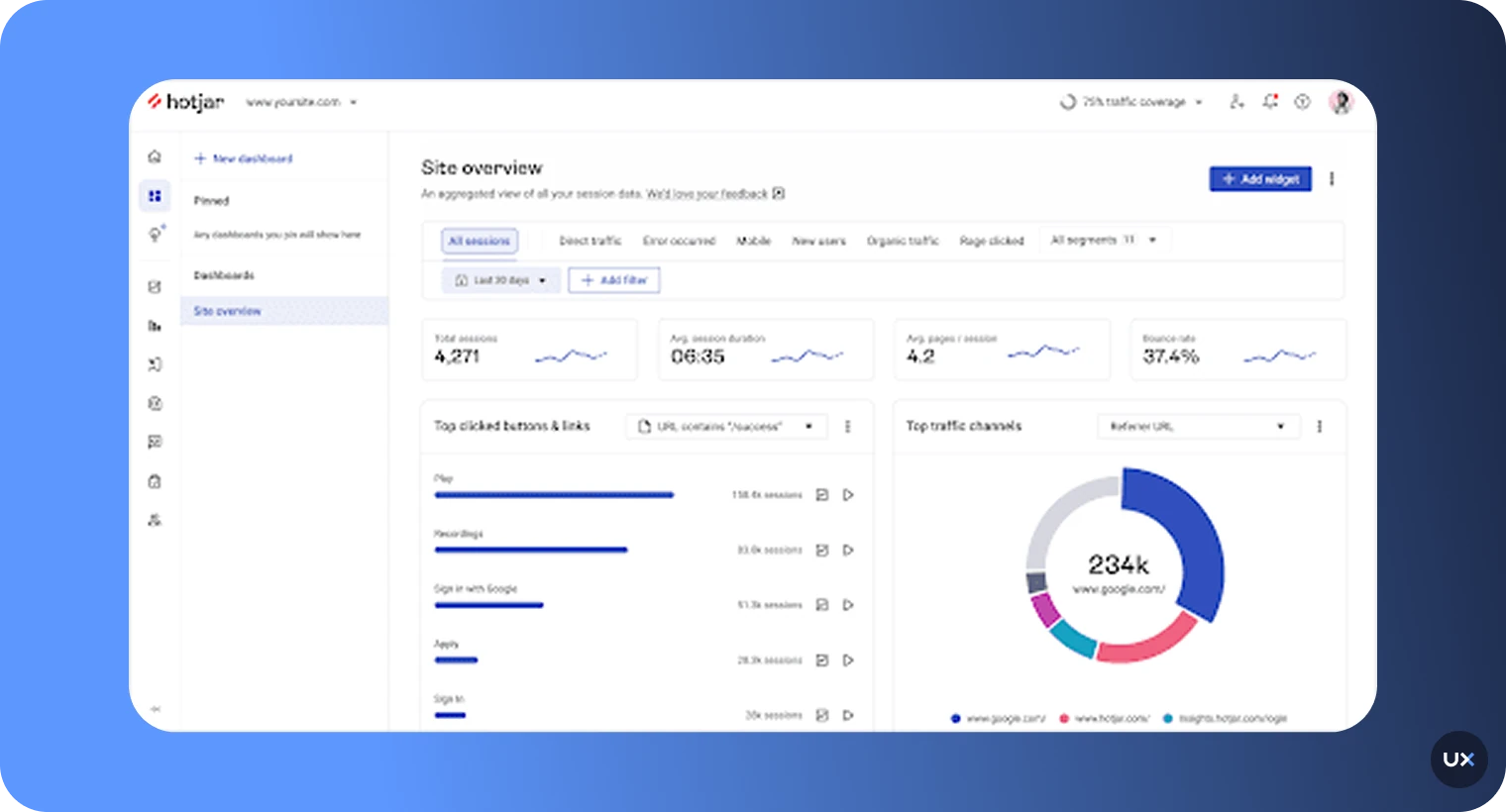

5. Hotjar

Ideal para: equipos web pequeños a medianos que quieren heatmaps, replays y encuestas en una herramienta liviana.

Hotjar (ahora parte de Contentsquare) es la herramienta de qualitative web analytics más adoptada para SMBs. Heatmaps, grabaciones de sesión y encuestas en el sitio. Solo web, así que los equipos de apps móviles necesitan combinarlo con algo más.

Pros

Fácil de configurar, UI amigable

Tier gratuito generoso

Bases sólidas de heatmap y replay

Contras

Sin soporte nativo para apps móviles

El analytics cuantitativo (funnels, cohortes) es superficial

Los límites de sesiones en los planes más bajos se alcanzan rápido en sitios de alto tráfico

Precios: Plan gratis para siempre. Pago desde 49 USD/mes.

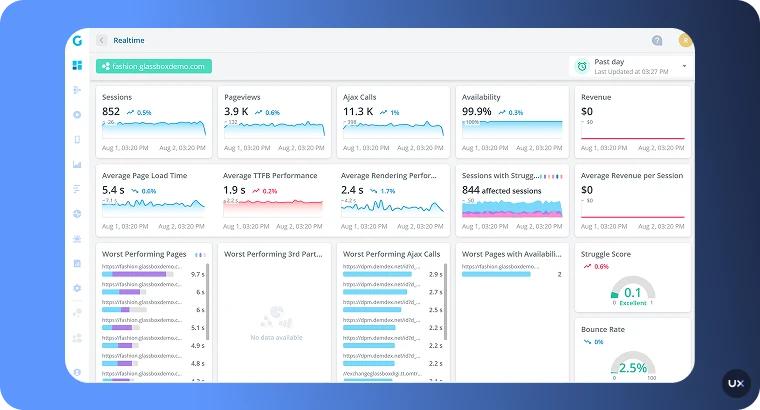

6. Glassbox

Ideal para: empresas reguladas (finanzas, salud, seguros) que necesitan 100% de captura de sesiones y cumplimiento estricto.

Glassbox (que adquirió SessionCam) captura cada interacción de usuario en web y móvil con gobernanza de datos de nivel enterprise. Construido para organizaciones donde necesitas cada sesión, no una muestra.

Pros

Captura completa de sesiones, sin muestreo

Certificación ISO/IEC 27001, cumplimiento fuerte

Detección de struggle y journey analytics

Contras

Precio e implementación enterprise

Excesivo para la mayoría de equipos de mid-market

La UI es densa y requiere entrenamiento

Precios: Personalizado.

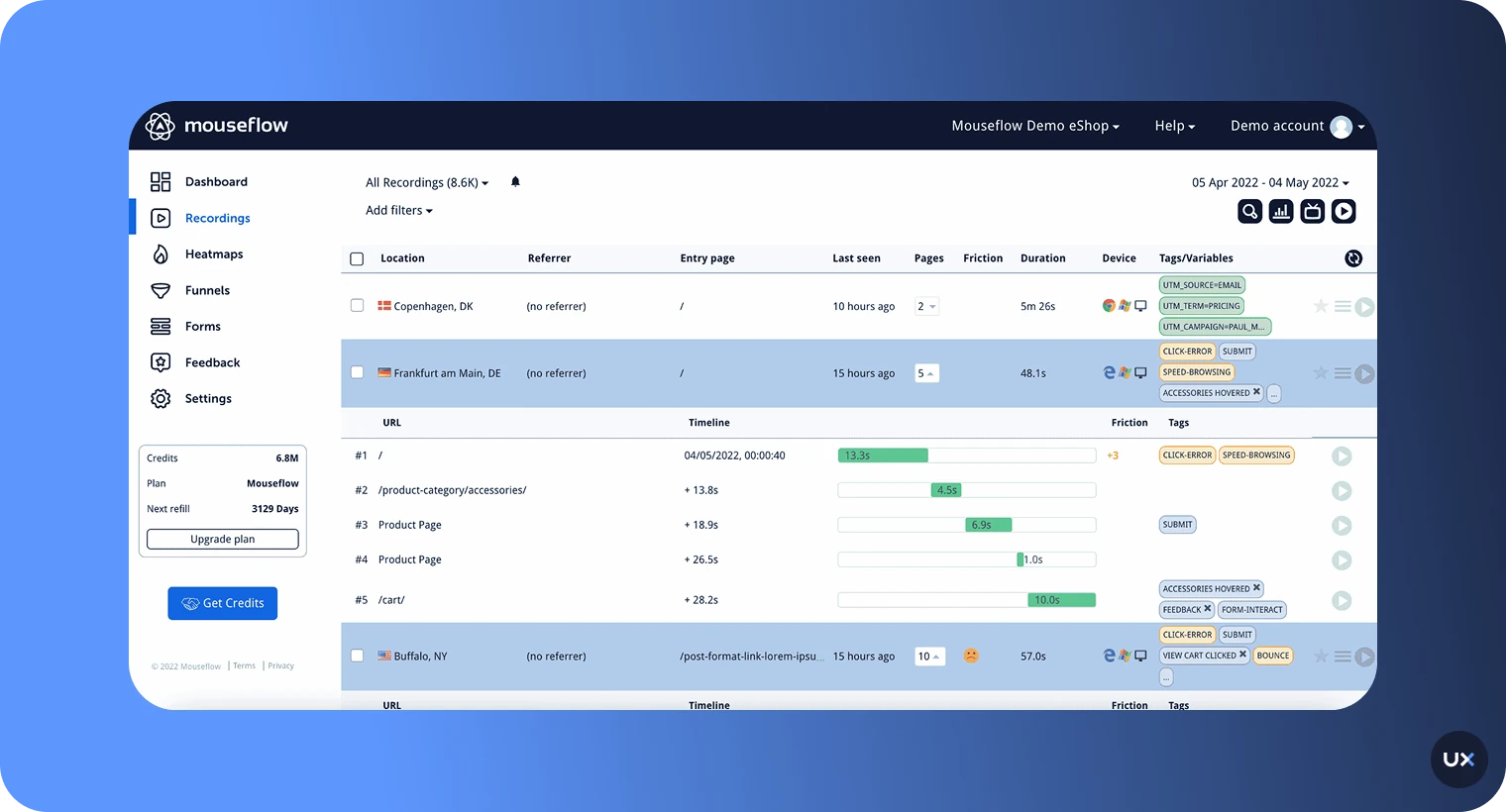

7. Mouseflow

Ideal para: equipos de marketing web enfocados en optimización de conversión.

Mouseflow ofrece session replay, seis tipos de heatmaps, funnels y analytics de formularios para sitios web. Una alternativa sólida a Hotjar con mayor variedad de heatmaps.

Pros

Seis tipos de heatmap incluyendo atención y geo

Puntaje de fricción por sesión

Precio de entrada accesible

Contras

Solo web, sin analytics de apps móviles

Tier gratuito tope en 500 sesiones/mes

Profundidad cuantitativa limitada

Precios: Gratis hasta 500 sesiones/mes. Pago desde 39 USD/mes.

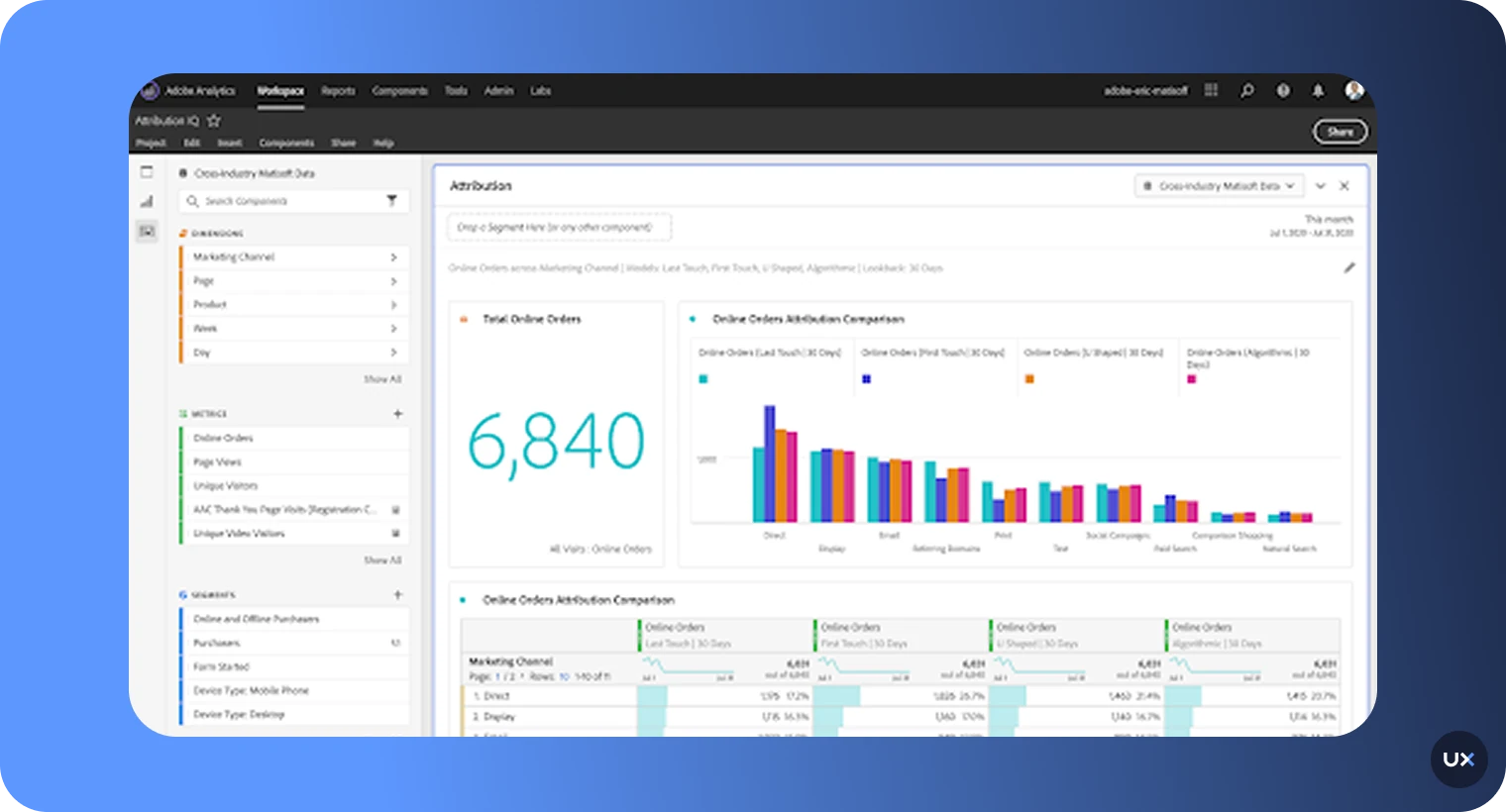

8. Adobe Analytics

Ideal para: grandes empresas que ya están dentro del ecosistema Adobe Experience Cloud.

Adobe Analytics es una plataforma de analytics enterprise de peso pesado con segmentación avanzada, modelado de atribución y pronóstico con IA vía Adobe Sensei.

Pros

Segmentación y atribución extremadamente profundas

Integración estrecha con el resto de Adobe Experience Cloud

Gobernanza de nivel enterprise

Contras

Curva de aprendizaje empinada, requiere especialistas

Caro, precio solo por cotización

Las herramientas cualitativas son limitadas sin agregar otros productos de Adobe

Precios: Cotización personalizada.

9. Firebase Analytics

Ideal para: apps móviles en etapa temprana que necesitan tracking de eventos gratuito y liviano.

Firebase Analytics (parte de Google Firebase) te da tracking básico de eventos, segmentación de audiencias y atribución para apps móviles. Bueno como punto de partida, pero es una herramienta de reporte, no una herramienta de UX analytics.

Pros

Gratis para empezar

Integración nativa con Google Ads y BigQuery

Bueno para atribución de instalaciones y reporte de crashes

Contras

Sin session replay ni heatmaps

Muestreo en apps de alto volumen

La latencia de datos hace incómodo el análisis en tiempo real

Precios: Tier gratuito, pago por uso para funcionalidades avanzadas.

10. FullStory

Ideal para: equipos con foco web que quieren session replay con una capa cuantitativa fuerte.

FullStory es una plataforma de experiencia digital con autocapture, session replay, heatmaps y funnel analytics. Tradicionalmente web primero, con cobertura móvil en crecimiento.

Pros

Autocapture fuerte y análisis retroactivo

UI de replay limpia

Buena detección de señales de frustración

Contras

Paridad móvil por detrás de herramientas para apps móviles y web

Precio enterprise opaco

Puede sentirse pesado para equipos pequeños

Precios: Cotización personalizada.

Comparación rápida

| Herramienta | Ideal para | Móvil | Web | Plan gratis | Precio inicial |

|---|---|---|---|---|---|

| UXCam | Equipos de producto móvil + web | ✅ | ✅ | 3.000 sesiones/mes | Personalizado |

| Mixpanel | Product analytics basado en eventos | ✅ | ✅ | Sí | 0,28 USD/1k eventos |

| Amplitude | Analytics conductual enterprise | ✅ | ✅ | 10M eventos/mes | ~61 USD/mes |

| Contentsquare | DXA enterprise | Limitado | ✅ | No | Personalizado |

| Hotjar | Equipos web SMB | ❌ | ✅ | Sí | 49 USD/mes |

| Glassbox | Enterprise regulado | ✅ | ✅ | No | Personalizado |

| Mouseflow | CRO web | ❌ | ✅ | 500 sesiones/mes | 39 USD/mes |

| Adobe Analytics | Enterprise con stack Adobe | ✅ | ✅ | No | Personalizado |

| Firebase | Móvil en etapa temprana | ✅ | Limitado | Sí | Gratis |

| FullStory | DXA web | Limitado | ✅ | No | Personalizado |

10 errores comunes de UX analytics que evitar

Etiquetar 200 eventos antes de ver 20 sesiones. La instrumentación sin observación produce dashboards que nadie lee. Invierte el orden.

Tratar el session replay como teatro de vigilancia. Si estás mirando sesiones para validar una decisión que ya tomaste, vas a encontrar lo que quieres. Entra con una hipótesis, no con un veredicto.

Ignorar el enmascaramiento de PII hasta que legal levante la bandera. Retroajustar el enmascaramiento en un codebase maduro es doloroso. Configúralo el día uno, aunque seas un equipo de dos personas.

Medir la duración de sesión como métrica de éxito. Las sesiones largas pueden significar engagement o confusión. Sin señales de frustración superpuestas, no puedes saber cuál.

Correr análisis de funnel sobre un solo rango de fechas. Los funnels cambian con la estacionalidad, las campañas de marketing y los releases. Siempre compara semana a semana o contra una cohorte de control.

Confiar en los datos de encuestas autorreportados por encima de los datos conductuales. Los usuarios rutinariamente describen comportamientos que no coinciden con sus replays. Cuando los dos entran en conflicto, gana el comportamiento.

Construir un data warehouse personalizado antes de validar las preguntas. Las implementaciones de Snowflake de seis meses son un movimiento favorito de procrastinación para equipos que no quieren enfrentar sus verdaderos problemas de UX.

Solo mirar sesiones de usuarios con churn. También necesitas mirar power users. El delta entre un usuario confundido y uno fluente te dice dónde invertir esfuerzo de diseño.

Saltar métricas específicas de móvil en un producto pesado en móvil. Las áreas de toque, los conflictos de gestos y los prompts de permiso se comportan nada como los clics web. Instrumenta para la plataforma en la que realmente estás.

Acumular insights dentro del equipo de producto. Soporte, marketing y ventas se benefician todos de la evidencia de sesiones. Monta un canal de Slack o un email semanal donde se compartan los 3 mejores replays de la semana.

Qué sigue para UX analytics

Algunos cambios que observo de cerca en 2026:

**Los analist

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

Artículos relacionados

Product best practices

Diseño centrado en el usuario: definición, principios, proceso y cómo medirlo

Diseño centrado en el usuario explicado por un analista de producto: principios, proceso de UCD, métricas y cómo los equipos usan datos de sesión para...

Silvanus Alt, PhD

Founder & CEO | UXCam

UI/UX Design

¿Qué es UX Analytics? Guía de un practicante (+ las 10 mejores herramientas de UX Analytics en 2026)

UX analytics explicada por un practicante: métodos, métricas y las 10 mejores herramientas de UX analytics en 2026 para equipos de producto, diseño y...

Silvanus Alt, PhD

Founder & CEO | UXCam