App Conversion Rate Optimization: Guía Práctica de CRO para Móvil

La optimización de la tasa de conversión en apps es la disciplina de convertir más de tu tráfico e instalaciones existentes en usuarios que completan las acciones de las que depende tu negocio: signups, suscripciones, compras, reactivaciones. He revisado cientos de funnels móviles en los últimos años y el patrón que veo con más frecuencia es el mismo. Los equipos copian los playbooks de CRO web a una pantalla de celular, se preguntan por qué sus lift tests se aplanan y culpan a usuarios de "baja intención". El problema real es casi siempre que el CRO móvil necesita su propio modelo, su propia instrumentación y su propio ciclo de evidencia.

Esta guía expone cómo abordo el CRO cuando audito un producto, tanto en aplicaciones móviles como en web. Cómo definir la conversión, cómo encontrar las fugas y cómo cerrarlas con cambios que se componen.

Conclusiones clave

La optimización de la tasa de conversión en apps es distinta al CRO web genérico. Las zonas del pulgar, la fragmentación de dispositivos, la fricción de la app store y los recorridos de sesión opacos hacen que no puedas copiar y pegar tácticas de escritorio.

Las conversiones macro y micro importan ambas. Monitorea el signup o la compra, pero instrumenta los 6-10 microeventos que lo predicen para saber dónde se está rompiendo realmente el funnel.

Session replay es el camino más rápido a una hipótesis de CRO. Mirar 20 sesiones de drop-off normalmente le gana a una semana mirando dashboards.

Velocidad, largo de formularios y fricción de pago siguen siendo los tres arreglos de mayor rendimiento. Una mejora de un segundo en la carga vale por sí sola cerca del 27% en tasa de conversión en móvil.

Tara AI de UXCam, session replay, heatmaps e issue analytics te dan la capa cualitativa que le falta a la mayoría de los equipos, la razón por la que Recora redujo los tickets de soporte en un 142% e Inspire Fitness levantó el tiempo en app un 460%.

¿Qué es la optimización de la tasa de conversión en apps?

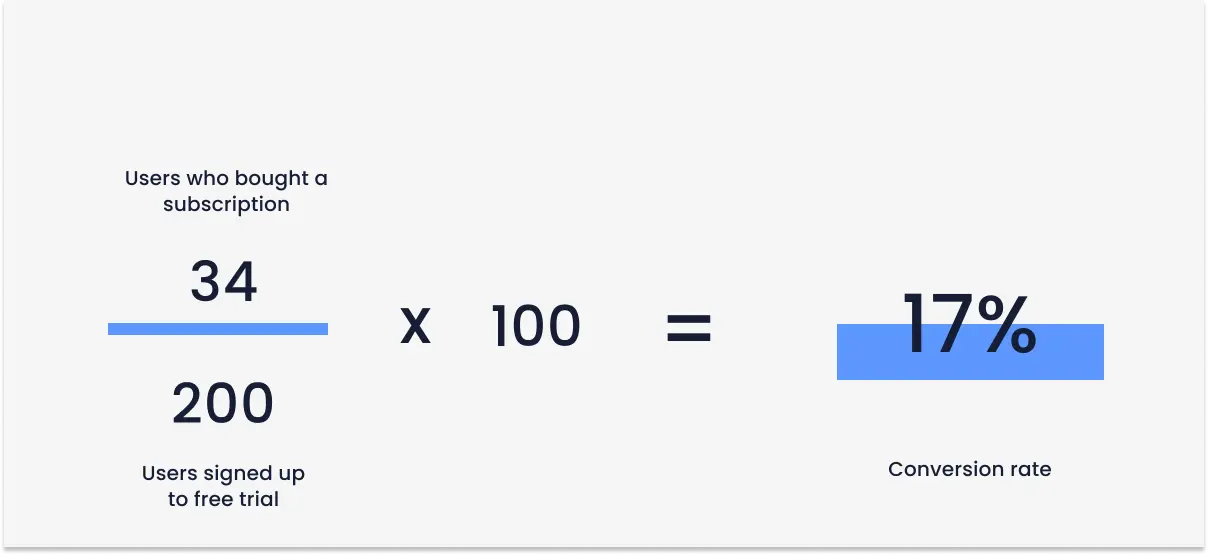

La optimización de la tasa de conversión en apps (CRO móvil) es el proceso continuo de aumentar la proporción de usuarios que completan una acción definida y vinculada a ingresos dentro de tu aplicación móvil o producto web. Esa acción puede ser activación tras signup, una compra in-app, una mejora de suscripción, una reserva o alcanzar un umbral específico de engagement que se correlaciona con la retención.

La matemática es simple. El trabajo no lo es.

Lo que hace al CRO móvil más difícil que el CRO de escritorio:

Sin visibilidad a nivel URL. No puedes simplemente enchufar un script de heatmap y leer la profundidad de scroll. Necesitas un SDK que capture pantallas, gestos y eventos automáticamente.

Fragmentación de dispositivos. Un botón de checkout que funciona en un Pixel 8 puede quedar recortado en un Android económico. Sin replay, no vas a enterarte.

La fricción de la app store está fuera de tu app. Las tasas de install-to-open, los prompts de permisos y las reseñas en la tienda afectan la conversión pero viven fuera de tu stack de product analytics.

El contexto de sesión es más corto y más interrumpido. Los usuarios convierten en ventanas de 30 segundos entre otras apps, llamadas y notificaciones.

Por esto el stack de CRO que recomiendo está construido alrededor de una plataforma de product intelligence, no de una herramienta de marketing reutilizada. UXCam está instalado en más de 37.000 productos y fue construido para aplicaciones móviles y web, que es lo que hace posible el resto de este framework.

Conversiones micro vs. macro: instrumenta las dos

La mayoría de los equipos que audito monitorean una conversión macro y dan el tema por cerrado. Después, cuando el número cae, no tienen idea de por qué. Las microconversiones te dan la capa diagnóstica.

Conversiones macro

Las conversiones macro son los hitos primarios atados a ingresos o a la promesa central del producto. Por ejemplo:

Instalación de la app → primer open

Signup completado

Primera compra o suscripción

Upgrade a plan pago

Reserva u orden confirmada

Microconversiones

Las microconversiones son los pasos y señales en el camino hacia la macro. Dos sabores que vale la pena separar:

Los hitos de proceso son los pasos explícitos del funnel: email verificado, perfil completado, método de pago agregado, primer ítem agregado al carrito. Te dicen dónde se rompe el funnel.

Las acciones secundarias son señales de engagement que predicen futuras conversiones macro: contenido compartido, notificación habilitada, favorito agregado, tooltip de onboarding completado. Te dicen quién es probable que convierta después.

La regla que les doy a los equipos: por cada conversión macro, define al menos seis microeventos a lo largo del journey. Esa es la instrumentación que necesitas antes de correr una sola prueba A/B.

Beneficios de hacerlo bien

Entiendes de verdad a tus usuarios

No todos en tu app tienen la misma intención. Algunos llegaron de un anuncio de TikTok esperando una victoria de 10 segundos. Algunos son power users que regresan. Una práctica de CRO adecuada segmenta estas cohortes y te deja ver dónde se traba cada una. El análisis del comportamiento del usuario es la base acá, no un nice-to-have.

Extiendes el valor del ciclo de vida del cliente

La adquisición se vuelve más cara cada trimestre. Aumentar el valor de los usuarios por los que ya pagaste es la palanca de crecimiento más barata disponible. Housing.com usó este enfoque con UXCam para hacer crecer la adopción de funcionalidades del 20% al 40%, un aumento directo de LTV sin un solo dólar extra de gasto en ads.

Reduces el costo de soporte

Cuando encuentras y arreglas la fricción que causa rage taps y congelamientos de UI, los tickets bajan. Recora usó issue analytics de UXCam para detectar que los usuarios estaban presionando-y-manteniendo un botón que debería tocarse. Arreglar la affordance redujo los tickets de soporte en un 142%.

El framework de CRO móvil en 7 pasos

Esta es la secuencia que corro con los equipos. El orden importa. Saltarse los pasos 1-2 es por lo que la mayoría de los programas de CRO se estancan.

Paso 1. Instala un stack de analytics

Sin instrumentación honesta, el resto es adivinanza. Como mínimo necesitas:

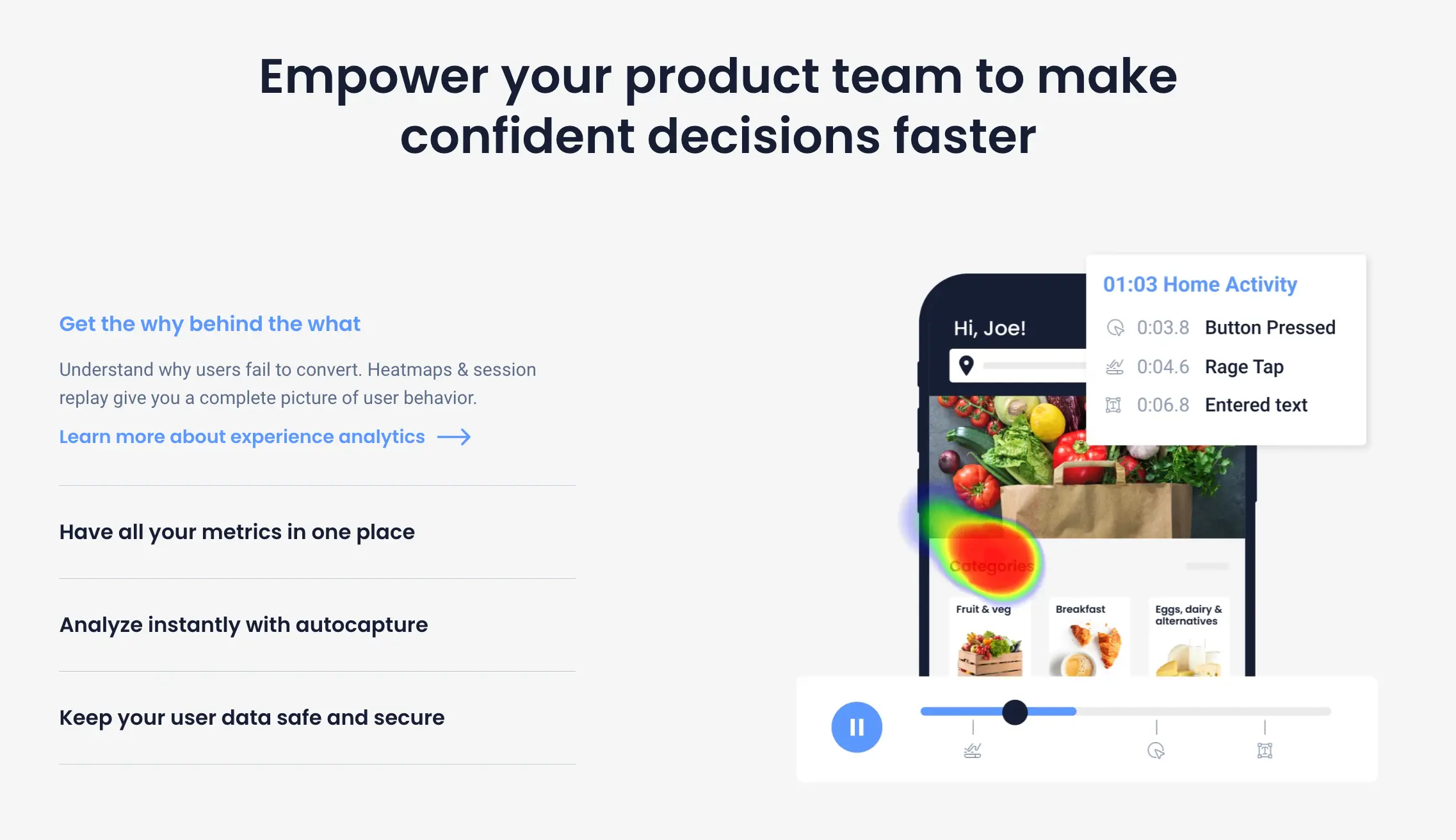

Pantallas y gestos autocapturados para no tener que etiquetar cada toque manualmente.

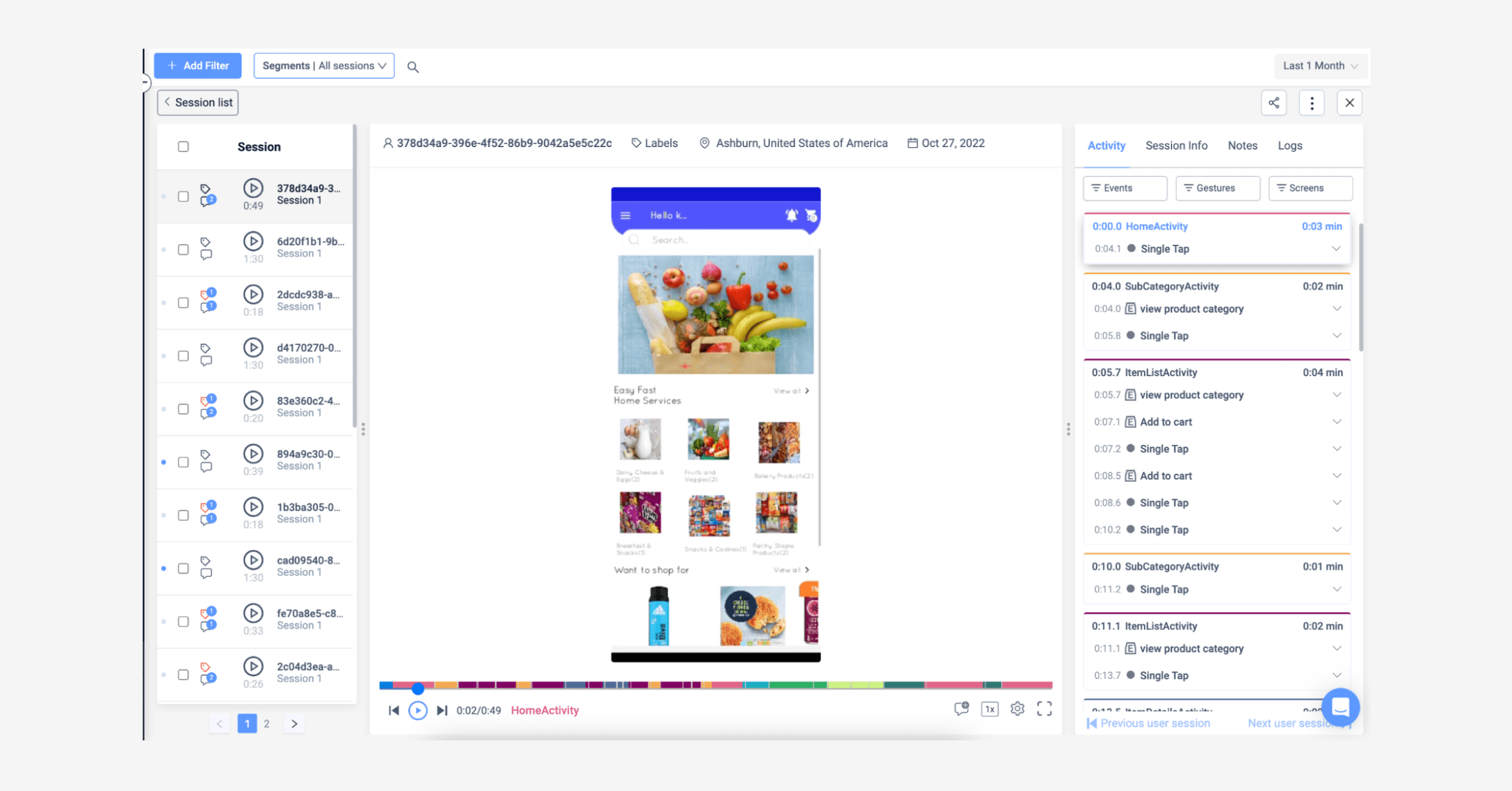

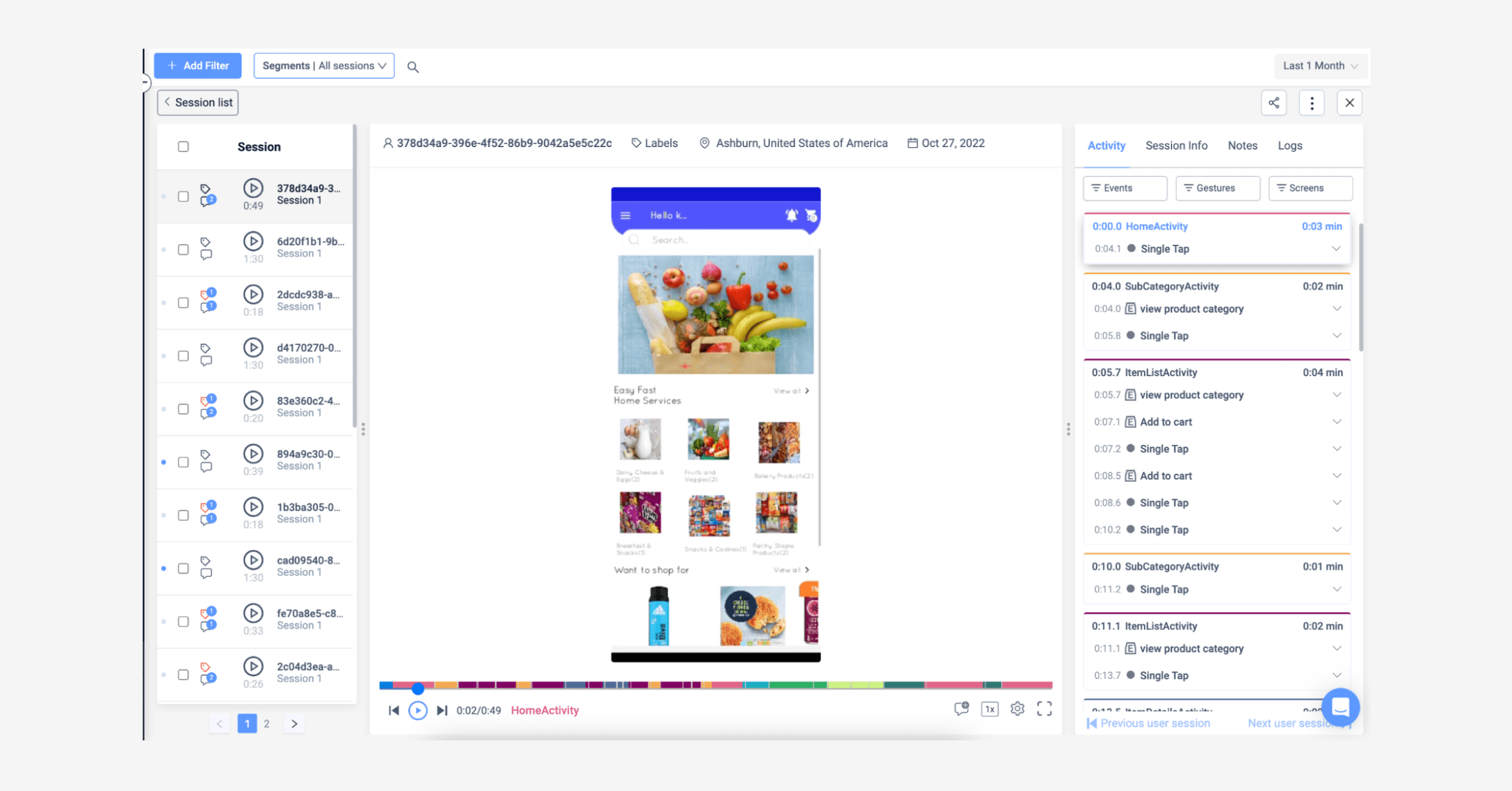

Session replay para poder mirar los drop-offs, no solo contarlos.

Heatmaps atados a pantallas, con vistas de toque, scroll y zona muerta.

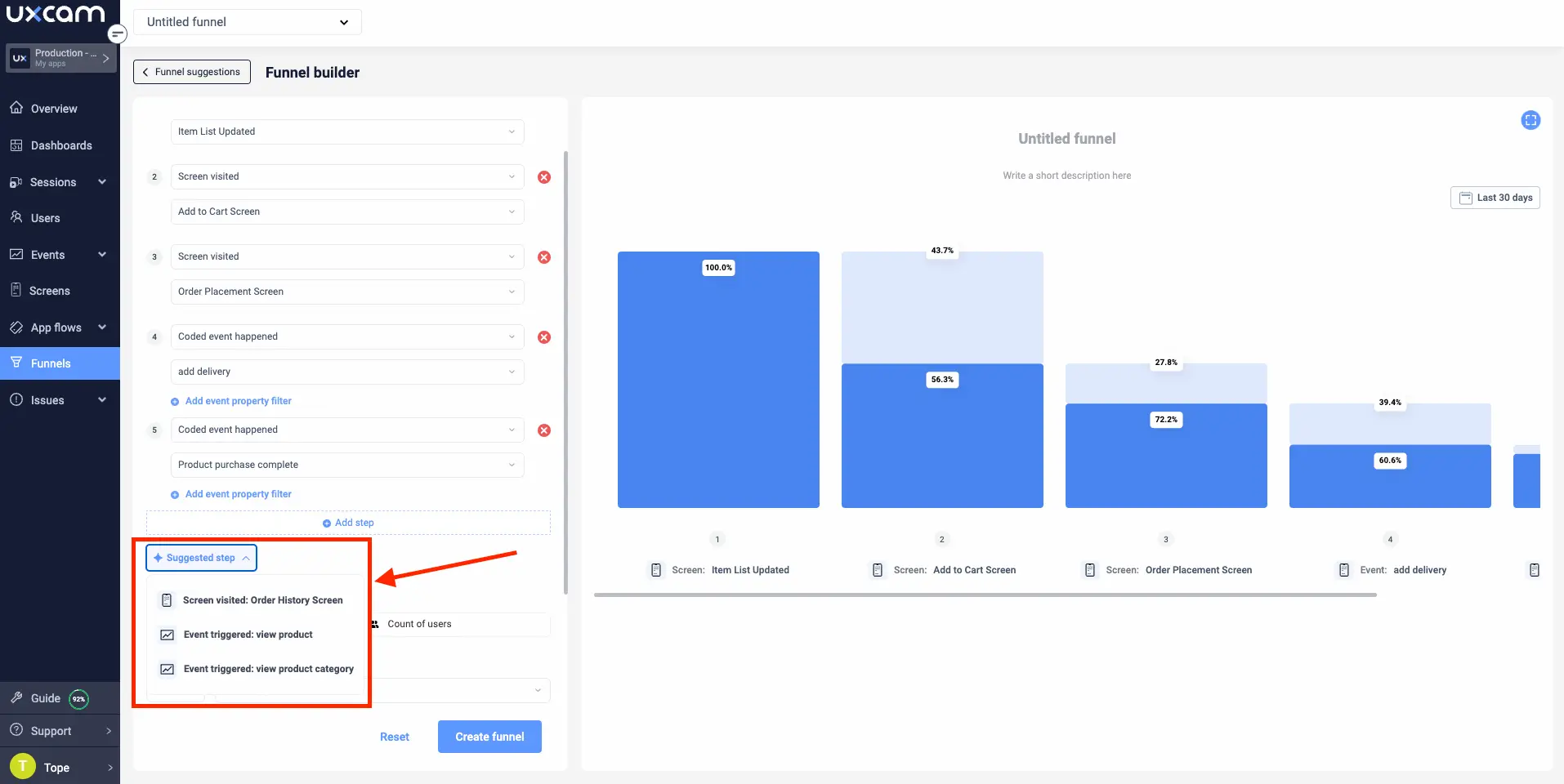

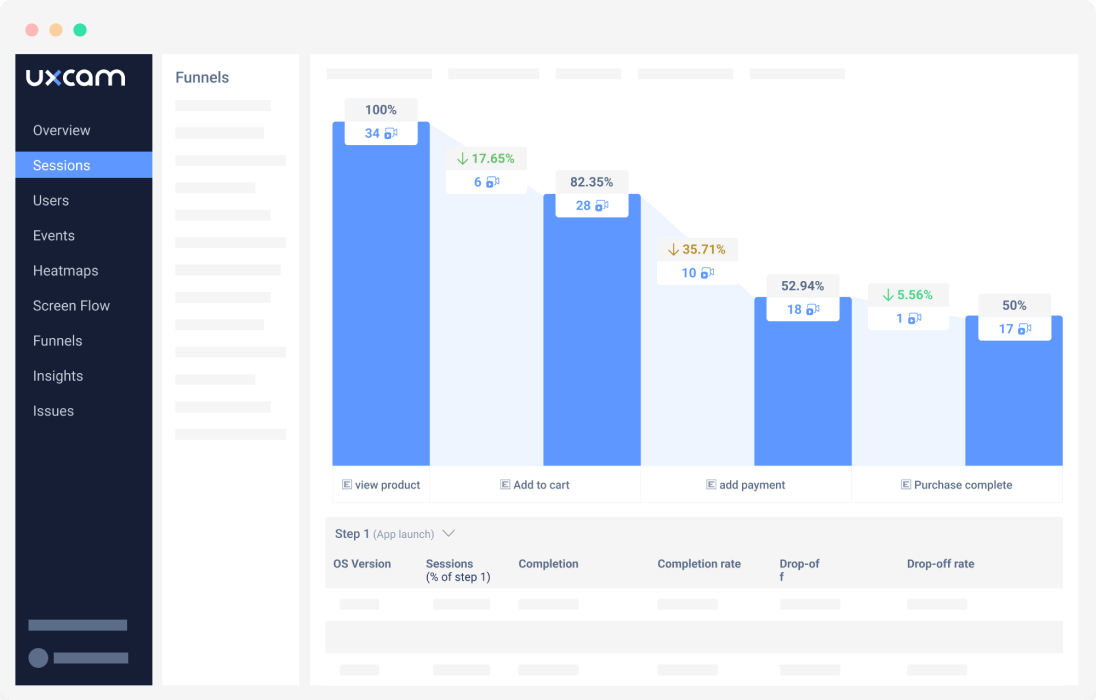

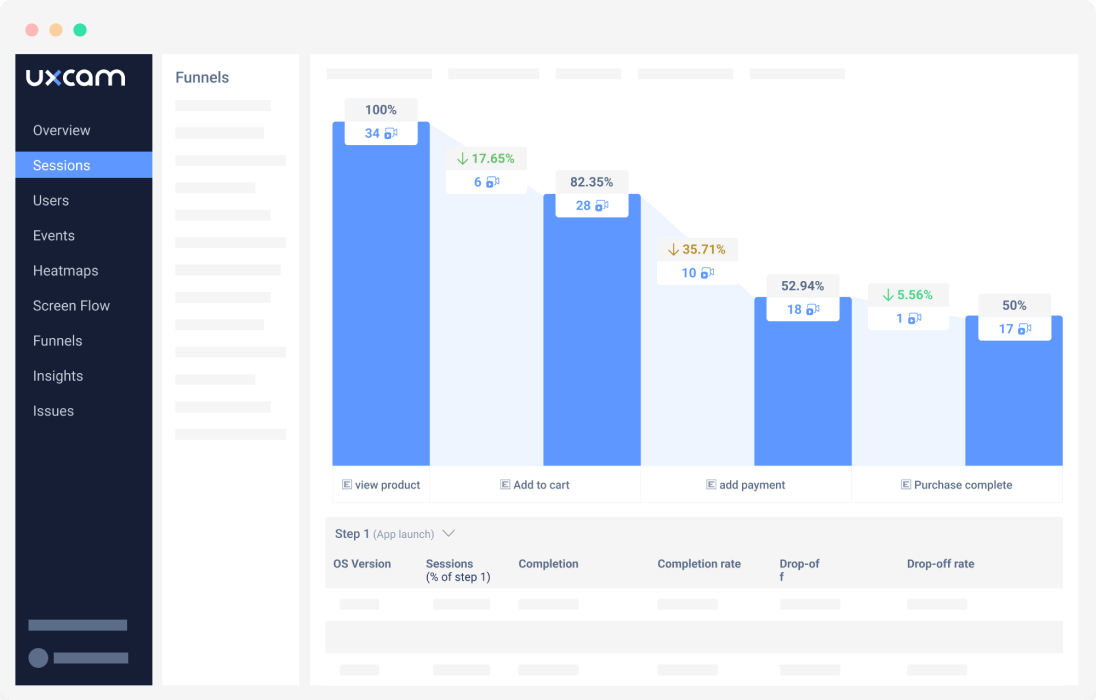

Funnels que puedas reconfigurar sin volver a desplegar la app.

Issue analytics que expone rage taps, congelamientos de UI y crashes en el contexto de la sesión del usuario.

El session replay de UXCam y los heatmaps vienen como parte de un único SDK liviano, y Tara, la analista de IA, lee las sesiones capturadas y recomienda dónde enfocarse. Para la mayoría de los equipos con los que trabajo, esa combinación reemplaza tres o cuatro herramientas separadas.

El workflow de CRO en UXCam que uso en la práctica

Define la conversión. Fija un evento macro y 6-10 microeventos alrededor.

Configura eventos y pantallas. Usa Smart Events para poder agregar eventos sin un ticket de ingeniería, más pantallas y gestos autocapturados para todo lo que olvidaste planear.

Mapea los caminos del usuario. Screen Flows muestra las rutas reales. Funnel Suggestions expone caminos probables que no habías considerado.

Valida el funnel. Mira 6-7 replays en cada etapa para confirmar que los eventos disparan correctamente. Este paso atrapa más bugs de instrumentación que cualquier proceso de QA.

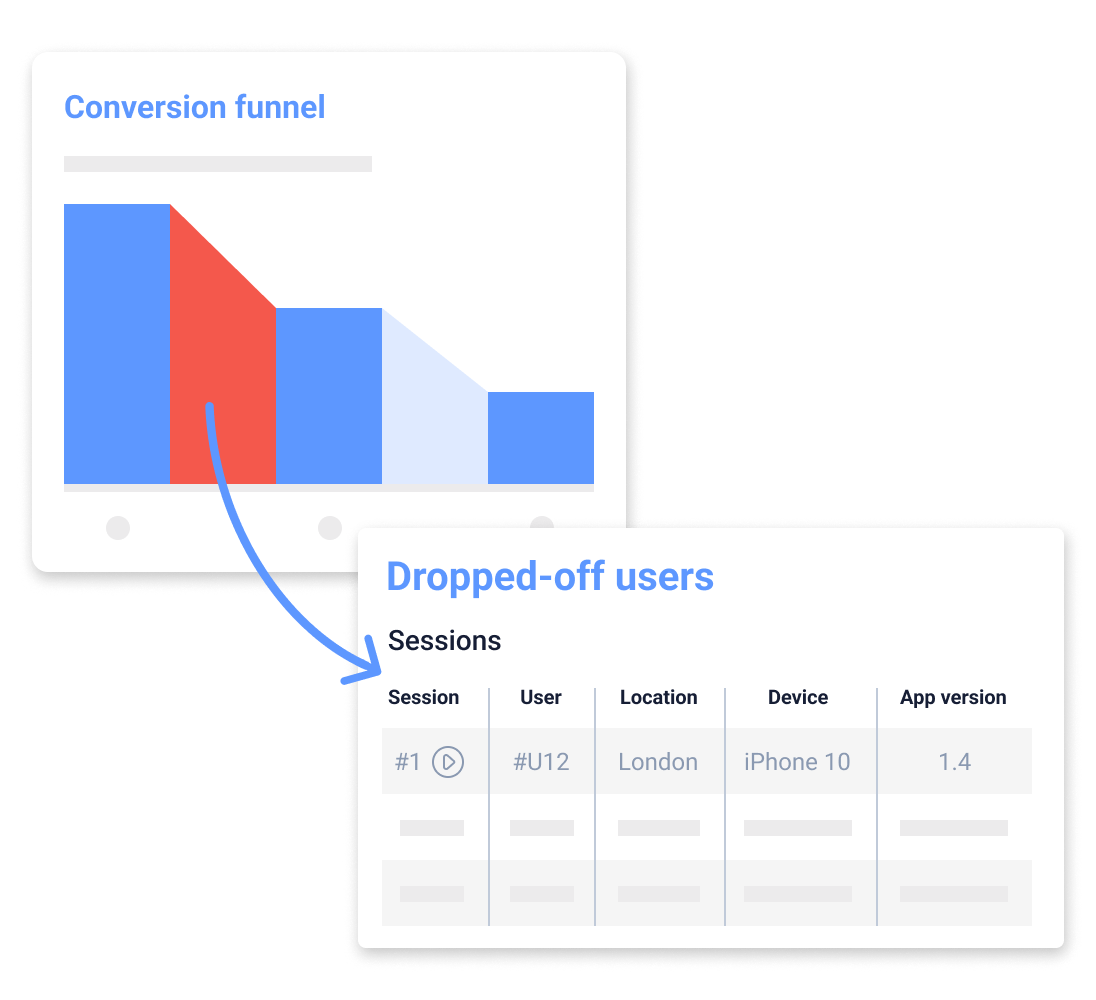

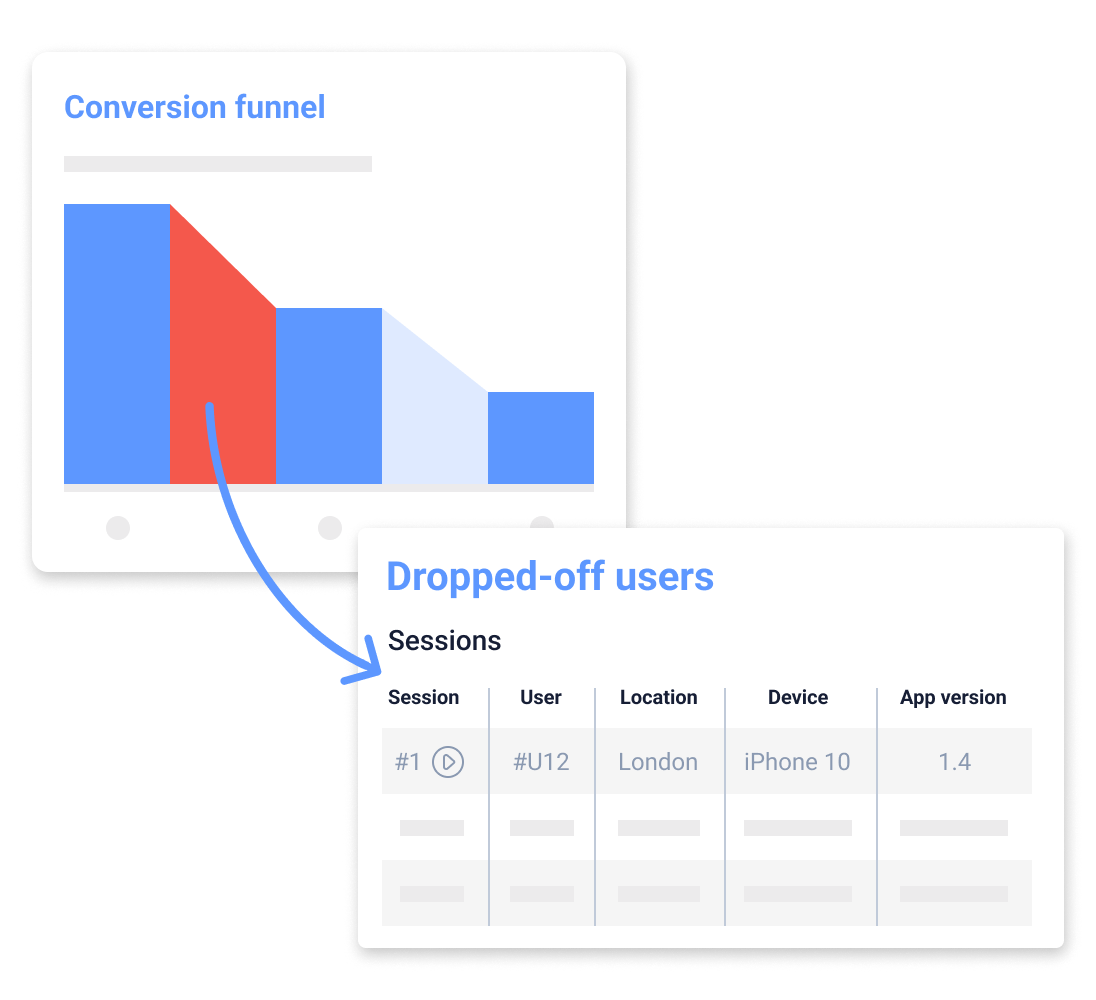

Analiza los drop-offs. Usa funnel analytics para ver dónde sucede la fuga.

Segmenta los drop-offs. Nuevos vs. recurrentes, clase de dispositivo, país, fuente de tráfico. El número agregado esconde la historia real todas las veces.

Investiga con replays. Filtra sesiones por etapa de drop-off y mira. Diez minutos mirando le ganan a una hora en el dashboard.

Confirma con heatmaps e issue analytics. Los rage taps, los toques muertos y los congelamientos de UI en la pantalla rota te dirán exactamente qué arreglar.

Monitorea el impacto. Configura dashboards para el funnel y míralo recuperarse. Compártelo con stakeholders semanalmente.

Paso 2. Haz investigación específica de móvil

Demasiados equipos corren las mismas entrevistas a usuarios que corrían para su funnel web y lo llaman investigación móvil. Una pasada de investigación de CRO móvil real incluye:

Segmentación por clase de dispositivo (flagship vs. Android económico es una brecha real)

Pruebas de condición de red (3G, wifi inestable)

Verificaciones de orientación y alcanzabilidad (¿se puede tocar el CTA con una sola mano?)

Estudios de diario en contexto donde los usuarios reportan sobre sesiones que pasaron haciendo fila, en el bus, etc.

Los resultados de encuesta deberían segmentarse por tipo de dispositivo para poder distinguir si "la app se siente lenta" es universal o está aislado a un segmento de hardware.

Paso 3. Duplica la apuesta por tus flujos de mayor conversión

Normalmente hay un camino por tu app que convierte tres o cuatro veces mejor que el promedio. Encuéntralo con user journey analytics y protégelo con ferocidad.

Movimientos prácticos:

Un CTA primario por pantalla. El espacio móvil castiga la indecisión. Los datos de heatmap suelen mostrar que el CTA secundario se come toques del primario.

Ubica los CTAs en la zona del pulgar en el tercio inferior de la pantalla, no en la nav superior.

Haz pruebas A/B del copy. "Empieza tu prueba gratis" vs. "Pruébalo gratis" vs. "Empezar" suele mover la conversión entre 10-20% sin trabajo de diseño.

Usa el onboarding para entregar valor inmediato. Deja que los usuarios interactúen con una funcionalidad real antes de chocar con el paywall. Inspire Fitness usó los session insights de UXCam para rediseñar la fricción del flujo de onboarding y aumentó el tiempo en app un 460% al mismo tiempo que reducía los rage taps un 56%.

Paso 4. Arregla el rendimiento antes que cualquier otra cosa

Los usuarios notan retrasos tan cortos como 100 milisegundos. Una mejora de un segundo en el tiempo de carga sube la conversión aproximadamente un 27% en móvil. La propia investigación de Core Web Vitals de Google muestra que los sitios que cumplen con los umbrales de LCP, INP y CLS ven un abandono materialmente más bajo. El rendimiento no es una preocupación de ingeniería separada del CRO, es la palanca de CRO con mayor apalancamiento para la mayoría de las apps que audito.

Qué revisar primero:

Optimización de imágenes (AVIF o WebP, dimensionamiento apropiado por dispositivo)

Tiempo de cold start

Tiempo de respuesta de API en las pantallas del camino crítico

Saltos de animación y frames caídos en dispositivos económicos

Congelamientos de UI, que issue analytics de UXCam expone automáticamente

Paso 5. Simplifica el checkout y los formularios

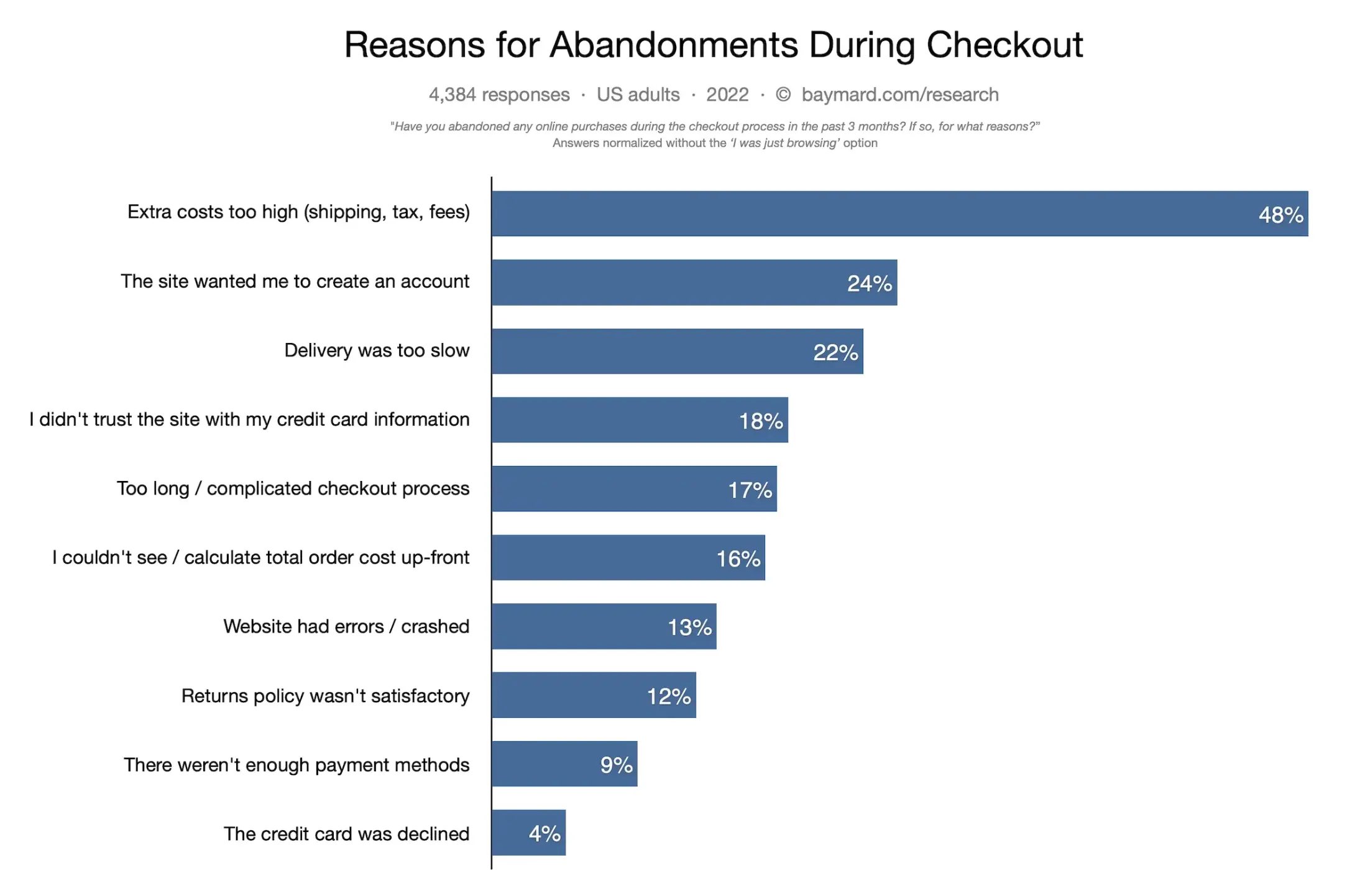

El 17% de los compradores abandona los carritos específicamente porque el checkout es demasiado largo o complicado. En móvil ese número suele ser peor, con el Baymard Institute reportando un abandono de carrito móvil promedio documentado por encima del 85% en todos los sectores.

La lista corta de arreglos de checkout que levantan la conversión de forma consistente:

Elimina cada campo que no necesitas estrictamente. Si no necesitas un apellido, no lo pidas.

Colapsa el checkout en la menor cantidad de pasos que permita el procesador de pago.

Muestra una barra de progreso. Los usuarios toleran el largo cuando pueden ver el final.

Ofrece Apple Pay, Google Pay y al menos una billetera local por región.

Permite checkout como invitado. Forzar el signup antes de la compra es el asesino de conversión más común que veo.

Costa Coffee usó UXCam para identificar la fricción de registro y rediseñó el paso de signup, subiendo los registros un 15%.

Paso 6. Gana confianza de forma visible

Los usuarios convierten cuando se sienten seguros. En móvil, las señales de confianza necesitan estar comprimidas y ser inequívocas:

Badges claros de SSL y seguridad de pago cerca del botón de pago

Reseñas y testimonios reales, idealmente con nombres y fotos

Un resumen de privacidad visible en los prompts de permiso

Precios transparentes, incluyendo qué es gratis y qué se cobra después de una prueba

Paso 7. Haz benchmarks, y vuelve a hacer benchmarks

No puedes optimizar lo que no mides de forma consistente. Fija un ritmo semanal:

Compara la tasa de conversión macro de esta semana con la semana pasada, el mes pasado y la línea base rodante de 90 días.

Monitorea las tres tasas de microconversión que alimentan la macro.

Compara con benchmarks públicos de la industria cuando estén disponibles. Tanto Adjust como AppsFlyer publican benchmarks móviles específicos por sector trimestralmente, y State of Mobile de data.ai es la referencia cross-sector que reviso una vez por trimestre.

14 patrones y tropiezos de CRO móvil que veo en cada auditoría

Estos son los hallazgos específicos que aparecen repetidamente cuando recorro un producto. Cada uno merece una pasada de revisión dedicada.

1. El prompt de permiso con timing equivocado

Las apps que piden permiso de push, ubicación o tracking en el primer lanzamiento ven tasas de negación por encima del 60%. Retrasa el prompt hasta que el usuario haya visto el valor, idealmente ligado a una funcionalidad que necesite el permiso, siguiendo las Directrices de Interfaz Humana de Apple. Para ATT específicamente, los datos de benchmark de ATT de Adjust muestran que las tasas de opt-in se duplican o triplican cuando el pre-prompt explica el valor antes de que dispare el diálogo del sistema.

2. El CTA secundario robando toques del primario

Los heatmaps muestran consistentemente que cuando un enlace "Saltar" o "Saber más" se ubica cerca del CTA primario, desvía entre 15-30% de los toques previstos. Muévelo a una zona distinta o reduce su peso visual. El arreglo más rápido que vi lanzar fue degradar el enlace "Tal vez después" a un pequeño enlace gris metido debajo del pliegue, lo que subió los inicios de prueba un 11% en una semana.

3. Toques muertos en elementos no interactivos

Los usuarios tocan imágenes, íconos y fondos de tarjetas esperando que sean enlaces. La detección de dead taps de UXCam muestra exactamente dónde sucede esto. O haces el elemento tocable o lo rediseñas para que no luzca interactivo. La investigación sobre áreas de toque de Nielsen Norman Group es la referencia que vale la pena dejar abierta durante las revisiones de diseño.

4. Teclado tapando el campo de input

Especialmente en Android, un campo de formulario que queda oculto por el teclado mata la tasa de completación. Prueba con todas las alturas principales de teclado incluyendo Gboard con autocompletar y SwiftKey. La documentación de ajuste de teclado de Android cubre el arreglo.

5. Forzar la creación de cuenta antes del valor

Dejar que los usuarios experimenten el producto antes del signup rutinariamente sube la activación 20-40%. La famosa ubicación del signup de Duolingo en la lección tres, no en la lección cero, es el ejemplo canónico. El trabajo de modelo de crecimiento de Reforge describe por qué el signup retrasado se compone a lo largo del loop de adquisición, no solo de la primera sesión.

6. Signup largo sin login social

Agregar Apple, Google y una opción de login social regional acorta el signup en aproximadamente 40 segundos en promedio. Eso importa más que cualquier reordenamiento de campos. Sign in with Apple de Apple ahora es obligatorio en iOS si ofreces cualquier otra autenticación de terceros, así que no hay razón para no agregarlo.

7. Estados de error que no recuperan al usuario

Un pago fallido que deja al usuario de vuelta en un carrito vacío es un asesino de conversión. Preserva el carrito, muestra la razón específica del fallo y ofrece un método de pago alternativo en línea. La guía de manejo de errores de Stripe es una base sólida para los códigos específicos que vale la pena exponer versus ocultar.

8. Onboarding que enseña en lugar de activar

Los tooltips que explican cada ícono son una señal de que la UI no es autoevidente. Reemplázalos con una única tarea de activación que entregue valor real en menos de 60 segundos. La investigación de onboarding de NN/g es la mejor referencia acá.

9. Sin indicación de progreso en flujos de varios pasos

Los usuarios que no pueden ver el final de un flujo lo abandonan. Un simple indicador "Paso 2 de 4" sube la completación de forma significativa. El efecto es más fuerte en flujos más largos de tres pasos donde los usuarios no pueden estimar mentalmente cuánto trabajo queda.

10. Paywall antes del momento aha

Si tu paywall aparece antes de que el usuario haya sentido el valor central, estás optimizando para rebote, no para ingresos. Mueve el paywall para que se dispare después de que el usuario complete la acción que predice la retención al día 7. Los benchmarks de suscripción de RevenueCat muestran que las apps con paywalls disparados por comportamiento convierten entre 40-60% mejor que las disparadas por tiempo.

11. Notificaciones push genéricas

Las notificaciones push en batch entrenan a los usuarios a desactivarlas. Las pushes disparadas basadas en comportamiento convierten 3-5x mejor según los datos de benchmark de Airship. Empieza con tres disparadores conductuales (acción abandonada, hito alcanzado, recomendación personalizada) antes de construir la matriz completa de mensajería.

12. Prompt de reseña in-app en el momento equivocado

Pedir una reseña después de una secuencia de rage taps te consigue reseñas de una estrella. Ata el prompt a un momento de éxito confirmado: orden entregada, hito de racha, entrenamiento exitoso. La API de reseñas de StoreKit de Apple limita los prompts a tres por año, así que cada uno tiene que contar.

13. Áreas de toque pequeñas

Apple recomienda un mínimo de 44x44 puntos. Google recomienda 48dp. Los datos de heatmap de apps que audito rutinariamente muestran subida de conversión cuando los objetivos se agrandan a 52-56dp, especialmente para usuarios mayores de 45. La guía WCAG 2.5.5 de tamaño de objetivo te da la justificación de accesibilidad si necesitas resistir frente a un diseñador que quiere espaciado más apretado.

14. Sin manejo de estado offline

Los usuarios en metros, aviones y wifi inestable se rinden cuando una pantalla muestra un spinner para siempre. Cachea el último estado bueno y expone un patrón claro de "Estás sin conexión, esto es lo que todavía puedes hacer". La biblioteca de patrones offline-first tiene ejemplos concretos para las pantallas más comunes.

Consideraciones de CRO específicas por industria

El framework de 7 pasos es universal. Las tácticas que más importan cambian por vertical.

Fintech y banca

La confianza y el cumplimiento son las palancas de conversión, no solo la velocidad. El drop-off de KYC normalmente es la mayor fuga, y el arreglo es casi siempre romper la verificación de identidad en divulgación progresiva: pide lo que necesitas para desbloquear el siguiente paso de valor, no todo por adelantado. La investigación de Plaid sobre vinculación de cuentas muestra consistentemente tasas de completación por debajo del 50% para flujos de primera vez, así que instrumenta cada handoff al proveedor de identidad y mira los replays.

Ecommerce y retail

El abandono de carrito es la métrica dominante. Apple Pay y Google Pay típicamente suben la conversión móvil entre 20-30% en la primera compra. El rendimiento de la página de producto en 3G y Android económico es no negociable. Construye CRO alrededor de las cuatro páginas de mayor apalancamiento: categoría, detalle de producto, carrito y checkout, en ese orden.

On-demand y marketplace

El tiempo hasta la primera transacción exitosa es la métrica estrella del norte. El permiso de ubicación, la configuración de pago y el canje de promo de primera orden son las tres microconversiones que predicen retención. El session replay en las pantallas de mapa y búsqueda normalmente expone los arreglos más grandes porque son las pantallas con el contenido más dinámico y con más formas de fallar silenciosamente.

Salud, fitness y bienestar

El momento aha normalmente está entre la sesión 3 y 7, no en la primera sesión, así que los objetivos de CRO necesitan estar ponderados por retención. El aumento del 460% en tiempo en app de Inspire Fitness vino de reconstruir el onboarding alrededor de un entrenamiento real, no de un tutorial. El timing del paywall es la variable individual más testeada en esta vertical.

SaaS y B2B

La activación, no el signup, es la conversión macro que importa. Un primer proyecto completado, un compañero invitado o una integración conectada predicen LTV mucho mejor que la verificación de email. Instrumenta la activación como un funnel multi-evento y segméntalo por tamaño de compañía y rol.

Medios y streaming

La tasa de reproducción y el retorno de segunda sesión son las métricas de conversión pareadas. Los ajustes de autoplay, la calidad de video consciente de la red y las pantallas de inicio personalizadas son las tres variables principales. Vigila los rage taps en las barras de búsqueda y los spinners de buffer, que se correlacionan fuertemente con el abandono de sesión.

Herramientas de CRO móvil por categoría

Ninguna herramienta individual cubre todo. Este es el stack que veo funcionando en 2026.

Product intelligence y analytics: UXCam para session replay, heatmaps, funnels, issue analytics y Tara AI. Mixpanel y Amplitude para análisis de funnel y cohorte basado en eventos.

A/B testing y feature flags: Statsig, Optimizely, LaunchDarkly y Firebase Remote Config para experimentación y rollouts por etapas.

Atribución y MMP: Adjust, AppsFlyer y Branch para medición de adquisición pagada y deep linking.

Monitoreo de crashes y rendimiento: Firebase Crashlytics, Sentry e Instabug para detección de crashes y ANR, combinados con issue analytics de UXCam para fricción a nivel de UX.

Mensajería al cliente y engagement: Braze, Iterable y OneSignal para lifecycle y push. Intercom para soporte in-app.

Encuestas y cualitativo: UserTesting, Maze y Survicate para investigación moderada y no moderada.

Suscripción e ingresos: RevenueCat y Adapty para gestión de suscripciones, pruebas de paywall y analytics de ingresos en iOS y Android.

10 errores comunes de CRO móvil

Optimizar para signup en lugar de activación. Terminas con números de vanidad y una curva de retención con fugas.

Correr pruebas A/B sin tráfico suficiente para significancia. Las apps de bajo tráfico deberían apoyarse en evidencia cualitativa y lanzar basándose en señal direccional, no esperar meses por un p<0,05.

Confiar en funnels agregados. El promedio esconde la cohorte que está rompiéndose. Siempre segmenta por dispositivo, OS, país y fuente.

Ignorar los dispositivos Android de nivel económico. Si el 40% de tus usuarios están en dispositivos con 2-4GB de RAM, ahí es donde vive tu próximo 10% de subida de conversión.

Probar el pulido visual antes de arreglar flujos rotos. Las esquinas redondeadas nunca salvaron un funnel. Arregla primero los toques muertos.

Tratar los rage taps como un problema de ingeniería. Son la señal más clara de conversión perdida. Ponlos en el backlog de growth.

Copiar a los competidores sin instrumentación. La ubicación de su paywall funcionó para su curva de retención, no la tuya.

Usar herramientas de web analytics en móvil. El tracking basado en URL se pierde pantallas, gestos y estados in-app donde vive la mayor parte de la fricción.

Lanzar la prueba sin un plan de rollback. Los rollouts por etapas con feature flags previenen que una mala variante queme tus números semanales.

No cerrar el loop. El experimento se lanzó, la métrica se movió y nadie miró los replays para confirmar que la experiencia de usuario realmente mejoró. Necesitas tanto números como evidencia.

Un modelo de madurez de CRO: dónde estás y qué hacer a continuación

Usa esto como diagnóstico. La mayoría de los equipos que audito están en el nivel 2 y piensan que están en el nivel 4.

Nivel 1: A ciegas

Monitoreas instalaciones y un evento macro. Sin segmentación, sin replay, sin funnels. Siguiente paso: instala un SDK de autocaptura como UXCam, define tu conversión macro e instrumenta seis microeventos alrededor. Espera dos semanas de setup.

Nivel 2: Contando

Tienes funnels y sabes dónde sucede el drop-off. No puedes explicar por qué. Siguiente paso: suma session replay y heatmaps. Comprométete a mirar 20 sesiones de drop-off por semana y escribir los tres principales patrones de fricción.

Nivel 3: Diagnosticando

Miras replays, segmentas los drop-offs y tienes un backlog de hipótesis de fricción. La experimentación es ad hoc. Siguiente paso: instala una herramienta de feature flags y A/B, define guardrails de prueba (tamaño de muestra, duración, métricas de guardrail) y corre una prueba a la vez con hipótesis documentadas.

Nivel 4: Experimentando

Lanzas tres o más pruebas por mes, mides métricas primarias y de guardrail y tienes una definición de ganar ponderada por retención. Siguiente paso: ata los objetivos de CRO al LTV y a la retención al día 30, no al signup. Trae issue analytics al mismo backlog que los experimentos de growth.

Nivel 5: Componiendo

El CRO es un ritmo operativo semanal. Tara AI marca los patrones, los replays validan las hipótesis, los experimentos lanzan y las curvas de retención suben trimestre tras trimestre. Siguiente paso: capacita de forma cruzada a producto, ingeniería y marketing en los mismos dashboards, y empieza a publicar aprendizajes externamente. Los equipos en este nivel tienden a reclutar mejor porque hablan de evidencia en público.

Empezando: tus primeros 30 días

Si estás empezando desde el Nivel 1 o 2, esta es la cadencia que te lleva a una práctica de CRO que funciona dentro de un mes.

Semana 1: Instala UXCam, acuerda una conversión macro y lanza un esquema de eventos borrador que cubra seis a diez microeventos. Valida los eventos mirando cinco replays por etapa para confirmar que disparan en el momento correcto. Anota la tasa de línea base actual para la macro y cada micro.

Semana 2: Segmenta el funnel por clase de dispositivo, OS, país y fuente de tráfico. Identifica el segmento individual de peor desempeño. Mira 20 replays de drop-off en ese segmento y agrupa lo que ves en tres o cuatro patrones de fricción. Escribe cada uno como una hipótesis de una línea.

Semana 3: Elige la hipótesis con mayor ICE y lanza el arreglo más simple posible detrás de un feature flag. Para la mayoría de los equipos esto es un cambio de copy, un reposicionamiento de CTA o eliminar un campo de formulario. Mide el delta de conversión y una métrica de guardrail (normalmente retención al día 7 o ingresos por usuario).

Semana 4: Revisa el resultado con los stakeholders, reproduciendo un replay ganador y uno perdedor. Documenta el aprendizaje en un documento compartido sin importar el resultado. Elige la siguiente hipótesis. La meta al final del mes uno no es una sola gran victoria. Es un loop repetible.

Lo que veo funcionando en 2026

Tres patrones de auditorías recientes que vale la pena destacar:

Triaje de sesiones asistido por IA. Mirar 50 replays solía tomar medio día. Tara AI lee sesiones, agrupa los patrones de fricción y expone los tres o cuatro que importan. Eso comprime el loop de hipótesis de semanas a días.

CRO ponderado por retención. Los equipos que optimizan solo para signup terminan con alta tasa de churn. Los que están ganando están atando los objetivos de CRO a la retención al día 7 y al día 30, no solo a la primera compra.

Issue analytics como input de CRO. Los rage taps y los congelamientos de UI son a menudo la razón real detrás de una caída en el funnel. Tratarlos como bugs de ingeniería separados del backlog de CRO es un error. Son el mismo trabajo.

Lectura relacionada

Preguntas frecuentes

¿Cuál es una buena tasa de conversión para una aplicación móvil?

Depende mucho de la vertical y de la definición de conversión. Para install-to-signup, un rango saludable es 25-40%. Para signup-a-usuario-pago, las apps fintech y SaaS comúnmente ven entre 2-5%, mientras que los juegos freemium corren por debajo del 2%. Las apps de ecommerce normalmente convierten visitantes en compradores a una tasa de 1-3%. Más útil que el número de la industria es tu propia tendencia: ¿estás mejorando semana tras semana para las mismas fuentes de tráfico? Ese es el único benchmark que importa para decisiones operativas.

¿En qué se diferencia la optimización de la tasa de conversión en apps del CRO web?

Tres diferencias estructurales. Primero, móvil no tiene URLs, así que necesitas un SDK que capture pantallas y gestos en lugar de cargas de página. Segundo, la fragmentación de dispositivos móviles significa que un cambio que sube la conversión en iPhone puede hundirla en un Android económico, así que las pruebas segmentadas son obligatorias. Tercero, las sesiones móviles son más cortas y más interrumpidas, así que la alcanzabilidad con el pulgar, el uso con una sola mano y la tolerancia offline se vuelven variables de CRO que simplemente no existen en escritorio. La disciplina subyacente es la misma, pero las herramientas y los playbooks tienen que reconstruirse.

¿Qué métricas debería monitorear primero para CRO?

Empieza con una conversión macro claramente definida y seis a diez microconversiones que la preceden. Después suma cohortes de retención en el día 1, día 7 y día 30 para no sobreoptimizar un balde con fugas. En el lado cualitativo, monitorea rage taps, congelamientos de UI y toques muertos como proxies de fricción. Los issue analytics y funnels de UXCam te dan todos estos en un solo lugar, lo cual importa porque cambiar entre herramientas normalmente significa cambiar entre números conflictivos.

¿Cuánto tarda en verse resultados del CRO móvil?

Para la instrumentación y los primeros insights, unas dos semanas. Para que los cambios lanzados muestren un aumento de conversión estadísticamente significativo, típicamente de cuatro a ocho semanas dependiendo de tu volumen de tráfico. Las apps de bajo tráfico deberían esperar más cerca de ocho semanas por prueba. Las apps de alto tráfico con decenas de miles de sesiones diarias pueden correr múltiples pruebas concurrentes y lanzar en ciclos de dos semanas. El mayor consumidor de tiempo es casi siempre la instrumentación, por lo que los SDKs de autocaptura se pagan solos rápido.

¿Puedo correr pruebas A/B dentro de UXCam?

UXCam es una plataforma de product intelligence y product analytics, así que el rol primario es diagnosticar qué probar y medir qué pasó después. La mayoría de los equipos lo combinan con una herramienta de experimentación dedicada para el motor de aleatorización y estadístico. El workflow que tiende a funcionar: usa session replay, heatmaps y las recomendaciones de IA de Tara en UXCam para generar la hipótesis, corre el experimento en tu herramienta A/B y después vuelve a los funnels y replays de UXCam para validar que la variante ganadora realmente mejoró el journey del usuario, no solo una métrica.

¿Todavía importa el CRO móvil si la mayor parte de mi tráfico es de anuncios pagados?

Importa más, no menos. El tráfico pagado aumenta el costo de cada paso con fugas en tu funnel. Si estás pagando $4 por instalación y pierdes el 60% de los usuarios en el signup, estás pagando $10 por cada usuario activado. Una mejora del 10% en la completación de signup reduce directamente tu CAC efectivo por la misma cantidad. Los equipos que veo sacando más apalancamiento del gasto pagado son los que tratan al CRO y la adquisición como un único P&L, no como departamentos separados.

¿Cuántas microconversiones debería monitorear por macro?

Seis a diez es el punto dulce. Menos de seis y pierdes el detalle diagnóstico cuando la macro cae. Más de diez y la señal se diluye en eventos que nadie mira en realidad. La disciplina es elegir los microeventos que predicen la macro, no los que son fáciles de instrumentar.

¿Qué tamaño de muestra necesito para una prueba A/B móvil?

Depende de la tasa de conversión base y el efecto mínimo detectable que te importa. Para una base del 10% y un aumento relativo del 10% con 80% de potencia, planea aproximadamente 15.000 usuarios por variante. Herramientas como la calculadora de Evan Miller te darán el número exacto. Si tu tráfico no puede soportar eso en cuatro a seis semanas, apóyate en evidencia cualitativa y lanza basándote en señal direccional en lugar de esperar meses.

¿Debería optimizar iOS y Android por separado?

Normalmente sí. Las tasas de conversión, las capacidades del dispositivo, los defaults de pago y las expectativas de usuario divergen lo suficiente como para que un enfoque de optimización unificado deje lift sobre la mesa. Instrumenta ambas plataformas de forma idéntica pero segmenta cada análisis de funnel y replay por OS. Los equipos que más me sorprenden son los que encuentran que sus funnels de iOS y Android caen en pasos completamente diferentes.

¿Cómo priorizo qué experimento de CRO correr primero?

Uso un puntaje ICE (impacto, confianza, facilidad) en cada hipótesis, pero el desempate siempre es la fortaleza de la evidencia. Una hipótesis respaldada por diez replays de usuarios luchando le gana a una hipótesis respaldada por un blog post sobre la victoria de otra compañía. La confianza

AUTOR

Silvanus Alt, PhD

Founder & CEO | UXCam

Silvanus Alt, PhD, is the Co-Founder & CEO of UXCam and a expert in AI-powered product intelligence. Trained at the Max Planck Institute for the Physics of Complex Systems, he built Tara, the AI Product Analyst that not only analyzes user behavior but recommends clear next steps for better products.

Artículos relacionados

Product best practices

Métricas de Customer Experience: Las 12 Que Vale la Pena Monitorear, Cómo Operacionalizarlas y Hacia Dónde Está Llevando la IA el Trabajo

Métricas de customer experience, las 12 que vale la pena monitorear, fórmulas, benchmarks, agrupaciones de percepción vs. comportamiento...

Silvanus Alt, PhD

Founder & CEO | UXCam

Product best practices

Métricas de Customer Experience: As 12 Que Vale a Pena Acompanhar, Como Operacionalizá-las e Para Onde a IA Está Levando o Trabalho

Métricas de customer experience, as 12 que vale a pena acompanhar, fórmulas, benchmarks, agrupamentos por percepção, comportamento e operação, e como a...

Silvanus Alt, PhD

Founder & CEO | UXCam

Product best practices

Customer Experience Metrics: The 12 Worth Tracking, How to Operationalize Them, and Where AI Is Taking the Work

Customer experience metrics — the 12 worth tracking, formulas, benchmarks, perception vs behavioral vs operational groupings, and how AI session analysis...

Silvanus Alt, PhD

Founder & CEO | UXCam